Лекция 8 Тема Содержание темы

advertisement

Лекция 8

Тема

Сравнение случайных величин или признаков.

Содержание темы

Аналогия дискретных СВ и выборок

Виды зависимостей двух случайных величин (выборок)

Функциональная зависимость. Линии регрессии. Ковариация

Корреляционная зависимость. Ковариация. Линии регрессии.

Коэффициент корреляции

Основные категории

I функциональная, статистическая и корреляционная зависимости;

I линии регрессии для функциональной зависимости;

I метод наименьших квадратов;

I ковариация для функциональной зависимости;

I совместный закон распределения, корреляционная таблица и поле

корреляции;

I ковариация для корреляционной зависимости;

I линии регрессии для корреляционной зависимости;

I коэффициент корреляции.

Аналогия ДСВ и выборки

Дискретная случайная величина описывается рядом распределения.

Выборка описывается статистическим рядом.

ДСВ X

Выборка xi

Значения СВ x1 , . . . , xk

Ряд распределения

X

x1 . . .

xk

P

p1 . . .

pk

Варианты x1 , . . . , xk

Статистический ряд

xi

x1

...

xk

wi

w1 . . .

wk

Вероятности

k

P

pi = 1

i=1

Математическое ожидание

k

P

M (X) =

p i xi

Частости

k

P

i=1

i=1

k

P

i=1

ni

n

=1

Средняя арифметическая

k

P

x=

wi xi

i=1

Дисперсия

k

P

D(X) =

pi (xi − M (X))2

wi =

i=1

Выборочная дисперсия

k

P

s2x =

wi (xi − x)2

i=1

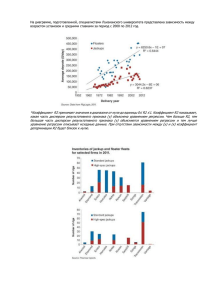

Виды зависимостей двух случайных величин

(выборок)

Далее всюду предполагаем, что заданы две дискретные случайные величины

X, Y , либо две выборки {xi }, {yi }. В силу этого, всё, что написано про

случайные величины, распространяется на выборки заменой pi на wi = nni ,

и наоборот.

Между случайными величинами или выборками можно изучать следующие

виды зависимостей:

I Функциональная зависимость (ФЗ).

I Статистическая зависимость (СЗ).

I Корреляционная зависимость (КЗ).

Функциональная зависимость

Функциональная зависимость предполагает, что каждому значению

случайной величины X соответствует строго определенное единственное

значение случайной величины Y , то есть их значения связаны функцией

y = f (x).

На практике всё же она проявляется не так однозначно, а имеются

некоторые малые случайные отклонения ε(x), так что

y = f (x) + ε(x).

Эти отклонения характеризуют ту случайную составляющую, которая нам

не важна. Они называются «случайным шумом». Например, ежедневные

колебания курса валюты на фоне сезонных:

Такие шумы

игнорируются.

Двойной ряд распределения

Если предполагается функциональная зависимость, то значения

yi должны строго соответствовать значениям xi , то есть пара

(xi , yi ) встречается только в таком сочетании и с определенной

вероятностью. Возникает двойной ряд распределения

X

Y

P

x1

y1

p1

...

...

...

xk

yk

pk

На

плоскости

Oxy

строим

ломаную

по

точкам

M1 (x1 , y1 ), . . . , Mk (xk , yk ). При этом мы не видим информации

о вероятностях pi , т.е. каждая точка Mi еще имеет «вес» –

вероятность pi , и вносит тем больший вклад в закон распределения,

чем больше эта вероятность. Можно изобразить этот факт размером

точки (в EXCEL есть для этого пузырьковые диаграммы).

Линия регрессии

Определение. Прямая вида

y = b0 + b1 x,

где b0 , b1 – некоторые числа, которая «наилучшим образом»

приближает построенную ломаную, называется линией регрессии Y

на X.

Критерием качества приближения является сумма квадратов

отклонения точек прямой от точек ломаной, взятых с множителем

pi , то есть величина математического ожидания случайной величины

[(b0 + b1 X) − Y ]2 :

S=

k

X

(b0 + b1 xi − yi )2 pi .

i=1

В методе наименьших квадратов наилучшим приближением

считается то, для которого коэффициенты b0 , b1 выбраны так, что

величина S принимает наименьшее значение.

Ковариация

Записывая необходимое условие экстремума функции двух переменных

S(b0 , b1 ) в виде

∂S

∂S

= 0,

= 0,

∂b0

∂b1

и решая полученную систему двух линейных уравнений относительно b0 , b1 ,

получим

b1 =

cov(X, Y )

,

D(X)

b0 = M (Y ) − M (X)

cov(X, Y )

.

D(X)

Здесь появилось новое понятие cov(X, Y ) – ковариация двух случайных

величин.

Определение. Ковариацией двух случайных величин X, Y называется число,

вычисляемое по формуле

cov(X, Y ) = M ([X − M (X)][Y − M (Y )]) = M (XY ) − M (X)M (Y ).

Для двойного ряда распределения получим, что

!

!

!

k

k

k

X

X

X

xi pi

yi pi .

cov(X, Y ) =

xi yi pi −

i=1

i=1

i=1

Уравнения регрессии

Для выборок принято более простое обозначение – выборочная

ковариация обозначается через µ (или через µxy ) и вычисляется в случае

двойного статистического ряда имеем

!

!

!

k

k

k

k

X

X

X

X

µ=

xi yi wi −

xi wi

yi wi =

(xi − x)(yi − y)wi .

i=1

i=1

i=1

i=1

Тогда из формул для коэффициентов b0 , b1 , в которых еще следует заменить

математические ожидания на средние арифметические, а дисперсии на

выборочные дисперсии, получим уравнение регрессии Y на X

y−y =

µ

(x − x).

s2x

Если все повторить, поменяв местами X, Y , то получим уравнение регрессии

X на Y

µ

x − x = 2 (y − y).

sy

Теорема о линиях регрессии

Теорема. При наличии двух выборок, у которых предполагается

функциональная зависимость, линией регрессии Y на X является

прямая, проходящая через точку «средних»

C = (x, y)

с угловым коэффициентом

µ

.

s2x

Линией регрессии X на Y является прямая, проходящая через точку

«средних»

C = (x, y)

µ

с угловым коэффициентом 2 .

sy

Статистическая зависимость

В общем случае, если нет никаких сведений о глобальной связи

между случайными величинами, можно посчитать условную функцию

распределения величины Y в предположении, что величина X приняла

конкретное значение x ∈ R. Она выражает условную вероятность

P {Y < y|X = x},

обозначается через F (y; x) или Fx (y):

F (y; x) = Fx (y) = P {Y < y|X = x} =

P {Y < y и X = x}

.

P {X = x}

Эти обозначения подчеркивают, что здесь x хоть и любое, но фиксированное

число, то есть параметр, а y – независимая переменная (аргумент).

Итак, статистическая зависимость предполагает, что функция

распределения одной случайной величины зависит от конкретного

значения другой. Предполагать это можно всегда, но вычислить эти

функции и оценить надежность такого вычисления проблематично. Поэтому

такой случай является слишком общим.

Корреляционная зависимость

Корреляционная зависимость предполагает, что математическое ожидание

одной случайной величины зависит от конкретного значения другой. Иначе

говоря, вычисляется или оценивается по выборке условное математическое

ожидание M (Y |X = x), то есть математическое ожидание случайной величины

с функцией распределения Fx (y) = P {Y < y|X = x}. Для простоты оно

обозначается через Mx (Y ).

Не путать! Здесь x – число (x ∈ R), любое, но фиксированное, поэтому

пишем x маленькое, а Y – случайная величина (т.е. числовая функция на

пространстве элементарных событий), поэтому пишем Y большое. Результат

Mx (Y ) (математическое ожидание) – это число, но зависящее от числового

параметра x. Но «число, зависящее от числа» – это самая обычная числовая

функция от числового аргумента!

Итак, корреляционная зависимость предполагает, что имеет место

функциональная зависимость математического ожидания Y от значения

x случайной величины X. Как правило, при этом можно вычислить и

функциональную зависимость математического ожидания X от значения y

случайной величины Y . Получаем такие функции

Mx (Y ) = ϕ(x),

My (X) = ψ(y).

Их графики называются кривыми регрессии соответственно Y на X и X на Y .

Регрессионный анализ. Совместный закон

распределения

Регрессионный анализ дает методы построения линий регрессии, т.е.

прямых, наилучшим образом приближающих кривые регрессии.

Пусть даны две дискретные случайные величины со значениями

X:

Y :

x1 , . . . , x k ;

y1 , . . . , y m .

Определение. Совместный (или парный, или двумерный) закон распределения

X и Y – это таблица

x1

..

.

xi

..

.

xk

y1

...

yj

...

ym

p11

...

p1j

...

p1m

pi1

...

pij

...

pim

pk1

...

pkj

...

pkm

где в клетках стоят вероятности всевозможных пар значений

pij = P {X = xi , Y = yj }.

Математические ожидания для совместного закона

распределения

Пусть дан совместный закон распределения. Суммы вероятностей по строкам

дают вероятности всех значений X, а суммы вероятностей по столбцам дают

вероятности всех значений Y :

P {X = xi } =

m

X

pij ,

P {Y = yj } =

j=1

k

X

pij .

i=1

Поэтому получаем два ряда распределения

X

P

x1

m

P

p1j

...

...

j=1

xk

m

P

pkj

j=1

Y

P

y1

k

P

pi1

...

...

i=1

i=1

Отсюда следует правило вычисления математических ожиданий

M (X) =

k X

m

X

i=1 j=1

xi pij ,

M (Y ) =

m X

k

X

j=1 i=1

ym

k

P

pim

yj pij .

Ковариация совместного закона распределения

Пусть дан совместный закон распределения. Вычислим математические

ожидания M (X), M (Y ). Тогда ковариация двух случайных величин X, Y

(см. определение выше) вычисляется по формулам

cov(X, Y ) =

k X

m

X

[xi − M (X)][yj − M (Y )]pij .

i=1 j=1

Теорема. Ковариацию двух случайных величин по совместному закону

распределения можно также вычислить по формуле

cov(X, Y )

=

=

M (XY ) − M (X)M

! (Y ) =

!

k P

m

k P

m

P

P

xi yj pij −

xi pij

i=1 j=1

i=1 j=1

m P

k

P

j=1 i=1

!

yj pij

.

Корреляционная таблица для выборок

Пусть дана выборка, сделанная одновременно по двум признакам, в результате

которой каждый из признаков имеет варианты

X = {xi } :

Y = {yj } :

x1 , . . . , x k ;

y1 , . . . , y m .

Определение. Корреляционная таблица парной выборки – это таблица

x1

..

.

xi

..

.

xk

y1

...

yj

...

ym

n11

...

n1j

...

n1m

ni1

...

nij

...

nim

nk1

...

nkj

...

nkm

где в клетках стоят количества nij , в которых встретилась каждая из

возможных пар значений (xi , yj ).

Ясно, что сумма целых чисел по всем клеткам дает объем выборки:

n=

k X

m

X

i=1 j=1

nij .

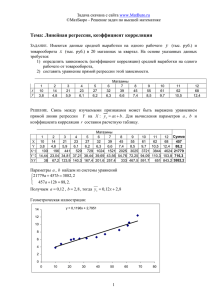

Поле корреляции

Пусть дана корреляционная таблица для парной выборки. В наиболее

распространенном случае в ней довольно много нулей (то есть не все пары

из k × m реально встречаются в выборке).

Нанесем на плоскость Oxy те из точек Mij (xi , yj ), для которых nij 6= 0.

Полученный рисунок называется полем корреляции. Задача регрессионного

анализа – построить прямую

y = b0 + b1 x,

которая наилучшим образом приближает (аппроксимирует) поле корреляции.

Линия регрессии

Как искать эту прямую? Вначале найдем так называемые групповые средние

признака Y , то есть средние арифметические признака Y в предположении,

что значение признака X в выборке фиксировано и взято равным некоторому

xi . Тогда от корреляционной таблицы останется одна строка, которая и дает

статистический ряд для признака Y в предположении, что X = xi :

y1

ni1

yj

N |X = xi

...

...

ym

nim

Соответствующее групповое среднее (взятое лишь по тем элементам выборки,

в которых имеется фиксированное xi ) обозначается y i и вычисляется по этому

статистическому ряду как обычно

m

P

yi =

nij yj

j=1

m

P

nij

j=1

(здесь в знаменателе стоит ni =

m

P

nij – количество элементов выборки в

j=1

данной группе, то есть объем i-ой группы – сумма клеточек по строке).

На предыдущем слайде на рисунке синей ломаной соединены точки для всех

xi с ординатами — групповыми средними y i .

Линия регрессии - II

Теперь мы получили двойной статистический ряд (ДСР), в котором уже

признак Y заменен на групповые средние:

xi

yi

ni

(ДСР):

x1

y1

n1

...

...

...

xk

yk

nk

Отсюда, во-первых, сразу находятся общие средние арифметические

признаков X и Y :

x=

y=

1

n

1

n

k

P

i=1

k

P

i=1

ni xi =

ni y i =

1

n

1

n

k P

n

P

i=1 j=1

k P

n

P

nij xi ,

nij yj

i=1 j=1

и по общим формулам соответствующие выборочные дисперсии s2x , s2y .

Линия регрессии - III

Во-вторых, линию регрессии Y на X для корреляционной

таблицы (для поля корреляции) находим, как линию регрессии для

полученного двойного статистического ряда (для функциональной

зависимости xi 7→ y i ):

y−y =

µ

(x − x).

s2x

Меняя местами x, y найдем и линию регрессии X на Y :

x−x=

µ

(y − y).

s2y

Здесь выборочная ковариация вычисляется по формуле

µ =

=

xy − x y =

!

k P

m

P

1

xi yj nij −

n

i=1 j=1

1

n2

k P

m

P

i=1 j=1

!

xi nij

m P

k

P

j=1 i=1

!

yj nij

.

Коэффициент корреляции

Выборочная ковариация имеет один существенный недостаток – она

зависит от единиц измерения, а именно, если один из признаков

умножить на некоторое число, то и ковариация умножится на

это число, хотя совершенно понятно, что характер связи между

признаками от этого не зависит. Поэтому нужно ввести показатель,

который измерял бы зависимость, находясь в некотором заданном

диапазоне.

Заметим, что если один из признаков умножить на некоторое число,

то выборочная дисперсия умножится на квадрат этого числа, зато

выборочное среднеквадратическое отклонение умножится тоже лишь

на само число. Поэтому вводят следующий признак.

Выборочный коэффициент корреляции двух признаков X и Y

определяется так:

µ

,

rxy =

sx sy

а sx , sy q– выборочные

p

среднеквадратические отклонения sx = s2x , sy = s2y .

где

µ

–

выборочная

ковариация,

Свойства коэффициента корреляции

Теорема. Выборочный коэффициент корреляции всегда изменяется

в пределах

−1 6 rxy 6 1.

Выборочный коэффициент корреляции характеризует тесноту

связи между признаками. Оценкой такой тесноты — задача

корреляционного анализа.

Если rxy = 0, то линейную связь между признаками установить

невозможно, линии регрессии идут под прямым углом друг к другу,

причем одна горизонтально, другая вертикально. Поле корреляции

почти равномерно заполняет прямоугольник.

Если значение rxy близко к ±1, то считается, что между признаками

имеется почти линейная связь, а знак коэффициента корреляции

говорит о том, как ведет себя один признак при изменении другого.

При rxy > 0 они возрастают или убывают одновременно, а при

rxy < 0 при возрастании одного из них второй убывает, и наоборот.

Контрольные вопросы

1. Аналогия ДСВ и выборок (составить сравнительную

таблицу).

2. Виды зависимостей между СВ (выборками).

3. Двойной статистический ряд и линия регрессии для

функциональной зависимости.

4. Критерий качества в методе наименьших квадратов.

5. Ковариация двух случайных величин.

функциональной зависимости.

Формула для

6. Регрессионный анализ. Совместный закон распределения.

Вычисление математических ожиданий.

7. Корреляционная таблица и поле корреляции.

8. Ковариация для корреляционной зависимости.

9. Линии регрессии для корреляционной зависимости.

10. Коэффициент корреляции, его свойства и смысл.