Модель машины неустойчивых состояний

advertisement

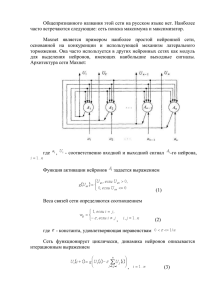

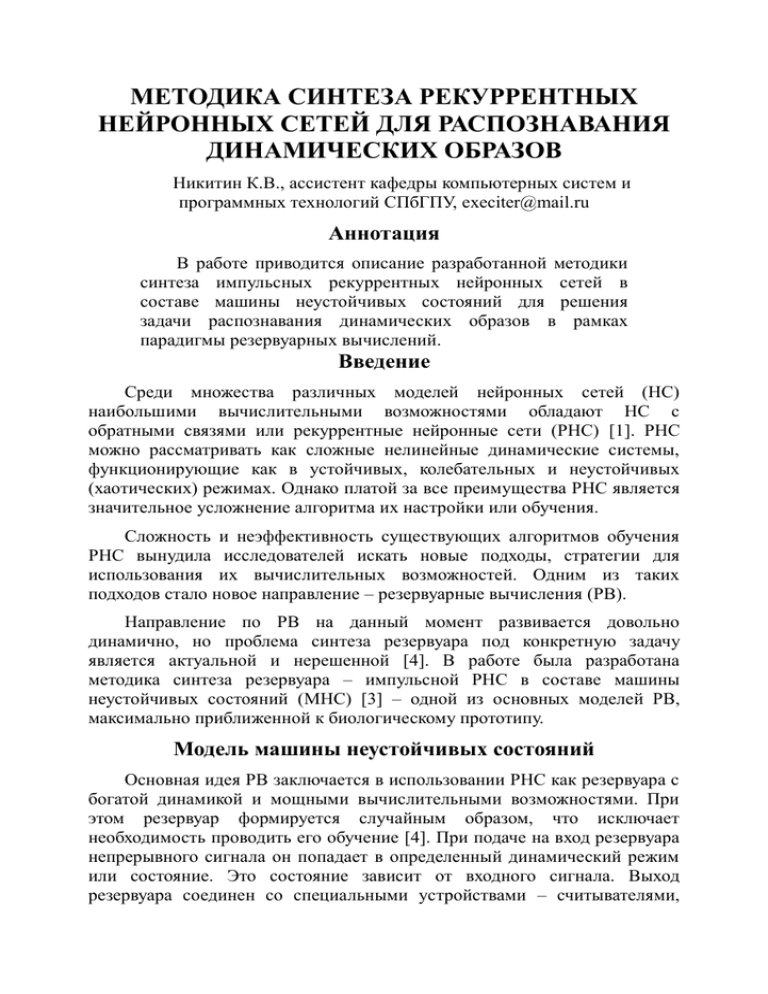

МЕТОДИКА СИНТЕЗА РЕКУРРЕНТНЫХ НЕЙРОННЫХ СЕТЕЙ ДЛЯ РАСПОЗНАВАНИЯ ДИНАМИЧЕСКИХ ОБРАЗОВ Никитин К.В., ассистент кафедры компьютерных систем и программных технологий СПбГПУ, execiter@mail.ru Аннотация В работе приводится описание разработанной методики синтеза импульсных рекуррентных нейронных сетей в составе машины неустойчивых состояний для решения задачи распознавания динамических образов в рамках парадигмы резервуарных вычислений. Введение Среди множества различных моделей нейронных сетей (НС) наибольшими вычислительными возможностями обладают НС с обратными связями или рекуррентные нейронные сети (РНС) [1]. РНС можно рассматривать как сложные нелинейные динамические системы, функционирующие как в устойчивых, колебательных и неустойчивых (хаотических) режимах. Однако платой за все преимущества РНС является значительное усложнение алгоритма их настройки или обучения. Сложность и неэффективность существующих алгоритмов обучения РНС вынудила исследователей искать новые подходы, стратегии для использования их вычислительных возможностей. Одним из таких подходов стало новое направление – резервуарные вычисления (РВ). Направление по РВ на данный момент развивается довольно динамично, но проблема синтеза резервуара под конкретную задачу является актуальной и нерешенной [4]. В работе была разработана методика синтеза резервуара – импульсной РНС в составе машины неустойчивых состояний (МНС) [3] – одной из основных моделей РВ, максимально приближенной к биологическому прототипу. Модель машины неустойчивых состояний Основная идея РВ заключается в использовании РНС как резервуара с богатой динамикой и мощными вычислительными возможностями. При этом резервуар формируется случайным образом, что исключает необходимость проводить его обучение [4]. При подаче на вход резервуара непрерывного сигнала он попадает в определенный динамический режим или состояние. Это состояние зависит от входного сигнала. Выход резервуара соединен со специальными устройствами – считывателями, которые выделяют из состояния резервуара полезную информацию и таким образом решают поставленную. Схема РВ в общем и МНС в частности, показана на рисунке 1. Резервуар LM Считыватели fM 1 i N Входные сигналы u(t) XM(t)=(LМu)(t) Состояние y(t)=fM(XM(t))) XM(t) Выходные сигналы y(t) Рисунок 1: Схема машины неустойчивых состояний Резервуар в МНС является импульсной РНС [2] со случайной 3-хмерной структурой, в которой импульсные нейроны соединены с помощью химических синапсов. Вероятность связи между двумя нейронами определяется по формуле [3]: P(a, b) min[ 1, C (a, b) exp( ( D(a, b) / )2 )] , где буквами a и b обозначаются два нейрона, D(a,b) – евклидово расстояние между нейронами, λ – средняя длина связи между нейронами, С(a,b) характеризует плотность связей. Обобщенная методика синтеза импульсных РНС Анализ результатов экспериментального исследования позволил построить обобщенную методику синтеза импульсных РНС и встроить ее в схему решения задачи распознавания динамических образов. Соответствующая схема представлена на рисунке 2. Далее рассмотрим подробно каждый шаг методики. Входные данные и их предобработка Входные данные представлены набором примеров динамических образов в виде пар «входной сигнал-соответствующий ему выходной сигнал». Входной и выходной сигнал в общем случае являются многомерными функциями времени, размерность входного сигнала nin, выходного – nout. Возможны два способа задания – непрерывная и импульсная. В непрерывном случае каждая входная и выходная функция задаются аналитически (точно) либо численно (приближенно). 1. Анализ задачи (входных данных) Нормализация Выбор способа подачи на вход резервуара 4. Оценка качества а. Выбор критериев (показателей) качества б. Оценка критериев в. Сравнение с требуемыми 2. Синтез резервуара а. Выбор типов нейронов и синапсов в зависимости от сложности задачи б. Задание фиксированных параметров резервуара в. Определение рекомендуемых диапазонов варьируемых параметров г. Задание варьируемых параметров д. Подстройка варьируемых параметров для улучшения показателей качества резервуара 3. Выбор считывателя а. Выбор алгоритма преобразования и его параметров на основании динамики резервуара б. Выбор алгоритма сокращения размерности аналогового сигнала в. Выбор алгоритма классификации/ кластеризации г. Подбор наилучших параметров классификатора Рисунок 2: Методика синтеза импульсных РНС при решения задачи распознавания динамических образов с помощью МНС При численном задании входная функция времени разбивается на набор интервалов и на каждом интервале задается значение этой функции. Количество интервалов определяет точность задания функции. Важными параметрами является количество и качество примеров. После того, как определен набор примеров, необходимо выбрать способ их подачи на вход резервуара – импульсной РНС. Предпочтительной является импульсная форма представления входных сигналов. Поэтому если входной сигнал задан непрерывно, следует выполнить преобразование этого сигнала в импульсную форму. Среди всех алгоритмов преобразования из непрерывной в импульсную форму следует отдать предпочтение алгоритмам на основе пространственновременного кодирования (п. 2.4.4), в частности, алгоритму на основе рецептивных полей. Этот алгоритм автоматически выполняет нормировку входных данных, поэтому никакая дополнительная предобработка не требуется. Ключевыми параметрами этого алгоритма являются kx – во сколько импульсных входов преобразуется каждый непрерывный вход и Tmin – минимальный период импульсов. При выборе их значений следует руководствоваться соображениями, что чем сложнее форма непрерывного сигнала, тем больше значение kx следует задавать). Следует начинать со значения kx, равного 8 и далее увеличивая до 16, 32 и т.д. Минимальный период Tmin следует задавать не меньше чем 1мс и не больше, чем постоянная времени нейрона (20-30 мс). Если входной сигнал подается напрямую в непрерывной форме, то необходимо произвести его нормирование, так чтобы значения, которые он принимает, лежали в диапазоне от 0 до 1. Помимо проблемы представления входных данных в импульсной форме существует проблема, связанная с временем представления входных образов. Это время не должно превышать глубину памяти резервуара – в противном случае часть информации о входном сигнале будет «забыта». Для решения этой проблемы может быть использована техника нормализации сигналов во временном диапазоне. Средняя глубина памяти импульсной РНС равна 0.1–0.5 с. Если время представления входного образа превышает эти значения, следует сжать входной образ во времени до tnorm (например, до 0.25 с). Синтез резервуара Вначале определяется количество входов nvh РНС. Если преобразования из непрерывной в импульсную форму не происходит, то оно равно количеству входных сигналов nin, если преобразование выполняется, то количество входов равно произведению количества входных сигналов на коэффициент размножения по входам kx. Вероятность связи между входами и нейронами резервуара pvh следует задать равной 10-20 %. Количество нейронов nnrn резервуара определяется сложностью задачи распознавания и количеством входов. Чем выше сложность и чем больше количество входов, тем больше должно быть нейронов. Минимально-допустимое значение числа нейронов равно 125 и соответствует трехмерной решетке 5х5х5. Процент подавляющих нейронов pinh задается равным 20-30 % для любых типов нейронов. Средняя длина связей λ вначале задается равной 2. Затем можно будет скорректировать это значение, немного увеличив его (предельное значение равно 3). Плотность связей задается матрицей C размерности 2x2 (С[i,j] – плотность связей между нейронами типа i и нейронами типа j, где тип 1 – подавляющий, тип 2 – возбуждающий). Возможные значения матрицы C: 0.4 0.4 , 0.1 0.4 . С С 0.2 0.4 0.2 0.3 На основании значений nnrn, nvh, pvh, pinh, С, λ и формулы (2.36) случайным образом генерируется структура РНС, содержащая информацию о наличии/отсутствии связей между входами и нейронами и между нейронами. Формально структуру можно описать с помощью матриц Hvh, Hint: Hvh[i,j] = 1, если связь между i входом и j входом есть; Hvh[i,j] = 0, если связь отсутствует; Hint[i,j] = 1, если связь между i и j нейроном есть; Hint[i,j] = 0, если связь между i и j нейроном отсутствует. Тип нейронов. В качестве нейронов могут использоваться как простые нейроны типа «интегрирование и возбуждение», так и более сложные нейроны – Ижикевича, Ходжкина-Хаксли, Морриса-Лекара. Выбор той или иной модели зависит от сложности задачи. Для простых задач можно обойтись более простыми моделями «интегрирование и возбуждение», для более сложных задач – модели нейронов с более сложной динамикой (Ижикевича и др.). Выбор более сложной модели нейрона позволяет увеличить память резервуара за счет более длительной и уникальной реакции в ответ на входной изменяющийся сигнал. При использовании нейронов типа «интегрирование и возбуждение» следует инициализировать их базовые параметры следующими значениями: vrest=vreset=0, θ=15мВ, Trefrac=3мс, τ=30мс, утечка есть. При использовании нейронов Ижикевича в качестве возбуждающих нейронов следует использовать модель RS с параметрами: a=0.02, b=0.2, c=-65, d=8, а в качестве подавляющих нейронов модель FS с параметрами: a=0.1, b=0.2, c= -65, d=2. Тип связей – синапсов так же, как и тип нейронов определяется сложностью задачи, а также типом связи. Для связей, передающих входные непрерывные сигналы, используются электрические синапсы. Для связей, передающих импульсные входные сигналы, а также для всех связей между импульсными нейронами используются химические синапсы. Для увеличения вычислительных возможностей (нелинейность, глубина памяти) используются динамические синапсы с кратковременной памятью. Для адаптации РНС к входному импульсной сигналу используются синапсы с пластичностью, обладающие долговременной памятью. Сила связей для всех синапсов вначале может быть задана детерминированной. Сила связей между входами и нейронами для электрических синапсов задается вектором Wvh(el) из двух значений (1-е – для подавляющих нейронов, 2-е – для возбуждающих нейронов). Для нейронов «интегрировании и возбуждение» возможные значения Wvh(el) следующие: Wvh ( el ) 0.01 0.01 , Wvh ( el ) 0.03 0.03 , а для нейронов Ижикевича: Wvh ( el ) 0.005 0.005 , Wvh ( el ) 0.03 0.03. При этом значения непрерывного входного сигнала должны быть нормализованы и приведены к диапазону от 0 до 1. Сила связей между входами и нейронами для химических синапсов задается вектором Wvh(chem) из двух значений (1-е – для подавляющих нейронов, 2-е – для возбуждающих нейронов). Для нейронов «интегрирование и возбуждение» (а) и нейронов Ижикевича (б) возможные значения Wvh(chem) следующие: а) Wvh ( chem) 0.03 0.03 , б) Wvh ( chem) 0.01 0.01 . Сила связей между нейронами (для химических синапсов) задается матрицей Wint размерности 2x2 (Wint[i,j] – сила связи между нейроном типа i и нейроном типа j, где тип 1 – подавляющий, тип 2 – возбуждающий). Для нейронов «интегрирование и возбуждение» (а) и нейронов Ижикевича (б) матрица Wint задается следующим образом: 0.02 0.01 0.001 0.01 а) Wint 0.01 0.05 , б) Wint 0.01 0.015 . В дальнейшем силы связей можно сделать случайными – распределенными нормально с МО, равными приведенным выше значениям и СКО, равными 10-30% от значений математических ожиданий. Постоянная времени затухания τsyn импульсного тока задается для химических синапсов от входов и возбуждающих нейронов равной 3 мс и для подавляющих нейронов – 6 мс. Задержки τdelay для химических синапсов задаются равными 1 мс. Выбор считывающих модулей Последовательность выбора считывателей можно представить следующим образом: определение времени считывания – лучшие результаты получаются при времени считывании, соответствующем подаче ¾ входного образа; выбор алгоритма преобразования из импульсной формы в непрерывную – рекомендуемым является алгоритм, основанный на замене каждого импульса экспоненциально затухающим сигналом с постоянной времени τwindow=5-20 мс; выбор алгоритма сокращения размерности числа признаков – могут быть использованы как «фильтр» (PCA, LDA, Relieff, ISOMAP и др.), так и «враппер» методы; количество компонент – от 5 до 20; выбор алгоритма решения конечной задачи: классификация – НСПР, SVM, PNN, LVQ, k-NN, аппроксимация – НСПР, РБФНС, кластеризация – k-means, GMM. Оценка качества распознавания После того, как пройдены все предыдущие этапы, можно приступать непосредственно к решению поставленной задачи распознавания динамических образов и оценивать качество распознавания. Для этого лучше всего подходит процедура кросс-валидации. Для расчета ошибки классификатора лучше всего вначале посчитать матрицу неточностей и по ней уже определить вероятности ошибок 1-го, 2го родов для каждого из m классов. В качестве ошибки аппроксимации можно использовать усредненную (максимальную) абсолютную или относительную ошибки по всему множеству тестовых примеров. При решении задачи кластеризации качество анализируется с помощью специальных показателей – индекса Дэвиса-Болдуина, индекса Дана и др. В случае, если полученное качество распознавания не устраивает, можно вернуться на один из предыдущих этапов. В итоге выполнения всех описанных выше действий (шагов) и рекомендаций задача распознавания динамических образов будет решена с требуемым качеством. Заключение Разработанная методика синтеза импульсных РНС в составе МНС отличается от известных подходов системностью, универсальностью, большей детализацией, что позволяет проводить целенаправленный синтез резервуара с требуемыми показателями, снизить трудоемкость разработки систем распознавания динамических образов и использовать новую модель МНС в системах резервуарных вычислений для задач распознавания динамических образов. Применение методики для решения с помощью МНС задачи обработки реальных данных – электрокардиограмм с различными формами аритмии позволило повысить качество распознавания на 5-7 % по сравнению с известными классическими подходами. Таким образом, предложенная методика синтеза импульсных РНС может дополнить существующие подходы в системах обработки информации и распознавания динамических образов для повышения качества и скорости их работы. Список литературы 1. Хайкин, С. Нейронные сети: полный курс: [пер. с англ.] / С. Хайкин, 2-е изд. – М. : Вильямс, 2000. – 1104 с. 2. Gerstner, W. Spiking Neuron Models. Single Neurons, Populations, Plasticity / W. Gerstner, W. M Kistler. – Cambridge : Cambridge University Press, 2002. – 480 p. 3. Maass, W. Real-time computing without stable states: a new framework for neural computations based on perturbations / W. Maass, T. Natschläger, H. Markram // Neural Computation. – 2002. Vol. 11. – P. 2531-2560. 4. Schrauwen, B. An overview of reservoir computing theory, applications and implementations / B. Schrauwen, D. Verstraeten, J. V. Campenhout // Proc. of the 15th European Symposium on ANN. – 2007. – P. 471-482.