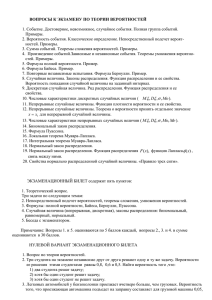

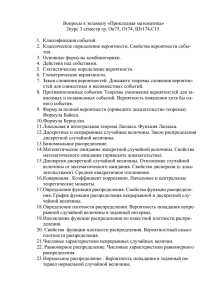

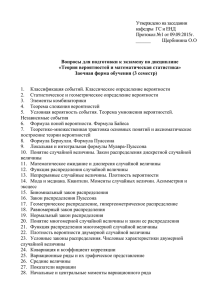

ЕН.Ф.1.2. Математика вероятность и статистика

advertisement