Михайлычева Марина Вячеславовна

advertisement

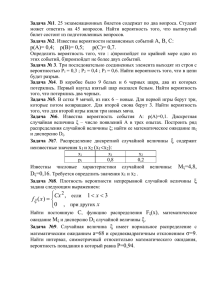

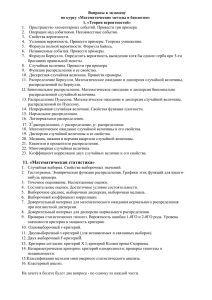

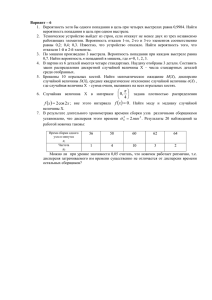

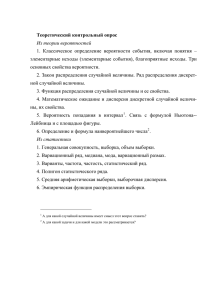

Статистическое исследование погрешности округления решения линейной алгебраической системы Михайлычева Марина Вячеславовна, г. Н. Новгород, Нижегородский Технический Лицей, класс 11. Научный руководитель доцент кафедры Теоретической механики МеханикоМатематического факультета ННГУ им. Н.И. Лобачевского Ляхов Александр Федорович. Одним из наиболее важных вопросов при проведении вычислений является вопрос о том, как возникают вычислительные погрешности и как они затем изменяются и распространяются, т.е. увеличивается или уменьшается их влияние при выполнении последовательных операций. Существующие в настоящее время методы оценки погрешности вычислений очень трудоемки и приводят к завышенным значениям. В связи с этим все больший интерес вызывают вероятностные и статистические подходы к получению оценки погрешностей. Известно, что при любом измерении, значения определяемой величины находится вместе с доверительным интервалом и доверительной вероятностью. Точность измерений определяется шкалой измерительного прибора, и за величину погрешности обычно берут значение равное половине минимального деления шкалы, однако реальная погрешность может принимать любое значение из интервала деления шкалы. Это значение носит случайный характер и, следуя [2], можно предположить, что оно будет иметь равномерное распределение. Следовательно, погрешности коэффициентов, используемых при любых вычислениях, носят вероятностный характер, и возникает вопрос, какими вероятностными характеристиками будут обладать погрешности результата вычислений. Цель работы: Проанализировать статистические характеристики погрешности округления решений системы линейных уравнений, методом Гаусса, при условии, что в коэффициенты системы и правые части внесены начальные погрешности, имеющие равномерное распределение. Рассмотрим систему линейных алгебраических уравнений A x f , (1) где A матрица m m , x ( x1 , x2 ,... xm )T искомый вектор, f ( f1 , f 2 ,..., f m )T заданный вектор. Будем предполагать, что определитель матрицы A отличен от нуля, т.е. решение системы (1) существует [1,2]. Методы численного решения системы (1) делятся на две группы: прямые методы («точные») и итерационные методы. Прямыми методами называются методы, позволяющие получить решение системы (1) за конечное число арифметических операций. К этим методам относятся метод Крамера, метод Гаусса. Итерационные методы (методы последовательных приближений) состоят в том, что решение системы (1) находится как предел последовательных приближений x (n) при n , где n номер итерации. При использовании методов итерации обычно задается некоторое малое число 0, и вычисления проводятся до тех пор, пока не будет выполнена оценка x ( n) x . К этим методам относятся метод Зейделя, Якоби. Корректность постановки задачи и понятие обусловленности При использовании численных методов для решения тех или иных математических задач необходимо различать свойства самой задачи и свойства вычислительного алгоритма, предназначенного для ее решения. Говорят, что задача поставлена корректно, если решение существует и единственно, и если оно непрерывно зависит от входных данных. Последнее свойство называется также устойчивостью относительно входных данных. 2 Корректность исходной математической задачи еще не гарантирует хороших свойств численного метода ее решений и требует специального исследования. Известно, что решение задачи (1) существует тогда и только тогда, когда det A 0 . В этом случае можно определить обратную матрицу A 1 и решение записать в виде x A1 f . Исследование устойчивости задачи (1) сводится к исследованию зависимости ее решения от правых частей f и элементов a ij матрицы А. Для того чтобы можно было говорить о непрерывной зависимости вектора решений от некоторых параметров, необходимо на множестве m - мерных векторов принадлежащих линейному пространству H, ввести метрику. В линейной алгебре предлагается определение множества метрик l p норма, x p m p xi i 1 1 p из которого легко получить наиболее часто используемые метрики m при р=1, x 1 xi , i 1 1 при p , x 2 2 m 1/ 2 xi , i 1 2 при p , x m p lim xi p i 1 1 p max xi . i i m Подчиненные нормы матриц определяемые как A sup Ax 0 xH x , соответственно запи- шутся в следующем виде: m m m m A 1 max aij , A max aij , A 2 ( AT A) a ij2 . 1 j m i 1 1i m i 1 i 1 j 1 Обычно рассматривают два вида устойчивости решения системы (1):первый по правым частям, второй по коэффициентам системы(1) и по правым частям. Наряду с исходной системой (1) рассмотрим систему с «возмущенными» правыми частями ~ A ~ x f , ~ где f f f возмущенная правая часть системы, а ~ x x x возмущенное решение. Можно получить оценку, выражающую зависимость относительной погрешности решения от относительной погрешности правых частей f x , MA x f где M A A A 1 число обусловленности матрицы А ( в современной литературе это число обозначают как condA ) Если число обусловленности велико ( M A 10 k k 2 ), то говорят, что матрица А плохо обусловлена. В этом случае малые возмущения правых частей системы (1), вызванные либо неточностью задания исходных данных, либо вызванные погрешностями вычисления существенно влияют на решение системы. Грубо говоря, если погрешность правых частей 10 l , то погрешность решения будет 10 lk . Более подробно о свойствах числа обусловленности и оценка его величины можно прочитать в [3]. Метод Гаусса Метод Гаусса применим для решения системы линейных алгебраических уравнений с невырожденной матрицей системы. Идея метода Гаусса состоит в том, что систему n линейных алгебраических уравнений относительно n неизвестных x1 , x2 , ..., xn 3 a11 x1 a12 x2 ... a1n xn b1 a x a x ... a x b 21 1 22 2 2n n 2 ... an1 x1 an 2 x2 ... ann xn bn приводят последовательным исключением неизвестных к эквивалентной системе с треугольной матрицей x1 c12 x 2 ... c1n x n d1 x ... c x d 2 2n n 2 ... xn d n решение которой находят по рекуррентным формулам: xn =dn , xi = di -S nk=i+1 cik xk , i=n-1, n-2, ...,1. Статистические характеристики, частота и вероятность Поскольку данная работа посвящена статистическим методам оценки погрешности вычислений, приведем определения основных статистических характеристик случайных процессов. В дальнейшем под вероятностью некоторой случайной величины будем понимать предел последовательности относительных частот появления этой величины при серии испыта- ний. 1. Математическое ожидание случайной величины. Математическим ожиданием случайной величины М(X) (или средним значением) называется сумма произведений всех ее значений на соответствующие им вероятности: n М ( X ) xi p i i 1 2. Дисперсия случайной величины. Дисперсией случайной величины D(X) (разброс случайной величины) называется сумма произведений квадрата разности случайной величины и математического ожидания (а) на соответствующую вероятность: n D( X ) ( x i a ) 2 p i i 1 3. Энтропия опыта. Энтропией опыта (мера неопределенности) называется сумма произведений соответствующих возможным исходам опыта вероятностей на логарифм данных вероятностей по двум, взятых с отрицательным знаком: n H ( X ) ( pi log 2 pi ) i 1 Алгоритм численного эксперимента Для того чтобы провести исследования была разработана программа, которая реализовала следующий алгоритм: 1. Создавалась система n линейных уравнений, коэффициенты которой содержали, пять значащих цифр. 2. Система решалась методом Гаусса с точностью – пять знаков после запятой. К коэффициентам исходной системы прибавлялись погрешности, которые моделировались с помощью квазигенератора Pascal. Минимальное значение погрешности – 0,00001, максимальное - 0,00009 . 3. Методом Гаусса находилось решение возмущенной системы линейных уравнений. 4. Из решений возмущенной системы вычитались решения исходной системы, в результате получалась погрешность решения: x- x = x 4 5. Погрешность оценивалась по третьей норме x max xi . 1i n 6. В программе был реализован счетчик, учитывающий количество значений полученной погрешности при многократной генерации погрешностей исходной системы и выполнении пункта 4. Процедура проделывалась 104. Таким образом, была получена относительная частота появления того или иного значения погрешности P( x ). 7. Вычислялось приближенное значение вероятности данной погрешности. 8. Вычислялись следующие статистические характеристики: математическое ожидание, дисперсия, энтропия опыта. 9. Строилась графическая зависимость P( x ). Для определения некоторых параметров исходной системы: определителя и числа обусловленности, использовалась лабораторная работа "Прямые методы решения систем линейных алгебраических уравнений" Ляхов А.Ф., Солдатова Л.В., http://www.unn.ru/rus/books/table.html. Результаты численного эксперимента Проведенный эксперимент показал, что вероятностные характеристики решения связаны с числом обусловленности системы. Эксперимент осуществлялся на системах уравнений второго, третьего, четвертого и пятого порядков. Следует отметить, что все приведенные графические зависимости, полученные в результате эксперимента, представляют собой усредненные значения частот для трех исследуемых систем. Система второго порядка 1. Плохо обусловленные системы (число обусловленности A ~800 – 3000): 1. 9,14567 9,12323 x1 8,41546 8,41551 x2 2,12315 1,11433 ( A = 1780,8185; Определитель=0,1802) Энтропия Математическое ожидание случайной величины Дисперсия случайной величины H= 3.14046521 E(X)=0.00003479 var(X)= 0.0000208 2. 7,12565 7,11125 x1 6,11112 6,11111 x2 2,22125 8,14652 ( A = 2143,21607; Определитель=11.37283) Энтропия H= 1.64560031 Математическое ожидание случайной величины E(X)= 0.00001528 Дисперсия случайной величины var(X)= 0.00001473 3. 2,12565 2,11125 x1 1,11112 1,11111 x2 2,22112 8,14651 ( A = 858,25027; Определитель=0,01598) Энтропия H= 1.59924947 Математическое ожидание случайной величины E(X)= 0.00001358 Дисперсия случайной величины var(X)= 7.0000131 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.1: 5 1 P 0.8 0.6 0.4 0.2 0 -0.2 0 0.00002 0.00004 0.00006 0.00008 0.0001 0.00012 x Рис.1 2. Хорошо обусловленные системы (число обусловленности A ~4,9147 – 12,8329). 1. 2,32651 8,54162 x1 2,47559 9,12735 8,15492 x2 6,89115 ( A = 4,9147; Определитель=-58,9201) Энтропия H=0.46772634 Математическое ожидание случайной величины E(X)=0.000001 Дисперсия случайной величины var(X)= 0.0000005 2. 5,58941 8,87951 x1 3,78941 3,78951 9,78214 x2 3,41455 ( A = 12,8329; Определитель=21,0442) Энтропия H=1.98625964 Математическое ожидание случайной величины Е(X)= 0.00001197 Дисперсия случайной величины var(X)= 0.00000931 3. 3,62251 8,16382 x1 1,45656 8,11645 9,14653 x2 9,48515 ( A = 9,0205; Определитель=-33,1278) Энтропия H= 2.53330075 Математическое ожидание случайной величины E(X)= 0.0000245 Дисперсия случайной величины var(X)= 0.00002308 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.2: P 0.25 0.2 0.15 0.1 0.05 0 0 0.00001 0.00002 0.00003 0.00004 0.00005 x Рис.2 0.00006 0.00007 0.00008 0.00009 0.0001 6 Общий случай (число обусловленности A ~36 – 37,8). 1. 9,12451 8,14152 x1 9,14745 9,14452 x2 2,44556 6,44115 ( A =37,2812Определитель системы =8,9651) Энтропия H=2,41938751 Математическое ожидание случайной величины E(X)=0.00002195 Дисперсия случайной величины var(X)=0.0000208 2. 9,98441 8,18452 x1 9,59745 9,14452 x2 2,44236 6,94135 ( A = 37,8812; Определитель=12,7520) Энтропия H=2,74303294 Математическое ожидание случайной величины Е(X)=0.00002306 Дисперсия случайной величины var(X)=0.00002033 3. 6,57541 8,87891 x1 9,73941 1,76853 1,68318 x2 3,41847 ( A = 36,9044; Определитель=-4,5462) Энтропия H= 1.62899156 Математическое ожидание случайной величины E(X)= 0.00008 Дисперсия случайной величины var(X)= 0.0000208 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.3: 0,35000 P 0,30000 0,25000 0,20000 0,15000 0,10000 0,05000 0,00000 -0,05000 0 0,00001 0,00002 0,00003 0,00004 0,00005 0,00006 0,00007 0,00008 0,00009 0,0001 x Рис.3 Можно видеть, что распределение частот погрешностей для хорошо обусловленных системы ближе к равномерному распределению, чем для частот плохо обусловленных систем. 7 Система третьего порядка1 1. Плохо обусловленная система 9.14586 3.45698 2.21575 1.78652 x1 7.98714 4.58263 x2 = 6.54431 1.15426 x3 7.88933 1.15758 7.28488 1.74893 ( A =166,90422; Определитель=1,6319) Энтропия H= 3.02645831 Математическое ожидание случайной величины E(X)= 0.00004688 Дисперсия случайной величины var(X)= 0.00002588 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.4: P 0.2 0.15 0.1 0.05 0 0 0.00002 0.00004 0.00006 0.00008 0.0001 x Рис.4 2. Хорошо обусловленная система 1.14586 3.45698 1.21575 1.15758 1.28488 1.74893 1.78652 x1 7.98714 6.58263 x2 = 6.54431 1.15426 x3 7.88933 ( A =4,25228; Определитель=493,701) Энтропия H= 3,05257554 Математическое ожидание случайной величины E(X)= 0.0000416 Дисперсия случайной величины var(X)= 0.00002981 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.5: Далее будет приведена только одна из трех исследованных систем, а зависимость частот усреднена по всем системам. 1 P 8 0.25 0.2 0.15 0.1 0.05 0 0 0.00002 0.00004 0.00006 0.00008 0.0001 x Рис.5 3. Система общего вида. 3,14789 5,14512 5,47855 x1 8,12135 7,14542 9,22156 6,45781 x2 4,45788 2,54541 1,45575 x3 4,54549 3,12145 ( A =32.18179; Определитель=-40,45851) Энтропия H= 3.00347389 Математическое ожидание случайной величины E(X)= 0.00002959 Дисперсия случайной величины var(X)= 0.00002677 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.6: 1 P 0,8 0,6 0,4 0,2 0 -0,2 0 0,00002 0,00004 0,00006 0,00008 0,0001 x Рис.6 Можно видеть, что распределение частот погрешностей для хорошо обусловленных системы ближе к равномерному распределению, чем для частот плохо обусловленных систем. 1. Система четвертого порядка Плохо обусловленная система. 9.14586 3.45698 2.21575 9.56797 1.15758 7.28488 1.74893 1.27140 1.78652 4.58263 1.15426 8.77435 1.24782 1.28946 1.97513 9.18353 x1 x2 x3 x4 7.98714 = 6.54431 7.88933 1.11119 ( A =1300,5485; Определитель=840,10149); Энтропия H= 0.78611491 Математическое ожидание случайной величины E(X)= 0.00007888 Дисперсия случайной величины var(X)= 0.00000180 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.7: 9 1 0.8 P 0.6 0.4 0.2 0 -0.2 0 0.00002 0.00004 0.00006 0.00008 0.0001 x Рис.7 2. Хорошо обусловленная система. 9.14586 1.45698 1.21575 9.56797 9.15758 9.28488 9.74893 1.27140 1.78652 9.58263 9.15426 1.77435 9.24782 9.28946 1.97513 9.18353 x1 x2 x3 x4 7.98714 = 6.54431 7.88933 1.11119 ( A =9,41844; Определитель=8536,59687); Энтропия H= 0.90847124 Математическое ожидание случайной величины E(X)= 0.00009351 Дисперсия случайной величины var(X)= 0.00000214 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.8: 0.8 0.6 P 0.4 0.2 0 -0.2 0 0.00002 0.00004 0.00006 0.00008 0.0001 x Рис.8 3. Система общего вида. 3,14789 7,14542 4,45788 3,12546 5,14512 9,22156 2,54541 4,12456 5,47855 6,45781 1,45575 6,25665 9,44458 8,14541 3,24564 7,54656 x1 x2 x3 x4 2,15466 5,47556 3,15466 7,15465 ( A =13,5583; Определитель=1840,10149); 10 Энтропия H= 3.15525183 Математическое ожидание случайной величины E(X)= 0.00003286 Дисперсия случайной величины var(X)= 0.00002977 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.9: P 0.4 0.3 0.2 0.1 0 0 0.00002 0.00004 0.00006 0.00008 0.0001 x Рис.9 Система пятого порядка 1. Плохо обусловленная система 2.14586 3.45698 7.21576 4.56897 6.66422 3.15748 7.25488 8.74895 3.27140 8.89875 9.78653 4.58263 3.15425 8.97434 3.45870 1.24782 2.18947 7.97513 6.12354 3.46878 7.89750 6.23589 7.58213 7.89653 5.66784 x1 x2 x3 x4 7.98725 6.55431 7.88992 1.11112 7.89541 = x5 ( A =123,3692; Определитель=745.8421) Энтропия H= 0.43202343 Математическое ожидание случайной величины E(X)= 0.00000361 Дисперсия случайной величины var(X)= 0.00000358 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.10: P 0,6 0,4 0,2 0 -0,2 0 0,00002 0,00004 0,00006 0,00008 0,0001 x Рис.10 2. Хорошо обусловленная система. 1.14586 3.45698 2.21576 9.56897 1.66422 1.15748 7.25488 1.74895 1.27140 1.89875 1.78653 4.58263 1.15425 8.97434 1.45870 1.24782 1.18947 1.97513 6.12354 3.46878 7.89750 6.23589 7.58213 1.89653 5.66784 x1 x2 x3 x4 x5 ( A =2,88682; Определитель=60440) Энтропия H= 1.08093247 Математическое ожидание случайной величины E(X)= 0.00009351 7.98725 6.55431 = 7.88992 1.11112 7.89541 11 Дисперсия случайной величины var(X)= 0.00000859 P Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.11: 0.06 0.05 0.04 0.03 0.02 0.01 0 0 0.00002 0.00004 0.00006 0.00008 0.0001 x Рис.11 3. Система общего вида. 1.14586 3.45698 2.21576 9.56897 1.66422 1.15748 7.25488 1.74895 1.27140 1.89875 1.78653 4.58263 1.15425 8.97434 1.45870 1.24782 1.18947 1.97513 6.12354 3.46878 7.89750 6.23589 7.58213 1.89653 5.66784 x1 x2 x3 x4 7.98725 6.55431 7.88992 1.11112 7.89541 = x5 ( A =43,11121; Определитель=-1611) Энтропия H= 1.36674117 Математическое ожидание случайной величины E(X)= 0.00009089 Дисперсия случайной величины var(X)= 0.00001130 Для рассматриваемых систем усредненная зависимость P( x ) показана на рис.12: 0.8 0.6 P 0.4 0.2 0 -0.2 0 0.00002 0.00004 0.00006 0.00008 0.0001 x Рис.12 Выводы Приведем сводные таблицы средних значений всех основных характеристик, по которым проводилось сравнение порядок системы Энтропия опыта H(X) Математическое ожидание E(X) Число обусловленности A ~2 – 12,8329 2 3 4 1,6624 3,0525 0,9084 0,00000124 0,00004160 0,00009351 Дисперсия var(X) 0,00001090 0,00002588 0,00002140 12 5 1,0809 0,00009351 Число обусловленности A ~36 – 43,11 0,00001130 2 3 4 5 2,2637 3,0640 3,1552 1,3667 0,0000428 0,0000295 0,0000328 0,0000908 Число обусловленности A ~745 – 3000 0,0000206 0,0000267 0,0000297 0,0000113 2 3 4 5 2,1284 3,0264 0,7861 0,4320 0,00000211 0,00004588 0,00007888 0,00000361 0,00001620 0,00002588 0,00001800 0,00000358 1. Наибольшая энтропия наблюдается у систем общего вида ( A ~36 – 43,11) и хорошо обусловленных систем ( A ~2 – 12,8329), наименьшее значение энтропии у плохо обусловленных систем ( A ~745 – 3000). 2. Наибольшее математическое ожидание погрешности у хорошо обусловленных систем ( A ~2 – 12,8329), чуть большое значение у систем общего вида ( A ~36 – 43,11), и наименьшее значение у плохо обусловленных систем ( A ~745 – 3000). 3. Самая большая дисперсия, т.е. разброс случайной величины у систем общего вида ( A ~36 – 43,11), и хорошо обусловленных систем ( A ~2 – 12,8329), наименьшее значение дисперсии у плохо обусловленных систем ( A ~745 – 3000). 4. Сравнение графических зависимостей частот появления погрешностей показывает, что погрешности хорошо обусловленных систем имеют распределение более близкое к равномерному распределению, чем погрешности плохо обусловленных систем. 1. 2. 3. 4. Литература, использованная в работе Ляхов А. Ф. Элементарная теория погрешностей – Математическое образование, № 3-4, 1998г. Хемминг Р. В. Численные методы. – М. Наука, 1968. А. М. Яглом, И. М. Яглом Вероятность и информация. М., Наука, 1973. Мак-Кракен Д. Численные методы и программирование на Фортране. - М.: Мир.