Непрерывные случайные величины.

advertisement

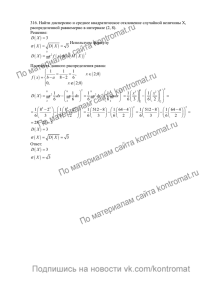

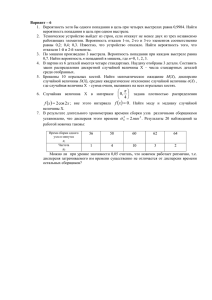

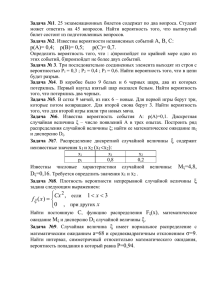

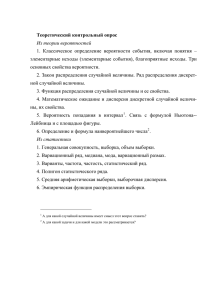

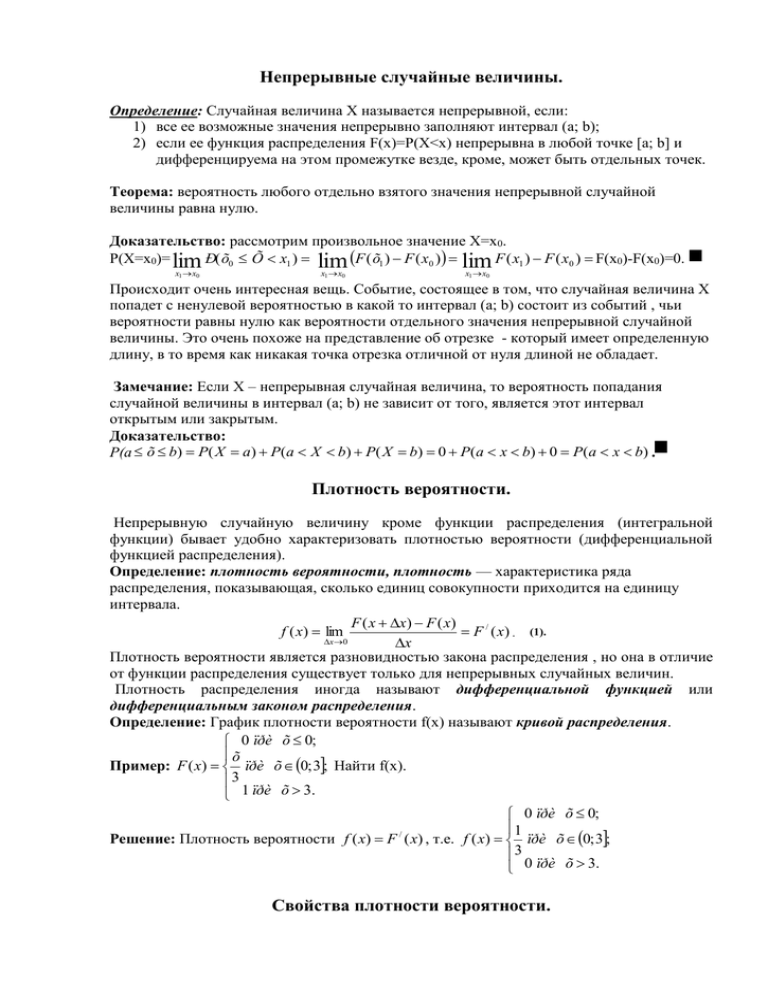

Непрерывные случайные величины. Определение: Случайная величина Х называется непрерывной, если: 1) все ее возможные значения непрерывно заполняют интервал (a; b); 2) если ее функция распределения F(x)=Р(Х<x) непрерывна в любой точке [а; b] и дифференцируема на этом промежутке везде, кроме, может быть отдельных точек. Теорема: вероятность любого отдельно взятого значения непрерывной случайной величины равна нулю. Доказательство: рассмотрим произвольное значение Х=х0. Р(Х=х0)= lim Ð( õ0 Õ x1 ) lim F ( õ1 ) F ( x0 ) lim F ( x1 ) F ( x0 ) F(x0)-F(x0)=0. x1 x0 x1 x0 x1 x0 Происходит очень интересная вещь. Событие, состоящее в том, что случайная величина Х попадет с ненулевой вероятностью в какой то интервал (a; b) состоит из событий , чьи вероятности равны нулю как вероятности отдельного значения непрерывной случайной величины. Это очень похоже на представление об отрезке - который имеет определенную длину, в то время как никакая точка отрезка отличной от нуля длиной не обладает. Замечание: Если Х – непрерывная случайная величина, то вероятность попадания случайной величины в интервал (a; b) не зависит от того, является этот интервал открытым или закрытым. Доказательство: Р(а õ b) P( X a) P(a X b) P( X b) 0 P(a x b) 0 P(a x b) . Плотность вероятности. Непрерывную случайную величину кроме функции распределения (интегральной функции) бывает удобно характеризовать плотностью вероятности (дифференциальной функцией распределения). Определение: плотность вероятности, плотность — характеристика ряда распределения, показывающая, сколько единиц совокупности приходится на единицу интервала. F ( x x) F ( x) f ( x) lim F / ( x) . (1). x 0 x Плотность вероятности является разновидностью закона распределения , но она в отличие от функции распределения существует только для непрерывных случайных величин. Плотность распределения иногда называют дифференциальной функцией или дифференциальным законом распределения. Определение: График плотности вероятности f(x) называют кривой распределения. 0 ïðè õ 0; õ Пример: F ( x) ïðè õ 0; 3; Найти f(x). 3 1 ïðè õ 3. 0 ïðè õ 0; 1 Решение: Плотность вероятности f ( x) F / ( x) , т.е. f ( x) ïðè õ 0; 3; 3 0 ïðè õ 3. Свойства плотности вероятности. 1. Плотность распределения – неотрицательная функция. f ( x ) 0. (2) Доказательство: Плотность вероятности f ( x) F / ( x) , а F(x) неубывающая функция, следовательно f ( x ) 0. 2.Вероятность того, что непрерывная случайная величина Х примет значение, принадлежащее интервалу (a, b), равна определенному интегралу от плотности распределения, взятому в пределах от a до b. b P(a X b) f ( x)dx . (3) a Доказательство: Согласно свойству функции распределения Ðà Õ b F (b) F (a) . Так как F(x)- это первообразная для f(x), то по формуле Ньютона-Лейбница приращение b первообразной на отрезке [a; b] есть определенный интеграл f ( x)dx . a Геометрически эта вероятность равна площади фигуры, ограниченной сверху кривой распределения и опирающейся на отрезок [a; b]. f(x) P ( a X b) 0 a b x 3. Функция распределения случайной величины Х может быть выражена через плотность вероятности по формуле: x F ( x) f ( x)dx. (4) 4. Несобственный интеграл от плотности распределения в пределах от - до равен единице. f ( x)dx 1. (5) Геометрическая интерпретация свойств плотности распределения: кривая распределения лежит не ниже оси абцисс, и полная площадь фигуры, ограниченной кривой распределения и осью абцисс, равна 1. Решение задач. Решение задач. 1. Случайная величина подчинена закону распределения с плотностью: a sin x, при 0 x f ( x) при x 0 или x 0, Требуется найти коэффициент а, определить вероятность того, что случайная величина попадет в интервал от 0 до . 4 Решение: Для нахождения коэффициента а воспользуемся свойством f ( x)dx 1 . 0 1 f ( x ) dx 0 dx a sin xdx 0 dx a sin xdx a cos x 2a 1; a . 0 0 2 0 4 14 1 2 2 . P(0 X ) f ( x)dx sin xdx cos x | 4 2 2 4 0 0 0 4 2 .Задана непрерывная случайная величина х своей функцией распределения f(x). A cos 2 x , при x 4 4 f ( x) 0, при x 4 Требуется определить коэффициент А, найти функцию распределения, определить вероятность того, что случайная величина х попадет в интервал ; 2 . 6 Решение: Найдем коэффициент А. / 4 / 4 A sin 2 x / 4 f ( x ) dx 0 dx A cos 2 xdx 0 dx A 1. 2 / 4 / 4 /4 Найдем функцию распределения: x x 1) На участке x : F ( x) f ( x)dx 0dx 0. 4 2) На участке x : F ( x) 4 4 3) На участке x : 4 F ( x) / 4 0dx / 4 /4 / 4 0dx cos 2 x, при 4 x 4 ; Итого: f ( x) 0, при x 4 x cos 2 xdx / 4 cos 2 xdx x sin 2 x x sin 2 x 1 . 2 / 4 2 2 0dx / 4 sin 2 x / 4 1. 2 / 4 при x 0, 4 sin 2 x 1 F ( x) , при x ; 2 4 4 при x 1, 4 Найдем вероятность попадания случайной величины в интервал ; 2 . 6 2 / 4 2 sin 2 x / 4 1 3 P x 2 f ( x)dx cos 2 xdx 0dx 0,067; 2 /6 2 4 6 /6 /6 / 4 Ту же самую вероятность можно искать и другим способом: sin( / 3) 1 1 3 P x 2 F (2) F ( / 6) 1 0,067. 2 2 4 6 Числовые характеристики непрерывных случайных величин. Понятия математического ожидания и дисперсии, которые мы применяли для дискретных случайных величин, сохраняются и для непрерывных случайных величин. И все свойства М(Х) и D(X), которые мы рассмотрели для случая дискретных случайных величин, распространяются и на непрерывные случайные величины. Определение. Математическим ожиданием непрерывной случайной величины Х,называется определенный интеграл M (X ) xf ( x)dx (6) При этом, конечно, предполагается, что несобственный интеграл сходится. Определение. Дисперсией непрерывной случайной величины называется математическое ожидание квадрата ее отклонения. D( X ) [ x M ( X )] 2 f ( x)dx (7) По аналогии с дисперсией дискретной случайной величины, для практического вычисления дисперсии используется формула: D( X ) x 2 f ( x)dx [ M ( X )] 2 (8). Определение. Средним квадратичным отклонением называется квадратный корень из дисперсии. ( X ) D( X ) (9) Пример: найти математическое ожидание и среднее квадратическое отклонение случайной величины Х, которая задана плотностью вероятности cos 2 x , ïðè x 4 4 f ( x) . 0, ïðè x 4 Решение: u x; dv cos 2 xdx; M ( X ) xf ( x)dx 0dx x cos 2 xdx 0dx x cos 2 xdx sin 2 x / 4 /4 / 4 du dx; v 2 ; / 4 /4 /4 / 4 x sin 2 x / 4 sin 2 x cos 2 x / 4 dx 0. 2 / 4 / 4 2 4 / 4 Определение. Модой М0 дискретной случайной величины называется ее наиболее вероятное значение. Для непрерывной случайной величины мода – такое значение случайной величины, при которой плотность распределения имеет максимум. f ( M 0 ) max . Если многоугольник f(x) распределения для дискретной случайной величины или кривая распределения для непрерывной случайной величины имеет два или несколько максимумов, то такое распределение называется или 0 x двухмодальным M0(X) M0(X) многомодальным. Если распределение имеет минимум, но не имеет максимума, то оно называется антимодальным. Определение. Медианой Me случайной величины Х называется такое ее значение, относительно которого равновероятно получение большего или меньшего значения случайной величины. P( X M e ) P( X M e ) =1/2. (10) Геометрически медиана – абсцисса точки, в которой площадь, ограниченная кривой распределения делится пополам. Отметим, что если распределение одномодальное, то мода и медиана совпадают с математическим ожиданием. Пример: Найти моду, медиану и математическое ожидание случайной величины Х с плотностью вероятности f ( x) 3x 2 при х 0;1. Решение: Очевидно, что f(x) принимает максимальное значение при х=M0(X)=1. f(x) 3 Медиану Me=t будем искать из соображений t 1 f ( x)dx 2 . Т.е. 2 1 M0(X) 0 M (X) 0,5 Me(X) 1 x t 0 t t 1 1 2 3 f ( x ) dx 0 dx 3 x dx x | t 3 . Откуда Me=t= 3 0,79 . 0 2 2 0 M (X ) 0 1 xf ( x)dx = 0dx x(3x )dx 0 dx 2 0 1 3 41 x | 0,75. 4 0 Основные законы распределения непрерывных случайных величин. Равномерное распределение. Определение. Непрерывная случайная величина имеет равномерное распределение на отрезке [a, b], если на этом отрезке плотность распределения случайной величины постоянна, а вне его равна нулю. 0, x a f ( x) C , a x b . 0, x b (11) Постоянная величина С может быть определена из условия равенства единице площади, ограниченной кривой распределения. f(x) C 1 ba 0 Получаем C 1 . ba a b x (12) Найдем функцию распределения F(x) на отрезке [a,b]. x F ( x) x 1 x dx ba ba a f ( x)dx при x a 0, x a F ( x) , при a x b . b a при x b 1, x a xa . ba (13) F(x) 1 0 a b x К случайным величинам, имеющим равномерное распределение относятся: время ожидания пассажирского транспорта, который курсирует с определенным интервалом; ошибка округления числа до целого (она равномерно распределена на отрезке [-0,5; 0,5]) Для того, чтобы случайная величина подчинялась закону равномерного распределения необходимо, чтобы ее значения лежали внутри некоторого определенного интервала, и внутри этого интервала значения этой случайной величины были бы равновероятны. Определим математическое ожидание, дисперсию и среднее квадратичное отклонение случайной величины, подчиненной равномерному закону распределения. ab M (X ) (14) 2 (b a) 2 D( X ) (15) 12 ( Õ ) D( Õ ) ba 2 3 (16) Доказательство: x x2 b a b M ( X ) xf ( x)dx dx . ba 2(b a) a 2 a a b b x2 x 3 b b 3 a 3 b 2 ab a 2 M ( X ) x f ( x)dx dx . ba 3(b a) a 3(b a) 3 a a b 2 b 2 D( X ) M ( X 2 ) M 2 ( X ) b 2 ab a 2 a 2 2ab b 2 b 2 2ab a 2 (b a) 2 . 3 4 12 12 x Dx ba 2 3 . Вероятность попадания случайной величины в заданный интервал: dx . (17) ba ba P( X ) Показательное распределение. Определение. Показательным (экспоненциальным) называется распределение вероятностей непрерывной случайной величины Х, которое описывается плотностью при x 0 0, f ( x ) x e , при x 0 где - положительное число. Найдем закон распределения. F ( x) x 0 x 0 f ( x)dx 0dx e x dx 1 e x . при x 0 0, F ( x) x при x 0 1 e Графики функции распределения и плотности распределения: f(x) F(x) 1 0 x Найдем математическое показательному распределению. ожидание 0 случайной x величины, подчиненной u x; e x dx dv; xex e x x x m x xf ( x)dx xe dx dx e du dx ; v ; 0 0 0 e 0 e x dx x 0 1 . Результат получен с использованием того факта, что По правилу x 1 xex lim x 0 0. lim x e x e x 0 Лопиталя Для нахождения дисперсии найдем величину М(Х2). M (X 2 ) 0 2 2 x x f ( x)dx x e dx Дважды интегрируя по частям, аналогично рассмотренному случаю, получим: 2 M (X 2 ) 2 ; Тогда D( X ) M ( X 2 ) M ( X ) 2 Итого: M ( X ) 1 . 2 1 1 1 ; D( X ) 2 ; x . Видно, что в случае показательного распределения математическое ожидание и среднее квадратическое отклонение равны. Также легко определить и вероятность попадания случайной подчиненной показательному закону распределения, в заданный интервал. величины, P(a x b) F (b) F (a) e a e b . Показательное распределение широко используется в теории надежности. Допустим, некоторое устройство начинает работать в момент времени t0=0, а через какое– то время t происходит отказ устройства. Обозначим Т непрерывную случайную величину – длительность безотказной работы устройства. Таким образом, функция распределения F(t) = P(T<t) определяет вероятность отказа за время длительностью t. Вероятность противоположного события (безотказная работа в течение времени t) равна R(t) = P(T>t) = 1 – F(t). Определение. Функцией надежности R(t) называют функцию, определяющую вероятность безотказной работы устройства в течение времени t. Часто на практике длительность безотказной работы подчиняется показательному закону распределению. Вообще говоря, если рассматривать новое устройство, то вероятность отказа в начале его функционирования будет больше, затем количество отказов снизится и будет некоторое время иметь практически одно и то же значение. Затем (когда устройство выработает свой ресурс) количество отказов будет возрастать. Другими словами, можно сказать, что функционирование устройства на протяжении всего существования (в смысле количества отказов) можно описать комбинацией двух показательных законов (в начале и конце функционирования) и равномерного закона распределения. Функция надежности для какого- либо устройства при показательном законе распределения равна: R(t ) 1 F (t ) e t . Данное соотношение называют показательным законом надежности. Важным свойством, позволяющим значительно упростить решение задач теории надежности, является то, что вероятность безотказной работы устройства на интервале времени t не зависит от времени предшествующей работы до начала рассматриваемого интервала, а зависит только от длительности времени t. Таким образом, безотказная работа устройства зависит только от интенсивности отказов и не зависит от безотказной работы устройства в прошлом. Так как подобным свойством обладает только показательный закон распределения, то этот факт позволяет определить, является ли закон распределения случайной величины показательным или нет. Нормальный закон распределения. Определение. Нормальным называется распределение вероятностей непрерывной случайной величины, которое описывается плотностью вероятности f ( x) 1 x 2 e ( x mx ) 2 2 2x ; Нормальный закон распределения также называется законом Гаусса. Нормальный закон распределения занимает центральное место в теории вероятностей. Это обусловлено тем, что этот закон проявляется во всех случаях, когда случайная величина является результатом действия большого числа различных факторов. К нормальному закону приближаются все остальные законы распределения. Можно легко показать, что параметры m x и x , входящие в плотность распределения являются соответственно математическим ожиданием и средним квадратическим отклонением случайной величины Х. Найдем функцию распределения F(x). F ( x) 1 x e ( x mx ) 2 2 2x x 2 dx График плотности нормального распределения называется нормальной кривой или кривой Гаусса. Нормальная кривая обладает следующими свойствами: 1) Функция определена на всей числовой оси. 2) При всех х функция распределения принимает только положительные значения. 3) Ось ОХ является горизонтальной асимптотой графика плотности вероятности, т.к. при неограниченном возрастании по абсолютной величине аргумента х, значение функции стремится к нулю. 4) Найдем экстремум функции. xm y ( xm)2 0; x m; 2 Т.к. при y’ > 0 при x < m и y’ < 0 при x > m , то в точке х = т функция имеет 1 максимум, равный . 2 3 e 22 5) Функция является симметричной относительно прямой х = а, т.к. разность (х – а) входит в функцию плотности распределения в квадрате. 6) Для нахождения точек перегиба графика найдем вторую производную функции плотности. ( xm)2 ( x m) 2 1 2 3 2 При x = m + и x = m - вторая производная равна нулю, а при переходе через эти точки меняет знак, т.е. в этих точках функция имеет перегиб. 1 В этих точках значение функции равно . e 2 y 1 e 22 Построим график функции плотности распределения. 0. 4 0. 3 0. 2 0. 1 -6 -4 -2 2 4 6 Построены графики при т =0 и трех возможных значениях среднего квадратичного отклонения = 1, = 2 и = 7. Как видно, при увеличении значения среднего квадратичного отклонения график становится более пологим, а максимальное значение уменьшается.. Если а > 0, то график сместится в положительном направлении, если а < 0 – в отрицательном. При а = 0 и = 1 кривая называется нормированной. Уравнение нормированной кривой: ( x) 1 2 e x2 2 . Правило 3-х (трех “сигм”). Пусть имеется нормально распределённая случайная величина с математическим ожиданием, равным а и дисперсией 2. Определим вероятность попадания в интервал (а – 3; а + 3), то есть вероятность того, что принимает значения, отличающиеся от математического ожидания не более, чем на три среднеквадратических отклонения. P(а – 3< < а + 3)=Ф(3) – Ф(–3)=2Ф(3)=0,99947 По таблице находим Ф(3)=0,49865, откуда следует, что 2Ф(3) практически равняется единице. Таким образом, можно сделать важный вывод: нормальная случайная величина принимает значения, отклоняющиеся от ее математического ожидания не более чем на 3. (Выбор числа 3 здесь условен и никак не обосновывается: можно было выбрать 2,8, 2,9 или 3,2 и получить тот же вероятностный результат. Учитывая, что Ф(2)=0,477, можно было бы говорить и о правиле 2–х “сигм”.) Т.е. вероятность того, что случайная величина отклонится от своего математического ожидание на величину, большую чем утроенное среднее квадратичное отклонение, практически равна нулю. Это правило называется правилом трех сигм. Не практике считается, что если для какой – либо случайной величины выполняется правило трех сигм, то эта случайная величина имеет нормальное распределение. Пример. Поезд состоит из 100 вагонов. Масса каждого вагона – случайная величина, распределенная по нормальному закону с математическим ожидание а = 65 т и средним квадратичным отклонением = 0,9 т. Локомотив может везти состав массой не более 6600 т, в противном случае необходимо прицеплять второй локомотив. Найти вероятность того, что второй локомотив не потребуется. Второй локомотив не потребуется, если отклонение массы состава от ожидаемого (10065 = 6500) не превосходит 6600 – 6500 = 100 т. Т.к. масса каждого вагона имеет нормальное распределение, то и масса всего состава тоже будет распределена нормально. Получаем: 100 P( X M ( X ) 100 2 2 1,111 2 0,3665 0,733 100 Пример. Нормально распределенная случайная величина Х задана своими параметрами – а =2 – математическое ожидание и = 1 – среднее квадратическое отклонение. Требуется написать плотность вероятности и построить ее график, найти вероятность того, Х примет значение из интервала (1; 3), найти вероятность того, что Х отклонится (по модулю) от математического ожидания не более чем на 2. Плотность распределения имеет вид: f ( x) Построим график: 1 2 e ( x 2)2 2 ; 0. 4 0. 3 0. 2 0. 1 1 2 3 4 Найдем вероятность попадания случайной величины в интервал (1; 3). P(1 X 3) 1 e t 2 dt 1 32 1 2 1 (0,7071) (0,7071) 0,6778. 2 2 2 2 Найдем вероятность отклонение случайной величины от математического ожидания на величину, не большую чем 2. 2 P( X 2 2) ( 2 ) 0,95. 2 2 Тот же результат может быть получен с использованием нормированной функции Лапласа. P( X 2 2) 2 2 2 2 0,4772 0,95. Замечание: Мне бы очень хотелось здесь полностью привести материалы статьи газеты «Пятое измерение» номер 18 за 2003 год Расследование КРИВАЯ ГАУССА Физики, биологи, математики, химики знают: если мы измеряем любую природную величину, то результаты измерений образуют график, который называется "кривая нормального распределения", или "кривая Гаусса". К примеру, глядя из окна, мы начнем измерять рост всех прохожих. Для точности опыта возьмем взрослых мужчин. Мы увидим, что результаты наших измерений сгруппируются вокруг отметки 1 метр 78 сантиметров - "средний рост". Тех, у кого рост 1 метр 68 см, будет меньше, чем со "средним “ростом. Тех же, чей рост 1 метр 48 см, будет еще меньше. Ту же закономерность мы увидим и в случае, когда рост больше, чем "средний". Тех, у кого 1 м 98 см - будет меньше, чем "среднеростых", а тех, у кого 2 м 18 см - еще меньше. И чем больше прохожих пройдет перед нашим окном, тем точнее выявится эта закономерность. Результаты наших измерений изобразим на графике. Картинка, которая у нас получилась называется "кривая Гаусса". Если мы измерим вес прохожих, то получим ту же самую картинку. Измерим размер обуви, остроту зрения, кровеносное давление, физическую силу, знание стихов Пушкина, продолжительность сна - та же сама картинка. Если мы измерим скорости молекул воздуха в нашей комнате - получим ту же самую картинку. Кривую Гаусса. Кривую нормального распределения. Это - фундаментальный физический закон. Он означает, что есть линия нормы ("средний рост"). Тех, чьи показатели близки к "норме" - их больше. На графике это выражено так: у графика есть вершина и через нее обязательно проходит линия "нормы". Все же отклонения от "нормы" - плавно расползаются в обе стороны. Чем больше отклонение от "среднего", тем меньше объектов, обладающих этим отклонением. "Карликов" и "великанов" - меньше, чем людей среднего роста. Вдобавок, чем меньше "карлик" (или чем больше "великан"), тем реже он встречается в природе. Это основополагающий закон вероятности в природе. Что более вероятно - встречается чаще, что менее вероятно - встречается реже. Высокая вероятность плавно переходит в низкую вероятность. Что и показывает плавность линий "кривой Гаусса". СТРАННЫЙ РАЗБРОС В 1955 г. при измерениях скоростей биохимических реакций было обнаружено существование странного разброса результатов: получаемые величины группировались около двух-трех дискретных значений (графики имели 2-3 вершины), а промежуточные значения были очень редки. Первоначально это явление было объяснено особенностями изучаемых белков - миозина и актомиозина. Однако, после нескольких лет исследований аналогичные картины были получены и при изучении других белков. Затем, в качестве контроля, были проведены опыты с чисто химическими реакциями низкомолекулярных веществ. И здесь - тоже получили графики с несколькими вершинами вместо одной плавной линии. Фундаментальный закон вероятности - нарушался. Картина распределения результатов измерений - не вписывалась в существующие представления о фундаментальном, глубинном, устройстве нашего мира.Может быть, причина этого нарушения в неточности измерений? Это первое, что приходило исследователям в голову. Измерения были проверены и перепроверены - но нет, было достоверно установлено, что эти "неестественные" распределения не являются эффектом неточности измерений или каких-либо иных искусственных причин.Наблюдалось удивительное сходство тонкой структуры графиков (гистограмм) в разных опытах и явно закономерное изменение их формы. Возникло предположение, что во всех этих опытах проявляются особые свойства общего для всех реакций растворителя - воды.Однако аналогичные распределения скоростей были получены и при исследовании реакции в неводных растворителях. Тогда - уже в 1979 году - в качестве "последнего контроля" были изучены детальные распределения результатов измерений радиоактивности. Эффект был поразителен. Тонкая структура распределения результатов измерений радиоактивности - форма соответствующих гистограмм - оказалась чрезвычайно сходной. 25 лет исследований позволили сделать вывод, что наличие нарушений в вероятностях распределения измеряемых величин имеет ВСЕОБЩИЙ характер! И не объясняется тривиальными причинами неточности исследований. Исследования, начатые на растворах белков, стимулировали изучение колебательных процессов в биохимических, химических и физико-химических системах. Однако наличием колебательных режимов нельзя было объяснить нарушения вероятностного закона. К 1983 г. исследователи окончательно убедились в том, что необъяснимое "поведение" вероятности - они назвали его "макроскопическое квантование" - характерно для процессов принципиально разной природы. Оно отчетливо проявлялось и в сложных биохимических реакциях, и в простых химических реакциях. Нарушения вероятности были обнаружены и во всех физических процессах - при движении частиц в электрическом поле, при "выбивании" из воды протонов методом спин-эхо, при колебаниях концентрации реагентов в реакции Белоусова-Жаботинского, при радиоактивном распаде различных изотопов. Одновременные измерения "поведения" вероятности продолжали и продолжали проводиться в совершенно разных процессах. В том числе - в лабораториях, удаленных друг от друга на сотни и тысячи километров. Вывод о неслучайности нарушений фундаментального принципа вероятности с предельной ясностью следовал из детального совпадения форм гистограмм, получаемых независимо в разных сериях измерений. Из опытов получалось, что естественное и фундаментальное свойство мира, отражаемое привычной "кривой нормального распределения" вероятностей, - это всегда (!) результат искусственного огрубления получаемых результатов. А это означает, что того "естественного" фундаментального закона вероятности, на котором строится вся наука и все современные представления о природных процессах - не существует в нашем мире. Но это - невозможно! Это противоречит всем человеческим научным представлениям и элементарному здравому смыслу. Если подбросить монету 10 раз, то несколько раз выпадет "орел", а несколько раз - "решка". Чем больше мы будем подбрасывать монету, тем точнее проявится закономерность, что число выпавших "орлов" равно числу выпавших "решек". Если вместо того, чтобы подбрасывать одну и ту же монету 10 раз, мы подбросим одновременно 10 монет, то обнаружим, ту же самую закономерность.Подбросив 10 монет, мы можем получить результат 80% на 20%. Или 70 на 30. Или 50 на 50. Как повезет. Но если мы подбросим одновременно 10.000 монет, то мы получим всегда 50 на 50. Ну, может быть, 49,9% на 50,1%. Если же мы подбросим 1.000.000 монет, то распределение "орлов" и "решек" будет отличаться от "50 на 50" еще меньше. Неумолимо работает фундаментальный закон вероятности. Полученные результаты исследования гистограмм совершенно различных процессов говорили странное - "если мы подбросим 1.000.000 монет, то получим результат 35% на 65%". Еще более странное - и это тоже говорили гистограммы - заключается в том, что если мы подбросим свой 1.000.000 монет еще раз через 5 секунд, то получим распределение вероятности 36% на 64%! Подбросив их еще раз через 5 секунд, мы получим 37% на 63%! А подбросив эти же монеты через час, мы получим 48% на 52%! Но самое странное - и это опять же отражают гистограммы! - это то, что если ровно через сутки ровно через 24 часа! - мы повторяем наши опыты, то опять получаем то же самое распределение 36% на 64%! Через 5 секунд - 37% на 63%! А через час - 48% на 52%! ...А это уже - "не вписывается ни в какие ворота". Вместо монет были использованы радиоактивные изотопы. Опыты проводились на изотопах семейства 226Ra, которые в результате альфа-активности находятся в равновесии с продуктами своего распада: 222Rn, 218Ро, 214Ро, 210Ро, и на других различных радиоактивных материалах. В каждом куске обогащенного урана весом в 1 кг каждую секунду распадается ОДИНОАКОВОЕ количество атомов - 1.000.000. Ну, может быть, немного больше или меньше. Это - вероятностный процесс. "Вероятностный" в том смысле, что неизвестно какой именно атом распадется, но что в следующую секунду распадется 1.000.000 атомов - это известно абсолютно точно. Здесь работает тот же самый вероятностный закон, который "заставляет" монету падать "решкой" в 50% случаев из 1.000.000 подбрасываний. Железно! Ну, может быть, на 0,0001% она выпадет больше или меньше. Отклонение от "средней линии" - "50 на 50" - невероятное событие! Всегда должно быть "50 на 50"! Однако - и это невероятно! - количество распадающихся атомов, как и количество выпадающих "решкой" монет, - зависит от времени суток! Мало того! Каждый день ровно в 8.00 выпадает одно и то же количество и монет, и атомов! А ровно в полночь - другое, нежели в 8.00 но такое же, как и в прошлую полночь! Это невероятно! Вот что об этом говорится в журнале “УСПЕХИ ФИЗИЧЕСКИХ НАУК”, том 168, N 10 (Октябрь 1998 г.): Не претендуя на выяснение природы этих свойств, можно констатировать: при любых последовательных во времени измерениях процессов любой природы получают последовательность дискретных величин. Некоторые из этих величин встречаются существенно чаще других - наблюдаются "разрешенные" и "запрещенные" состояния макроскопических объектов. На соответствующих гистограммах видны экстремумы - "пики" и "впадины". Форма спектра разрешенных и запрещенных состояний - относительные величины расстояний между уровнями и степень их заселенности - сходна в каждый данный момент для процессов разной природы и изменяется с высокой вероятностью одновременно в разных процессах, в том числе при больших расстояниях между лабораториями. Существует "время жизни" данной формы гистограмм: в ряду последовательных гистограмм с наибольшей вероятностью данная гистограмма сходна с ближайшими соседними гистограммами. Формы гистограмм с высокой вероятностью повторяются с периодом в 24 часа, около 27 суток, около 365 суток. Все это (закономерное изменение формы последовательных во времени гистограмм, их сходство при одновременных независимых измерениях процессов разной природы, в том числе в разных географических пунктах) свидетельствует о существовании весьма общей космофизической (космогонической) причины обсуждаемого феномена. НЕИЗВЕСТНЫЙ КОСМОФИЗИЧЕСКИЙ ФАКТОР Чтобы исключить субъективные эффекты при оценке гистограмм, исследователями проводились сопоставления десятков и сотен тысяч сочетаний этих гистограмм. Появление гистограмм одинаковой формы через каждые 24 часа, 27 суток и 365 суток при исследовании хода самых различных природных процессов - неумолимо свидетельствует о наличии неизвестного науке глобального космофизического фактора. Так, обнаруженный 24-часовой период, безусловно, связан с вращением Земли вокруг своей оси. Период 27 суток - в точности совпадает с синодическим периодом Солнца относительно Земли. 365 суток - это период вращения Земли по околосолнечной орбите. Однако, неоднократные попытки определения характера обнаруженного космофизического фактора - причин, определяющих как форму гистограмм, так и периодичность смены этих форм оказались неудачными. Ясно лишь одно - обнаружен феномен важнейшего фундаментального характера. Приблизиться к теоретическому объяснению этого феномена, несмотря на более чем 40-летний период его интенсивного исследования ведущими институтами мира - не удалось. Клейн 2003