Глава 11. Теория вероятностей

advertisement

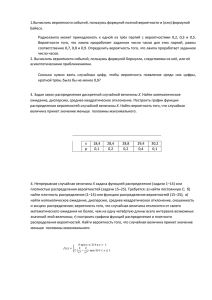

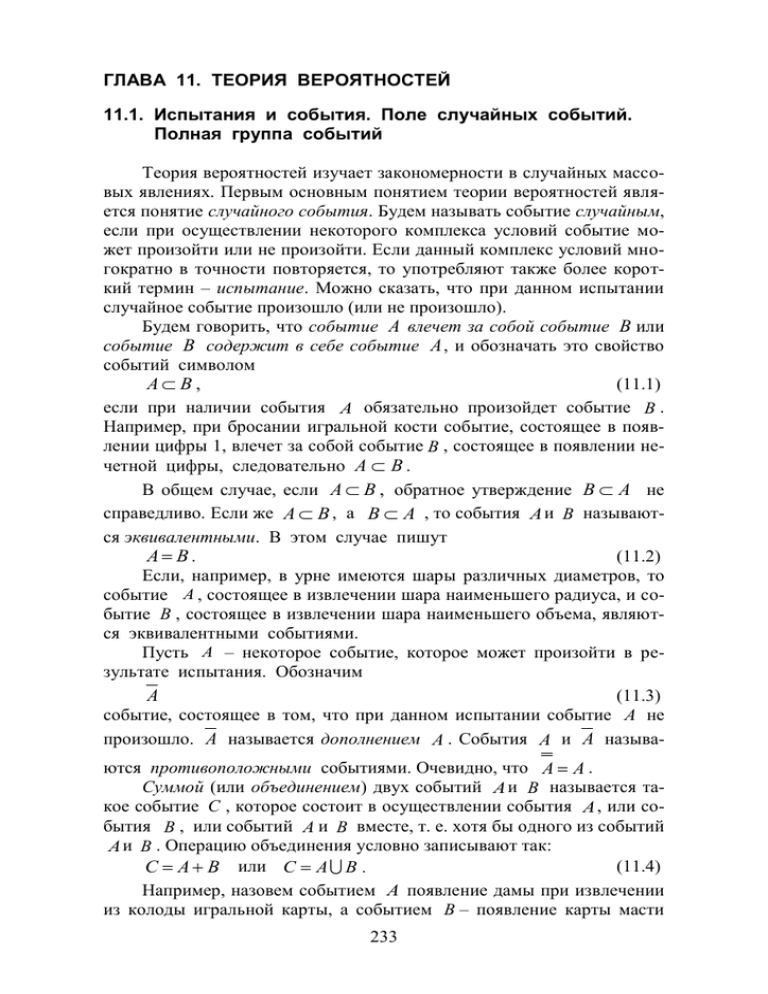

ГЛАВА 11. ТЕОРИЯ ВЕРОЯТНОСТЕЙ 11.1. Испытания и события. Поле случайных событий. Полная группа событий Теория вероятностей изучает закономерности в случайных массовых явлениях. Первым основным понятием теории вероятностей является понятие случайного события. Будем называть событие случайным, если при осуществлении некоторого комплекса условий событие может произойти или не произойти. Если данный комплекс условий многократно в точности повторяется, то употребляют также более короткий термин – испытание. Можно сказать, что при данном испытании случайное событие произошло (или не произошло). Будем говорить, что событие A влечет за собой событие B или событие B содержит в себе событие A , и обозначать это свойство событий символом (11.1) A B, если при наличии события A обязательно произойдет событие B . Например, при бросании игральной кости событие, состоящее в появлении цифры 1, влечет за собой событие B , состоящее в появлении нечетной цифры, следовательно A B . В общем случае, если A B , обратное утверждение B A не справедливо. Если же A B , а B A , то события A и B называются эквивалентными. В этом случае пишут (11.2) A B. Если, например, в урне имеются шары различных диаметров, то событие A , состоящее в извлечении шара наименьшего радиуса, и событие B , состоящее в извлечении шара наименьшего объема, являются эквивалентными событиями. Пусть A – некоторое событие, которое может произойти в результате испытания. Обозначим (11.3) A событие, состоящее в том, что при данном испытании событие A не произошло. A называется дополнением A . События A и A называются противоположными событиями. Очевидно, что A A . Суммой (или объединением) двух событий A и B называется такое событие C , которое состоит в осуществлении события A , или события B , или событий A и B вместе, т. е. хотя бы одного из событий A и B . Операцию объединения условно записывают так: (11.4) C A B или C A B . Например, назовем событием A появление дамы при извлечении из колоды игральной карты, а событием B – появление карты масти 233 пики. Событие C A B происходит, если извлеченная игральная карта оказалась одной из дам либо любой картой масти пики, в том числе и пиковой дамой. Аналогично, событие (11.5) A BC состоит в том, что произошло хотя бы одно из событий A , B и C . Например, если A есть появление 1, B – появление 3, C –появление 5 при бросании игральной кости, то A B C есть событие, состоящее в появлении нечетной цифры. Для суммы событий справедлив сочетательный закон (11.6) A B C A B C A B C . Произведением (или пересечением) двух событий A и B называется событие C , которое состоит в осуществлении и события A , и события B. Операция пересечения событий условно записывается в виде (11.7) C AB или C A B . В приведенном выше примере с игральными картами событие AB происходит, если извлечена из колоды пиковая дама. Для произведения событий выполняется сочетательный закон AB C A BC ABC (11.8) и распределительный закон относительно суммы событий (11.9) A BC AC BC . Легко убедиться также в справедливости равенств (11.10) A B AB , A B AB . Пусть испытание состоит в том, что из квадрата наудачу выбирается точка (рис. 78). Если A обозначает попадание точки в верхнюю половину квадрата, а B – попадание в левую половину, то события A, B , A B , AB, A B , A B , A B , AB обозначают попадание точки в области, указанные на рис. 78 с помощью операций (11.3), (11.4), (11.7), (11.10). A A+B B B A B A AB AB A B AB Рис. 78 Если в результате испытания рассматриваемое событие обязательно произойдет, то такое событие называют достоверным и обозначают буквой U . Если же известно, что в результате испытания событие заведомо не произойдет, то оно называется невозможным событием и обозначается буквой V . 234 Для противоположных событий A и A , достоверного события U и невозможного события V справедливы соотношения: A A U , AA V , U V , V U , A U U , A V A , AU A , AV V . (11.11) (11.12) О п р е д е л е н и е 1. Совокупность событий называется полем событий, если выполнение операций дополнения, объединения и пересечения над событиями поля приводит снова к событиям, принадлежащим полю. Например, поле событий, порожденное двумя случайными событиями A и B , состоит из A, B , A, B , A B , A B , A B , A B , AB , AB , AB , A B , AB A B , AB AB , U , V . (11.13) Любая из операций (11.3), (11.4), (11.7), (11.11), (11.12), выполненная над событиями (11.13), снова приводит к одному из событий (11.13). Два события A и B при осуществлении некоторого комплекса условий называются несовместимыми событиями, если в результате испытания появление одного из них исключает появление другого. В противном случае события A и B называются совместимыми. Если события A и B несовместимы, можно записать AB V . О п р е д е л е н и е 2. Будем говорить, что случайные события A1 , A2 , ..., An образуют полную группу событий, если они попарно несовместимы и если при каждом повторении испытания должно достоверно произойти хотя бы одно из них: A1 A2 ... An U . (11.14) 11.2. Вероятность события. Аксиомы теории вероятностей. Классическое и статистическое определения вероятности Для практических целей недостаточно знать только то, что исследуемое событие случайно. Чтобы количественно сравнивать между собой события по степени их возможного появления, нужно с каждым событием связать определенное число, которое тем больше, чем более возможно событие. Такое число называется вероятностью события. Таким образом, вторым основным понятием теории вероятностей является понятие вероятности события как численной меры степени объективной возможности этого события. Чтобы построить теорию вероятностей, непротиворечивую и свободную от ограничений, в основу ее следует положить систему аксиом, которые, так же как, например, аксиомы евклидовой геометрии, формулируются как результат жизненного опыта и практической деятель235 ности человека. Принятая в теории вероятностей система аксиом сформулирована в начале 30-х годов ХХ века академиком А.Н.Колмогоровым. А к с и о м а I. С каждым событием A данного поля событий связывается число P A , называемое его вероятностью и удовлетворяющее условию (11.15) 0 P A 1. А к с и о м а II. Вероятность достоверного события равна 1: (11.16) PU 1 . А к с и о м а III. Если событие A подразделяется на попарно несовместимые события A1 , A2 , ... , Am того же поля, т. е. A A1 A2 ... Am , (11.17) то (11.18) P A P A1 P A2 ... P Am . Равенство (11.18) называется принципом сложения вероятностей. А к с и о м а IV. Если событие A может быть представлено как сумма бесконечной последовательности A1 , A2 , ... , Am , ... попарно несовместимых событий, то (11.19) P A P A1 P A2 ... P Am ... , причем ряд в правой части (11.19) предполагается сходящимся. Эта аксиома, называемая расширенной аксиомой сложения вероятностей, необходима, так как часто приходится рассматривать события, подразделяющиеся на бесконечное число частных случаев. Сформулированные аксиомы не определяют вероятности события относительно другого события данного поля при условии, что другое событие наступило. Поэтому, дополнительно к аксиомам, принимается в качестве определения следующий способ нахождения условной вероятности. О п р е д е л е н и е. Условная вероятность события B относительно события A , если вероятность последнего отлична от нуля, равна частному от деления вероятности их произведения на вероятность события A : P AB P B | A . (11.20) P A Очевидно из определения, что и P AB P A | B . (11.21) P B Из равенств (11.20) и (11.21) получаем (11.22) P AB P A PB | A PB P A | B . Выражение (11.22) называется принципом умножения вероятностей. 236 Аксиомы I – IV совместно с принципом умножения вероятностей составляют основу всей теории вероятностей. Все теоремы этой теории выводятся из них формально-логическим путем. Рассмотрим некоторые элементарные следствия из аксиом теории вероятностей. 1) Из очевидного равенства U V U и аксиомы III следует, что PU PV PU и, следовательно, вероятность невозможного события равна нулю, т. е. (11.23) PV 0 . 2) Так как A A U , то из аксиом II и III следует (11.24) P A P A 1, т. е. сумма вероятностей противоположных событий равна единице. 3) Если события A1 , A2 , ... , An образуют полную группу событий, то сумма их вероятностей равна единице: P A1 P A2 ... P An 1. (11.25) Равенство (11.25) есть следствие равенства (11.14) и аксиом II и III. Рассмотрим здесь более подробно тот случай, когда все вероятности в формуле (11.25) равны между собой: 1 P A1 P A2 ... P An , n другими словами, когда все события полной группы равновероятны или равновозможны. Пусть событие A представляет собой сумму k равновероятных событий (11.26) A A1 A2 ... Ak , входящих в состав полной группы событий. События A1 , A2 , ... , Ak будем называть благоприятными для события A , так как появление одного из них делает достоверным событие A . События Ak 1 , Ak 2 , ... , An неблагоприятны для события A , так как появление одного из них делает невозможным появление события A . Легко видеть, что тогда в силу формулы (11.18) аксиомы III справедливо равенство: k P A . (11.27) n Формула (11.27), называемая классическим определением вероятности, читается так: вероятность события A равна отношению числа событий k , благоприятных для A , к общему числу n равновозможных событий, образующих полную группу. Формула (11.27) позволяет решать задачи на нахождение вероятностей, если для данного испытания можно указать полную группу конечного числа несовместимых равновероятных событий. Она сводит 237 понятие вероятности события к более элементарному понятию равновозможных (равновероятных) событий, которое уже не подлежит определению и предполагается интуитивно ясным. Однако, французский математик XIX века Бертран на ряде примеров показал, что понятие равновероятности не самоочевидно и зависит от условий испытаний и рассуждения, что приводит к различным методам решения задач и к различным ответам к ним. Кроме того, при рассмотрении экономических задач и задач естественно-научного характера часто встречаются события, которые не распадаются на конечное или бесконечное число единственно возможных, равновозможных и несовместимых случаев. В настоящее время при определении понятия вероятности события обычно исходят из эмпирического понятия относительной частоты. Относительной частотой события A в данной серии n испытаний называется отношение числа опытов k , в которых появилось событие A , к общему числу испытаний n . Если обозначать относительную частоту события A через P* A , то P* A k (11.28) . n На основании длительных наблюдений над результатами большого числа различного рода испытаний подмечено, что относительная частота появлений рассматриваемого события в различных сериях испытаний обнаруживает устойчивость, т. е. относительные частоты в различных сериях испытаний мало отличаются друг от друга. Объективно существующая величина, около которой группируются относительные частоты события, называется статистической вероятностью события. Если производится достаточно большое число испытаний, то относительную частоту P* A события A можно при- ближенно принять за значение вероятности P A (11.29) P* A P A. Таким образом, исчерпывающей математической формулировки понятия вероятности не существует. Поэтому для вычисления вероятностей сложных событий применяются, как правило, не прямые методы, а косвенные, позволяющие по известным вероятностям элементарных событий (вычисление этих вероятностей является предметом специальных наук) определять вероятности других, более сложных, событий, с ними связанных. Вся теория вероятностей, в основном, и представляет собой систему таких косвенных методов, применяя которые мы всегда в той или иной мере или форме пользуемся двумя основными принципами: принципом сложения вероятностей и принципом умножения вероятностей. 238 11.3. Основные формулы комбинаторики Комбинаторикой называется раздел математики, изучающий число различных комбинаций определенного типа, которые можно составить из элементов заданного конечного множества. В теории вероятностей принято говорить не о комбинациях элементов из заданного множества, а о выборках из заданной совокупности объектов, для составления которых используют два общих правила – правило суммы и правило произведения. П р а в и л о с у м м ы. Если объект A можно выбрать k способами, а другой объект B можно выбрать m способами (не такими, как A ), то объект A B («либо A , либо B ») можно выбрать k m способами. П р а в и л о п р о и з в е д е н и я. Если объект A можно выбрать k способами, а после каждого такого выбора другой объект B можно выбрать (независимо от выбора объекта A ) m способами, то пары объектов AB («и A , и B ») можно выбрать числом способов, равным n k m. (11.30) При вычислениях вероятностей событий используют формулы числа выборок трех типов, называемых размещениями, перестановками, сочетаниями. О п р е д е л е н и е 1. Размещениями из n различных элементов по k элементов k n называются выборки, которые отличаются одна от другой либо составом элементов, либо порядком их расположения. Например, из трех элементов a, b, c можно составить по два элемента следующие размещения: ab , ba , ca , ac , bc , cb. Этих размещений 6, и они одна от другой отличаются либо элементами, либо порядком их расположения. Число различных размещений из n элементов по k элементов обозначают Ak . Определим это n число. Пусть имеем n элементов. Первый элемент можно выбрать n способами. Второй приходится выбирать из оставшихся n 1 элементов, поэтому второй элемент можно выбрать n 1 способами. Тогда по формуле (11.30) пары двух элементов можно образовать n (n–1) способами. Третий элемент придется отбирать из числа оставшихся n 2 элементов. Это можно сделать n 2 способами. Тогда опять по формуле (11.30) теперь уже тройки элементов можно образовать n (n–1) (n–2) способами. Аналогично четверки элементов можно обра239 зовать n n 1n 2n 3 способами, а размещения по k элементов n n 1n 2... n k 1 способами. Таким образом, Ank = n n 1n 2 n k 1 . (11.31) О п р е д е л е н и е 2. Перестановками из n различных элементов называются размещения из этих n элементов по n. Количество всех перестановок из n элементов обозначается символом Pn и находится по формуле (11.31) при k n Pn Ann n n 1n 2 3 2 1 n! (11.32) Перестановки из n элементов отличаются друг от друга только порядком расположения элементов, но не самими элементами. Принято считать, что (11.33) P0 0! 1 , так как пустое множество (выборка) является подмножеством любого множества и может быть упорядочено только одним способом. О п р е д е л е н и е 3. Сочетаниями из n различных элементов по k элементов k n называются выборки, которые отличаются хотя бы одним элементом. Число сочетаний из n элементов по k элементов обозначается символом C nk .Отметим разницу между размещениями и сочетаниями: в первых учитывается порядок элементов в выборке, поэтому размещения называются упорядоченными выборками; сочетания представляют собой неупорядоченные выборки. В упорядоченной выборке, содержащей k элементов, порядок следования элементов можно изменить Pk k ! способами. Значит, число сочетаний C nk меньше числа размещений Ank в k ! раз. Поэтому число сочетаний C nk вычисляется по формуле Cnk Ank n n 1n 2 n k 1 Pk 1 2 3 k 1 k (11.34) Pn n! Cnnk . Pk Pnk k ! n k ! (11.35) Умножая числитель и знаменатель полученной дроби на n k ! получаем запись формулы (11.34) в виде Cnk Формулы (11.31), (11.32), (11.35) могут быть применены для определения числа случайных событий при вычислении вероятности события по классическому определению. 240 П р и м е р 1. Набирая номер телефона, абонент забыл две последние цифры и, помня лишь, что эти цифры различны, набрал их наудачу. Какова вероятность того, что номер набран правильно? 2 Р е ш е н и е. Две последние различные цифры можно набрать А 10 способами, а благоприятствовать событию А (цифры набраны правильно) будет только один способ. По классическому определению вероятности события найдем 1 1 1 P A 2 10 9 90 A 10 П р и м е р 2. Найти вероятность того, что при случайном наборе четырех букв из слова «математика» будут получены буквы, из которых можно составить слово «тема». Р е ш е н и е. Общее число равновозможных событий равно числу сочетаний из 10 букв, составляющих слово «математика», по 4, а число благоприятных событий согласно формуле (11.30) равно 2123=12, так как буква «т» может быть выбрана двумя способами, буква «е» – одним, буква «м» – двумя и буква «а» – тремя способами. Искомая вероятность события А (составлено слово «тема») 12 12 4! 6! 2 P A 4 . 10! 35 C10 11.4. Теорема сложения вероятностей Принцип сложения вероятностей попарно несовместимых событий сформулирован в аксиоме III теории вероятностей. Пусть теперь А и В – произвольные события, которые могут быть как совместимыми, так и несовместимыми. Установим связь между вероятностью их совместного появления АВ, вероятностями событий А, В и вероятностью события А+В, состоящего в появлении хотя бы одного из событий А и В. Т е о р е м а с л о ж е н и я в е р о я т н о с т е й. Если А и В – произвольные события, то справедливо соотношение (11.36) P А В P A РВ Р АВ . Д о к а з а т е л ь с т в о. Представим сумму событий А+В в виде очевидного равенства A B A AB , где A AB A A B VB V , т. е. события А и A B несовместимы. Аналогично, можно записать B AB AB , где AB AB A A BB VB V , т.е. AB и A B также несовместимы. 241 Используя формулу (11.18) аксиомы III , получаем P A B P A P AB , PB P AB PAB . (11.37) (11.38) Вычитая (11.38) из (11.37) почленно, получим P А В P A РВ Р АВ . Теорема доказана. В частном случае, если события А и В несовместимы, т. е. АВ=V и Р(АВ)=0, равенство (11.36) принимает вид (11.39) P A B P A PB . Справедливо и обратное утверждение: если выполняется (11.39), то события А и В несовместимы. Для трех событий формула сложения вероятностей примет вид P A B C P A PB PC P AB P AC PBC P ABC . (11.40) 11.5. Правила умножения вероятностей. Вероятность появления хотя бы одного из событий, независимых в совокупности При совместном рассмотрении двух случайных событий A и B часто возникает вопрос о том, насколько связаны эти события друг с другом и в какой мере наступление одного из них влияет на вероятность наступления другого. Пусть при выполнении некоторого комплекса условий могут произойти случайные события A и B с вероятностями P A и P B . Допустим, стало известно, что в результате испытания событие B произошло. После получения этой информации о наступлении события B вероятность события A может стать другой, отличной от P A . Вероятность события A , при условии, что событие B произошло, будем называть условной вероятностью и обозначать символом P A | B . Если знание, что событие B произошло, не изменяет вероятности события A , т. е. (11.41) P A | B P A , то событие A называют независимым от события B . Пусть событие A не зависит от B , тогда из принципа умножения вероятностей (11.22) следует P AB P A P B P B | A P B , (11.42) P A P A т. е. независимость двух событий всегда взаимна. 242 О п р е д е л е н и е 1. События A и B называются независимыми, если P A | B P A или P B | A P B . В противном случае события A и B называются зависимыми. П р и м е р. Бросается наугад игральная кость. Событие A – выпадение четного числа очков – имеет вероятность P A 1/ 2 . Событие B – выпадение числа очков, большего, чем 3 – имеет ту же вероятность P B 1/ 2 . Очевидно, что было бы неверно утверждать, что одно из этих событий влечет за собой с неизбежностью другое или что, наоборот, появление одного из них исключает другое событие. Допустим, стало известно, что в результате испытания произошло событие B . Из трёх случаев, к которым сводится событие B (выпадение 4, 5 или 6 очков), событию A будут благоприятны два – выпадение 4 или 6 очков. Поэтому P A | B 2 / 3 . Так как P A | B P A , то делаем вывод, что события A и B зависимы. В частности, P B | A 2 / 3 и P AB P A P B | A P B P A | B 1/ 2 2 / 3 1/ 3 . Принцип умножения вероятностей (11.22) легко распространить на случай, когда число событий больше двух. Например, для трех событий (11.43) P ABC P AB P C | AB P A P B | A P C | AB . Для двух независимых событий, как это следует из равенств (11.41) и (11.42), правило умножения вероятностей принимает вид P AB P A P B . (11.44) Справедливо и обратное утверждение: если выполняется равенство (11.44), то события A и B независимы. В дальнейшем независимость A и B будет пониматься как выполнение равенства (11.44). На практике о независимости событий заключают по смыслу задачи. Обобщим понятие независимости событий на случай нескольких событий. О п р е д е л е н и е 2. События A1 , A2 , ... , An называются независимыми в совокупности, если для любой их комбинации A i , A i , ... , A i 2 k n выполнено соотношение 1 2 k P A i1 Ai2 Aik P Ai1 P Ai2 P Aik . (11.45) Соотношение (11.45) позволяет обобщить теорему сложения вероятностей на случай n независимых в совокупности событий. Действительно, в силу первой из формул (11.10), если A – событие, состоящее в появлении хотя бы одного из событий A1 , A2 , ... , An , независимых в совокупности, A A1 A2 ... An , (11.46) 243 то противоположное событие A (ни одно из событий не наступило) запишется как (11.47) A A1 A2 An . Используя формулу (11.24) и соотношение (11.45) для независимых в совокупности событий A1 , A2 , ... , An , получаем (11.48) P A 1 P A 1 P A 1 P A 2 P A n . Таким образом, вероятность появления хотя бы одного из событий, независимых в совокупности, равна разности между единицей и произведением вероятностей противоположных событий. Обозначим, для простоты записи, вероятности событий (11.49) P A1 p1 , P A2 p2 , . . . , P An pn . Вероятности противоположных событий обозначим P A1 q1 , P A 2 q2 , . . . , P A n qn . Формула (11.48) в новых обозначениях примет вид: (11.50) P A 1 q1 q2 ... qn . Если события A1 , A2 , ... , An имеют одинаковую вероятность, равную p , то противоположные события A1 , A2 , ..., An имеют одинаковую вероятность, равную q 1 p . Вероятность появления хотя бы одного из событий A1 , A2 , ... , An будет вычисляться по формуле P A 1 q n . (11.51) 11.6. Формула полной вероятности. Формула Байеса Принципы сложения и умножения вероятностей служат для расчета вероятностей случайных событий через вероятности более простых событий. Во многих задачах оказывается полезным еще одно следствие из этих принципов. Пусть случайное событие A может произойти с условной вероятностью P A| H i лишь при наступлении одного из n случайных событий H i , образующих полную группу: A AH1 AH 2 ... AH n . (11.52) События H i будем называть гипотезами относительно события A . Их вероятности P H i будем считать известными, так как полная группа событий считается заданной, если известны их вероятности. Тогда вероятность события A может быть вычислена по следующей формуле полной вероятности: P A P A| H1 P H1 P A| H 2 P H 2 ... P A| H n P H n . (11.53) 244 Формула (11.53) читается так: вероятность события A равна сумме произведений условных вероятностей этого события по каждой из гипотез на вероятности самих гипотез. Для вывода этой формулы заметим, что события AH1 , AH 2 , ... , AH n несовместимы между собой, но не составляют полную группу. Поэтому, применяя к событию A принцип сложения вероятностей (11.18), получим соотношение P A P A H1 P A H 2 ... P A H n . Заменив каждое слагаемое правой части произведением P AH i P A | H i P H i , записанным согласно принципу умножения вероятностей (11.22), получим формулу полной вероятности (11.53). Выделим важный частный случай. Противоположные гипотезы H и H всегда образуют полную группу. Поэтому всегда имеет место формула P A P A| H P H P A| H P H . (11.54) П р и м е р. Для приема зачета преподаватель приготовил 50 задач: 20 задач по дифференциальному исчислению и 30 задач по интегральному исчислению. Для сдачи зачета студент должен решить первую же взятую наугад задачу. Какова вероятность для студента сдать зачет, если он умеет решить 18 задач по дифференциальному исчислению и 12 задач по интегральному исчислению? Р е ш е н и е. Введем обозначения: гипотеза H1 – взята задача из дифференциального исчисления; H 2 – взята задача из интегрального исчисления; событие A – задача решена. Тогда 20 30 P H1 0 ,4 ; P H2 0 ,6 ; 50 50 18 12 P A| H1 0 ,9 ; P A| H 2 0 ,4 . 20 30 По формуле (11.53) находим вероятность сдачи зачета P A 0,9 0,4 0,4 0,6 0,6 . В тесной связи с формулой полной вероятности (11.53) находится так называемая формула Байеса условной вероятности гипотез. Она решает следующую задачу. Пусть произведено испытание, и в результате него наступило событие A . Требуется найти условные вероятности каждой из гипотез P H i | A в предположении, что событие A наступило. Понятно, что, вообще говоря, послеопытная (апостериорная) вероятность P H i | A 245 гипотезы будет отлична от доопытной (априорной) вероятности P H i . Должны возрасти вероятности тех гипотез, которые «сообщали» бóльшие вероятности событию A , и – уменьшиться вероятности гипотез, «сообщавших» событию A малые вероятности. Для решения этой задачи воспользуемся принципом умножения вероятностей (11.22), согласно которому напишем равенство P AH i P H i P A| H i P A P H i | A . (11.55) Отсюда следует P A | H i P Hi . (11.56) P A Соотношение (11.56) показывает, что послеопытные вероятности гипотез P H i | A становятся пропорциональными тем вероятностям P H i , которые они «сообщали» событию A до опыта, с коэффициентами пропорциональности P A| H i / P A . Окончательно из равенств (11.56) и (11.53) находим P Hi | A P Hi | A P A| H i P H i P A| H1 P H1 P A| H 2 P H 2 ... P A| H n P H n . (11.57) Полученное выражение носит название формулы Байеса. Оно позволяет найти новые вероятности гипотез H i , если известно, что событие A произошло, т. е. найти условные вероятности гипотез P H i | A . 11.7. Понятие дискретной случайной величины О п р е д е л е н и е 1. Случайной величиной, связанной с данным испытанием, называется переменная величина X, принимающая различные числовые значения в зависимости от случая. О п р е д е л е н и е 2. Случайная величина X называется дискретной, если все ее значения можно пронумеровать x1 , x2 , ... , xi , ... (11.58) и каждому случайному событию X xi указать определенную вероятность P X xi pi , причем должно выполняться равенство pi 1 . (11.59) i 1 О п р е д е л е н и е 3. Законом распределения дискретной случайной величины X будем называть любое правило, заданное таблично, графически или аналитически (в виде формулы), позволяющее находить все вероятности P ( X xi ) pi (i 1, 2,...) . 246 О п р е д е л е н и е 4. Дискретная случайная величина X считается заданной, если заданы все ее значения и известен закон распределения вероятностей. Другими словами можно сказать, что задана полная группа событий, и события состоят в том, что случайная величина принимает то или иное значение из последовательности (11.58) с вероятностью P ( X xi ) pi , вычисляемой по известному закону распределения. Если случайная величина X может принимать лишь конечное число различных значений, то простейшей формой ее задания является таблица, в которой указаны возможные значения xi случайной величины и соответствующие им вероятности pi : xi x1 x2 ··· ··· xn pi p1 p2 ··· ··· pn Она называется таблицей распределения случайной величины. Случайная величина может быть так же задана графически в виде многоугольника распределения вероятностей. В этом случае в прямоугольной системе координат Oxp строятся точки xi , pi и соединяются отрезками прямых (рис. 79). Заметим, что значение xi , p имеющее наибольшую вероятность, называется модой случайной величины. На рис. 79 мода равна значению x3 . Некоторые законы расp1 p 2 p3 p 4 pn пределения вероятностей дискретной случайной величины 0 x1 x2 x3 x4 xn x часто встречаются при решении практических задач. РасРис. 79 смотрим каждое из распределений отдельно и найдем его аналитическое выражение. 11.8. Гипергеометрическое распределение Прежде чем дать определение гипергеометрического распределения, рассмотрим задачу следующего содержания. Из урны, в которой N шаров, в том числе S белых S N , слу- чайным образом последовательно извлекается n шаров n N без возвращения их в урну. Требуется найти вероятность того, что среди них окажется ровно k белых шаров. 247 Обозначим через X случайную величину – число k белых шаров среди n извлеченных. Тогда возможные значения X таковы: 0,1, 2, ... , min S , n . Для нахождения вероятности P X k используем классическое определение вероятности события (11.27). Общее число равновозможных событий, состоящих в последовательном извлечении из урны n шаров, равно числу сочетаний CNn . Число благоприятных событий (когда окажется k белых шаров среди n извлеченных), согласно правилу произведения (11.30) равно числу сочетаний C Sk , умноженному на число сочетаний CNnkS . Таким образом, P X k C Sk C Nn kS . C Nn (11.60) Распределение вероятностей по формуле (11.60) называется гипергеометрическим. П р и м е р. В партии из 12 деталей имеется 8 стандартных. Найти вероятность того, что среди 5 взятых наудачу деталей окажется 3 стандартных. Р е ш е н и е. Обозначим N 12 , S 8 , n 5 , k 3 . По формуле (11.60) находим C 3 C 5 3 8! 4! 5! 7! 8! 7! 2 3 4 5 6 7 14 P X 3 8 5128 . 3 ! 5 ! 2 ! 2 ! 12 ! 12 ! 9 10 11 12 33 C12 11.9. Биномиальное распределение Пусть производится n испытаний, причем вероятность появления события A в каждом испытании равна p и не зависит от исхода других испытаний. Такая последовательность независимых испытаний называется схемой Бернулли или схемой повторной выборки (по схеме возвращенного шара). В условиях схемы Бернулли найдем вероятность того, что при n испытаниях событие A наступит k раз ( k n ). Интересующая нас случайная величина X – число появлений события A при n - кратном повторении испытания. Возможными значениями величины X служат числа 0 , 1, 2 , ..., n . Найдем закон распределения вероятностей случайной величины X . Событие X n означает появление события A во всех испытаниях; по правилу умножения вероятностей (с учетом условия независимости) получаем 248 AA ... A n Pn X n Pn p . n раз Аналогично находим Pn X 0 q n , где q 1 p P A . Событие X k k 1 , 2 , ... , n 1 означает, что за n испытаний случайное событие A наступит точно k раз и, значит, n k раз наступит противоположное событие A . Вероятность того, что событие A наступит k раз и не наступит n k раз, подсчитаем по правилу умножения вероятностей: Pn AA ... A A A ... A p k q n k . k раз n k раз Эта вероятность не зависит от того, в каких именно испытаниях наступит событие A . Поэтому по принципу сложения вероятностей искомая вероятность Pn X k равна вероятности p k q nk , умноженной на число Cnk способов выбора k испытаний, в которых наступит событие A , из общего числа n испытаний: n! Pn X k Cnk p k q n k p k q nk . (11.61) k !n k ! Формула (11.61) называется формулой Бернулли. Распределение вероятностей дискретной случайной величины X по формуле (11.61) называется биномиальным распределением. П р и м е р. Вероятность брака в данной партии изделий p 0 ,1 . Какова вероятность того, что в партии из 10-ти изделий будет 2 бракованных изделия? Р е ш е н и е. 10 ! 0,1 2 0 ,9 8 0 ,19 . P10 X 2 C102 p 2 q 8 2! 8! 11.10. Распределение Пуассона Рассмотрим случай редких событий, когда число испытаний n , а вероятность появления события p 0 , притом так, что среднее число появлений события (11.62) np остается постоянным в каждом испытании. Примерами таких редких событий являются: «сбой» в автоматическом соединении, авария на городском транспорте, опечатка в книге, рождение близнецов, достижение столетнего возраста и т. п. 249 Подставляя, согласно допущению (11.62), значения p , q 1 p 1 n n в формулу Бернулли (11.61), преобразуем ее следующим образом: Pn X k Ank k nk 1 Pk n n nn 1n 2 ...n k 1 k k 1 1 k! n n n k 1 2 k 1 1 1 ... 1 1 1 . k ! n n n n n n k k n 1 Пусть постоянно. Тогда с учетом, что lim 1 e , получим 0 n k k lim Pn X k lim 1 e . (11.63) n k ! n n k! Отсюда при больших n и малых p для искомой вероятности Pn X k имеем приближенную формулу Пуассона k e , где np . (11.64) k! Эта формула выражает закон распределения Пуассона вероятностей массовых ( n велико) и редких ( p мало) событий. П р и м е р. Пусть вероятность изготовления нестандартной детали равна 0,004. Найти вероятность того, что среди 1000 деталей окажется пять нестандартных. Р е ш е н и е. Здесь n = 1000, p = 0,004, = n p = 4. По формуле (11.64) находим 45 - 4 128 4 P1000 X 5 е е 0,1563 . 5! 15 Pn X k 11.11. Математическое ожидание дискретной случайной величины Каждый закон распределения описывает дискретную случайную величину с вероятностной точки зрения. Однако во многих случаях достаточно знать лишь наиболее существенные числовые параметры, характеризующие распределение случайной величины. Их называют числовыми характеристиками. Одной из важнейших числовых характеристик положения случайной величины является ее математическое ожидание. 250 Предположим, что произведено n испытаний, в которых дискретная случайная величина X приняла значения x1 , x2 , ... , x n соответственно k1 , k 2 , ... , k n раз, так что k1 k 2 ... k n n . Тогда среднее арифметическое значение величины X выразится формулой x1k1 x2k2 ... xn kn k k k (11.65) x1 1 x2 2 ... xn n . n n n n k Так как каждый коэффициент i p*i является, согласно формуле n (11.28), относительной частотой события X xi , то xср. xср. x1 p1* x2 p2* ... xn pn* . (11.66) Из статистического определения вероятности события следует, что при достаточно большом числе испытаний относительную частоту p*i можно приближенно принять за значение вероятности pi i 1, p*i 2 , ... , n : pi Pn X xi . Поэтому n xср. x1 p1 x2 p2 ... xn pn xi pi . (11.67) i 1 По аналогии с рассмотренным примером вводится понятие математического ожидания дискретной случайной величины. Пусть некоторая дискретная случайная величина X задана таблицей xi x1 x2 ··· ··· xn pi p1 p2 ··· ··· pn О п р е д е л е н и е 1. Математическим ожиданием M X дискретной случайной величины X называется сумма произведений ее значений на соответствующие им вероятности: n M X x1 p1 x2 p2 ... xn pn xi pi . (11.68) Из формул (11.67) и (11.68) следует, что M X xср. , (11.69) i 1 т. е. математическое ожидание дискретной случайной величины X приближенно равно ее среднему арифметическому значению. Если на оси Ох в точках с абсциссами x1 , x2 , ... , xn поместить массы p1 , p2 ,..., pn , удовлетворяющие условию 251 n pi 1, то i 1 абсцисса x c центра тяжести системы материальных точек определяется по формуле, известной из механики, n xc xi pi i 1 n pi n xi pi . (11.70) i 1 i 1 Формула (11.70) по виду совпадает с формулой (11.68), поэтому математическое ожидание M X называется центром распределения вероятностей случайной величины X . Математическое ожидание дискретной случайной величины обладает следующими свойствами. С в о й с т в о 1. Математическое ожидание постоянной величины C равно этой величине: M C C . Д о к а з а т е л ь с т в о. Постоянную величину C можно рассматривать как случайную величину, которая принимает лишь одно значение C с вероятностью p 1 . Поэтому M C C 1 C . С в о й с т в о 2. Постоянный множитель можно выносить за знак математического ожидания, т. е. M CX CM X . Д о к а з а т е л ь с т в о. Используя определение математического ожидания (11.68), имеем M C X C x1 p1 C x2 p 2 ... C xn p n C x1 p1 x2 p 2 ... xn p n C M X . О п р е д е л е н и е 2. Две дискретные случайные величины X и Y называются независимыми, если закон распределения каждой из них не зависит от того, какие возможные значения приняла другая величина. Несколько случайных величин называются взаимно независимыми, если закон распределения каждой из них не зависит от возможных значений остальных случайных величин. Используя последнее определение, следующие свойства примем без доказательства. С в о й с т в о 3. Математическое ожидание суммы двух случайных независимых величин X и Y равно сумме их математических ожиданий: (11.71) M X Y M X M Y . Следствием свойств 2 и 3 является свойство 4. С в о й с т в о 4. Математическое ожидание разности двух случайных независимых величин X и Y равно разности их математических ожиданий: (11.72) M X Y M X M Y . 252 С в о й с т в о 5. Математическое ожидание произведения двух независимых случайных величин X и Y равно произведению их математических ожиданий: (11.73) M X Y M X M Y . Следствием свойств 1 и 4 являются свойства 6 и 7. С в о й с т в о 6. Если все значения случайной величины X уменьшить на одно и то же число C , то математическое ожидание ее уменьшится на то же число C : (11.74) M X C M X M C M X C . С в о й с т в о 7. Математическое ожидание отклонения случайной величины X от ее математического ожидания равно нулю: (11.75) M X M X M X M M X M X M X 0 . 11.12. Дисперсия и среднее квадратическое отклонение дискретной случайной величины Математическое ожидание, являясь числовой характеристикой положения центра распределения вероятностей, описывает случайную величину не полностью, так как не учитывает рассеяния или разброса случайной величины относительно ее математического ожидания. Покажем это на примере. Пусть две дискретные случайные величины X и Y заданы своими законами распределения таблично: X p –2 0 2 0,4 0,2 0,4 Y p –100 0 100 0,3 0,4 0,3 Тогда M X 2 0,4 0 0,2 2 0,4 0 , M Y 100 0,3 0 0,4 100 0,3 0 . Несмотря на то, что математические ожидания случайных величин X и Y одинаковы, можно сказать, что случайная величина Y имеет гораздо больший разброс своих значений относительно математического ожидания. По этой причине, наряду с математическим ожиданием, вводят числовую характеристику рассеяния значений дискретной случайной величины относительно ее математического ожидания. Рассеяние случайной величины X связано с отклонением X M X этой величины от ее математического ожидания. Формула (11.75) показывает, что непосредственное осреднение отклонения X M X с помощью математического ожидания не может дать числовой характеристики рассеяния, так как отклонения противоположных знаков в среднем взаимно погашаются, что приводит к равенству M X M X 0 . Однако можно освободиться от этого недостатка, если рассматривать математическое ожидание квадрата отклонения случайной величины X . 253 О п р е д е л е н и е 1. Дисперсией D X дискретной случайной величины X называется математическое ожидание квадрата отклонения случайной величины X от ее математического ожидания M X : D X M X M X , или в развернутом виде 2 (11.76) D X x1 M X 2 p1 x2 M X 2 p2 ... xn M X 2 pn . (11.77) Дисперсия дискретной случайной величины обладает следующими свойствами. С в о й с т в о 1. Дисперсия дискретной случайной величины X равна разности между математическим ожиданием квадрата величины X и квадратом ее математического ожидания: (11.78) D X M X 2 M 2 X . Д о к а з а т е л ь с т в о. Используя формулу (11.76) и свойства математического ожидания, имеем M X 2 M X M M X M M X M X 2 M X M X M X M X . D X M X M X 2 M X 2 2 X M X M 2 X 2 2 2 2 2 2 2 С помощью этого свойства и свойств математического ожидания устанавливаются еще четыре свойства дисперсии. С в о й с т в о 2. Дисперсия постоянной величины C равна нулю: DC 0 . С в о й с т в о 3. Постоянный множитель C можно выносить за знак дисперсии, возводя его в квадрат: DC X C 2 D X . С в о й с т в о 4. Дисперсия суммы двух независимых случайных величин равна сумме дисперсий этих величин: D X Y D X DY . С в о й с т в о 5. Дисперсия разности двух независимых случайных величин X и Y равна сумме их дисперсий: D X Y D X DY . Дисперсия имеет размерность квадрата случайной величины. Иногда, для характеристики рассеяния, удобнее пользоваться величиной, размерность которой совпадает с размерностью случайной величины. Такая величина – среднее квадратическое отклонение. О п р е д е л е н и е 2. Средним квадратическим отклонением X случайной величины X называется корень квадратный из ее дисперсии: X D X . (11.79) 254 11.13. Закон больших чисел Под законом больших чисел понимается совокупность условий, при выполнении которых среднее арифметическое достаточно большого числа случайных величин сколько угодно мало отклоняется от неслучайной постоянной величины – среднего арифметического их математических ожиданий. Эти условия указываются в теореме Чебышева и в теореме Бернулли, которые носят общее название закона больших чисел. Теорема Чебышева является наиболее общим законом, а теорема Бернулли – простейшим законом больших чисел. Рассмотрим сначала вспомогательные теоремы: лемму и неравенство Чебышева. Л е м м а Ч е б ы ш е в а. Пусть X – дискретная случайная величина, принимающая только неотрицательные значения x1 , x2 , ..., xn с вероятностями p1 , p2 , ..., pn соответственно. Тогда (11.80) P X 1 M X . Д о к а з а т е л ь с т в о. По принципу сложения вероятностей для несовместимых событий (11.18) имеем P X 1 рi , i | xi 1 где суммирование распространено на все значения xi 1. Но для них, очевидно, pi xi pi . Поэтому P X 1 n xi рi xi рi xi рi xi pi . i|xi 1 i|xi 1 i|xi 1 i 1 Но последняя сумма по определению (11.68) совпадает с M X . Тем самым неравенство (11.80) доказано. Н е р а в е н с т в о Ч е б ы ш е в а. Для любой случайной величины X при каждом положительном числе имеет место неравенство D X (11.81) P X M X 1 . 2 Неравенство (11.81) называется неравенством Чебышева. Оно имеет простой геометрический смысл (рис. 80): ( M X M X ) M X x Рис. 80 вероятность попадания случайной величины X в интервал М Х ; М Х ), где М Х – математическое ожидание, а – сколь угодно 255 малое положительное число, не меньше разности между единицей и отношением дисперсии D Х к квадрату . Д о к а з а т е л ь с т в о. Случайные события Х М Х Х М Х и – противоположные. Поэтому (см.(11.24)) P Х М Х 1 P Х М Х Х М Х Так как событие . равносильно событию Х М Х 2 1, 2 то, согласно неравенству (11.80) леммы, имеем: Х М Х 2 P Х М Х 1 P 1 2 Х М Х 2 1 1 M Х М Х 2 1 D X . 1 M 2 2 2 Здесь использованы свойство 2 математического ожидания и определение дисперсии (11.76). Итак, D X P Х М Х 1 2 , что и требовалось доказать. П р и м е р. Оценить вероятность события Х М X 3Х , где Х – среднее квадратическое отклонение величины X . Р е ш е н и е. Полагая в (11.81) 3 Х , получим P Х М Х 3 X 1 1 0 ,888 ... . 9 Для большинства встречающихся на практике случайных величин эта вероятность значительно ближе к единице, чем 0,888... . Обычно, если закон распределения случайной величины неизвестен, но указаны параметры М Х и Х , принимают, что диапазон практически возможных значений случайной величины есть интервал М Х 3 X ; М Х 3 X . Указанное правило принято называть «правилом трех сигм». Т е о р е м а Ч е б ы ш е в а. (Закон больших чисел). Если дисперсии независимых случайных величин X 1 , X 2 , ... , X n ограничены одной и той же постоянной C , т. е. D X i C i 1, 2 , ... , n , то для любого числа 0 вероятность выполнения неравенства , X M X (11.82) 256 где X X1 X 2 ... X n / n – среднее арифметическое случайных величин, а M X – среднее арифметическое их математических ожиданий, стремится к единице при n : lim P n X M X 1 . (11.83) Д о к а з а т е л ь с т в о. Применяя неравенство Чебышева (11.81) к величине X , имеем D X (11.84) P X M X 1 . 2 Пользуясь свойствами дисперсии и условием теоремы, получим 1 1 C D X 2 D X 1 D X 2 ... D X n 2 nC . n n n С учетом того, что вероятность любого события не превосходит единицы, из неравенства (11.84) получим C 1 2 P X M X 1 . (11.85) n Наконец, переходя в неравенстве (11.85) к пределу при n , по теореме математического анализа о пределе сжатой переменной приходим к искомому соотношению (11.83). Теорема доказана. Ч а с т н ы й с л у ч а й т е о р е м ы Ч е б ы ш е в а. Если все независимые случайные величины X k имеют одинаковые математиче- M X 1 M X 2 ... M X n p k 1, 2 , ... , n , то ские ожидания lim P n X p 1 . и D X k C (11.86) Из частного случая теоремы Чебышева следует теорема Бернулли, являющаяся простейшей формой закона больших чисел. k Т е о р е м а Б е р н у л л и. Пусть p* – относительная чаn стота наступления события A в n независимых испытаниях, в каждом из которых вероятность события A равна p . Тогда для любого числа 0 выполняется соотношение (11.87) lim P | p * p | 1 . n Д о к а з а т е л ь с т в о. Частоту p* события A рассмотрим как среднее арифметическое одинаково распределенных дискретных случайных величин X 1 , X 2 , ... , X n , выражающих число наступлений события A в отдельных испытаниях: 257 X 1 X 2 ... X n k . n n Тогда из формулы (11.86) сразу получаем соотношение (11.87), что и доказывает теорему Бернулли. Отсюда видно, что теорема Бернулли объясняет, почему при достаточно большом числе испытаний относительная частота p* k / n обладает устойчивостью и оправдывает статистическое определение вероятности (11.29). Закон больших чисел лежит в основе многообразных физических явлений, различных видов страхования, планирования ассортимента товаров широкого потребления. В законе больших чисел находит свое научное обоснование широко применяемый в экономической статистике выборочный метод. p* 11.14. Интегральная функция распределения. Непрерывная случайная величина Пусть X – случайная величина с возможными значениями из некоторого интервала a; b и x – действительное число. О п р е д е л е н и е 1. Интегральным законом распределения или интегральной функцией распределения случайной величины X называется функция F x , равная вероятности того, что X примет значение, меньшее x : F x P X x . Очевидно, что для дискретной случайной величины (11.88) F x (11.89) рi , xi x где суммирование ведётся по всем i, для которых xi x . Будем говорить что известно распределение случайной величины X , если известна ее интегральная функция распределения F x . Рассмотрим общие свойства функции распределения. С в о й с т в о 1. Значения функции распределения принадлежат отрезку 0 ; 1 : 0 Fx 1. (11.90) Д о к а з а т е л ь с т в о. Свойство вытекает из определения (11.88): вероятность всегда есть неотрицательное число, не превышающее единицы. С в о й с т в о 2. F x – неубывающая функция, т. е. F x1 F x2 , если x1 x2 . 258 (11.91) Д о к а з а т е л ь с т в о. Пусть x1 x2 . Событие « X примет значение, меньшее x2 » можно представить в виде суммы двух несовместимых событий: « X примет значение, меньшее x1 » и « X примет значение, удовлетворяющее неравенствам x1 X x2 ». Обозначим их вероятности соответственно P X x1 и P x1 X x2 . По принципу сложения вероятностей двух несовместимых событий имеем P X x2 P X x1 P x1 X x2 . Отсюда с учетом (11.88) и (11.90) (11.92) P x1 X x2 F x2 F x1 0 . Следовательно, F x1 F x2 , что и требовалось доказать. С л е д с т в и е 1. Вероятность попадания случайной величины X в полуинтервал a ; b равна приращению на нем функции распределения: (11.93) P a X b F b F a . Это важное следствие вытекает из формулы (11.92), если принять x2 b и x1 a . О п р е д е л е н и е 2. Случайная величина X называется непрерывной, если её функция распределения F x есть непрерывная дифференцируемая функция с непрерывной производной во всех точках, кроме, быть может, конечного числа точек на любом конечном интервале. С л е д с т в и е 2. Вероятность того, что непрерывная случайная величина X примет какое-либо заранее заданное значение x1 , равна нулю: (11.94) P X x1 0 . Действительно, положив в (11.92) x2 x1 x , будем иметь (11.95) P x1 X x1 x F x1 x F x1 F x1 . Так как F x – непрерывная функция, то, переходя в равенстве (11.95) к пределу при x 0 , по второму определению непрерывности в точке имеем lim F x1 0 ; следовательно, P X x1 0 . x0 Используя это, легко убедиться в справедливости равенств P a X b P a X b P a X b P a X b . (11.96) Таким образом, не представляет интереса говорить о вероятности того, что непрерывная случайная величина примет одно определенное значение, но имеет смысл рассматривать вероятность попадания ее в интервал, пусть даже сколь угодно малый. Например, интересуются вероятностью того, что размеры деталей не выходят за дозволенные границы, но не ставят вопроса о вероятности их совпадения с проектным размером. 259 С в о й с т в о 3. Если возможные значения случайной величины принадлежат интервалу a; b , то: X 1) F x 0 при x a ; 2) F x 1 при x b . Д о к а з а т е л ь с т в о. 1) Пусть x1 a . Тогда событие X x1 невозможно по условию и, следовательно, вероятность его равна нулю. 2) Пусть x2 b . Тогда событие X x2 достоверно и, следовательно, вероятность его равна единице. С л е д с т в и е 3. Если возможные значения непрерывной случайной величины расположены на всей оси Ох, то справедливы предельные соотношения: F lim F x 0 , F lim F x 1 . x x Типичные графики функции F x показаны на рис. 81 для дискретного распределения и на рис. 82 для непрерывного распределения случайной величины X. F (x) F (x) 1 1 x 0 0 Рис. 81 x Рис. 82 11.15. Дифференциальная функция распределения О п р е д е л е н и е 1. Дифференциальной функцией распределения непрерывной случайной величины X или ее плотностью вероятности называется функция f x , равная производной интегральной функции распределения: (11.97) f x F x . Плотность вероятности имеет следующие свойства. С в о й с т в о 1. Плотность вероятности – неотрицательная функция: f x 0. Д о к а з а т е л ь с т в о. Так как функция распределения F x – неубывающая функция, то ее производная F x f x 0. С в о й с т в о 2. Вероятность попадания непрерывной случайной величины X в интервал a; b равна определенному интегралу от ее плотности вероятности, взятому в пределах от a до b : b P a X b f x dx . (11.98) a 260 Д о к а з а т е л ь с т в о. Так как F x является первообразной для f x , то на основании формулы Ньютона – Лейбница имеем b f x dx F b F a . (11.99) a Теперь с учетом соотношений (11.93), (11.96), (11.99) получим b Pa X b Pa X b F b F a f x dx. a С в о й с т в о 3. Несобственный интеграл от плотности вероятности в пределах от до равен единице: f x dx 1 . (11.100) Д о к а з а т е л ь с т в о. В соответствии с формулой (11.98) несобственный интеграл в (11.100) выражает вероятность того, что случайная величина примет значение из интервала ; . Но это событие достоверное, а потому вероятность его равна единице. С л е д с т в и е. Если все возможные значения случайной величины X принадлежат интервалу a ;b , то b f x dx 1 . (11.101) a Плотность вероятности f x и функция распределения F x непрерывной случайной величины X взаимно определяют друг друга. Действительно, если известна функция распределения F x , то плотность вероятности f x найдется по определению (11.97): f x F x . Наоборот, зная плотность вероятности f x , можно найти функ- цию распределения F x : F x P X x P X x x f x dx. (11.102) Таким образом, для полной характеристики непрерывной случайной величины достаточно задать или функцию распределения F x , или ее плотность вероятности f x . Однако в большинстве случаев имеют дело с плотностью вероятности из-за удобств при теоретических исследованиях и из-за простых геометрических и вероятностных интерпретаций. Остановимся подробнее на геометрической и вероятностной интерпретациях выведенных формул и свойств функций f x и F x . 261 О п р е д е л е н и е 2. Кривой распределения непрерывной случайной величины X называется график ее плотности вероятности f x (рис. 83). f x A f x0 B F x 0 P a X b x a b x0 x Рис. 83 Плотность вероятности f x 0 , поэтому ось Ox служит асимптотой кривой распределения. Как следует из формулы (11.102) и геометрического смысла несобственного интеграла, вероятность того, что случайная величина X примет значение, меньшее x : F x P X x , численно равна левой заштрихованной площади полубесконечной фигуры на рис. 83. Вероятность же того, что непрерывная случайная величина примет какое-нибудь значение из интервала a;b , численно равна площади криволинейной трапеции a Α Β b (см. рис. 83). Этот вывод получаем из формулы (11.98) и геометрического смысла определенного интеграла. Формула (11.100) геометрически означает, что площадь, ограниченная кривой распределения y f x и осью абсцисс, равна единице. Поясним смысл названия «плотность вероятности». По теореме о среднем значении непрерывной функции из формулы (11.98) получаем среднее значение плотности вероятности на интервале a; b : b f c f x dx a ba P a X b , ba где с – некоторая точка из a; b , acb. Представим себе, что интервал a; b стягивается к точке x0 a; b . Тогда c x0 и по свойству непрерывности f x на a; b получаем lim c x 0 Pa X b f x0 . ba (11.103) 262 Предел (11.103) естественно рассматривать как плотность вероятности в точке x0 . Отсюда и название для функции f x – плотность вероятности. 11.16. Числовые характеристики непрерывной случайной величины Из дифференциального исчисления известно, что приращение непрерывной функции приближенно равно дифференциалу функции, т. е. F x x F x d F x , или, так как d F x F x x f x x , то (11.104) F x x F x f x x . Вероятностный смысл этого равенства таков: вероятность того, что случайная величина примет значение, принадлежащее интервалу x; x x , приближенно равна произведению плотности вероятности в точке x на длину интервала x. Используя (11.104), распространим определения числовых характеристик дискретных величин на величины непрерывные. Пусть непрерывная случайная величина X задана плотностью вероятности f x . Допустим, что все возможные значения X принадлежат отрезку a; b . Разобьем этот отрезок на n частичных отрезков длиной x1 , x2 , ... , xn и выберем в каждом из них произвольную точку xi i 1, 2 , ... , n . Составим сумму произведений возможных значений xi на вероятности попадания их в интервал xi : n xi f xi xi . (11.105) i 1 Сумма (11.105) есть интегральная сумма функции x f x на отрезке a; b , поэтому ее предел при max xi 0 выражается опредеb ленным интегралом x f x dx . a О п р е д е л е н и е 1. Математическим ожиданием непрерывной случайной величины X , возможные значения которой принадлежат отрезку a; b , называют определенный интеграл b M X x f x dx . (11.106) a Если возможные значения принадлежат всей оси Ox , то M X x f x dx . (11.107) 263 Предполагается, что несобственный интеграл сходится абсолютно, т. е. существует x f x dx . Если бы требование не выполнялось, то значение интеграла зависело бы от скорости стремления (в отдельности) нижнего предела к , а верхнего – к . По аналогии с дисперсией дискретной величины определяется и дисперсия непрерывной величины. О п р е д е л е н и е 4. Дисперсией непрерывной случайной величины X называют математическое ожидание квадрата ее отклонения: b D X x M X 2 f x dx ; (11.108) a если возможные значения X принадлежат всей оси Ox , то D X 2 x M X f x dx . (11.109) Нетрудно получить для вычисления дисперсии и более удобные формулы: b D X x 2 f x dx M 2 X , D X (11.110) a 2 2 x f x dx M X . Среднее квадратическое отклонение непрерывной случайной величины определяется, как и для величины дискретной, формулой X D X . (11.111) Математическое ожидание и дисперсия непрерывной величины имеют те же свойства, что и для дискретной величины. 11.17. Закон равномерного распределения на отрезке При решении задач, возникающих в практике, приходится иметь дело с различными распределениями непрерывных случайных величин. Часто встречаются, например, законы равномерного, показательного и нормального распределений. О п р е д е л е н и е. Распределение вероятностей непрерывной случайной величины X , принимающей все свои значения из отрезка a; b , называется равномерным, если ее плотность вероятности f x на этом отрезке постоянна, а вне его равна нулю, т. е. 264 xa , 0, (11.112) f x C , a x b , 0, x b . Примерами равномерного распределения являются: 1) X – время ожидания на остановке автобуса (величина X распределена равномерно на отрезке 0 ; T , где T – интервал движения между автобусами); 2) X – ошибка при взвешивании случайно выбранного предмета, получающаяся от округления результата взвешивания до ближайшего целого числа (величина X имеет равномерное распределение на отрезке 0, 5; 0, 5 , где за единицу принята цена деления шкалы). Значение постоянной C определяется из условия (11.100), которому удовлетворяет любая плотность вероятности: b f x dx C dx C b a 1 . a Отсюда следует: C 1 . График f x изображен на рис. 84. ba f x F x 1 ba 0 a b 1 x 0 a b x Рис. 84 Рис. 85 Определим интегральную функцию распределения по формуле (11.102): если x a , 0, x dx xa F x , если a x b , (11.113) b a b a a b dx 1, если x b. а b a График функции F x показан на рис. 85. Укажем основные числовые характеристики случайной величины X , подчиненной закону равномерной плотности на отрезке a; b : 265 b b a a M X x f x dx b D X a x dx a b , ba 2 b a , 1 ab x dx ba 2 12 X D X 2 2 (11.114) ba . 2 3 11.18. Показательное распределение. Показательный закон надежности О п р е д е л е н и е. Распределение вероятностей непрерывной случайной величины X называется показательным, если плотность вероятности есть при x 0 , 0 f x x при x 0 , e (11.115) где – постоянная положительная величина. Показательный закон распределения встречается во многих задачах теории массового обслуживания, теории надежности технических устройств, в военном деле, в задачах автоматизации производства и организации систем сообщений. Найдем функцию распределения показательного закона: F x x 0 x 0 x x f x dx 0 dx e dx 1 e . Итак, при x 0 , 0 F x -x при x 0 . 1 e (11.116) Графики плотности вероятности и интегральной функции распределения показательного закона изображены на рис. 86. F x f x 1 0 0 x Рис. 86 266 x Используя формулы (11.107) и (11.110), по заданной плотности вероятности (11.115) методом интегрирования по частям найдем математическое ожидание и дисперсию показательного распределения: M X 0 D X x f x dx xe -x dx 0 1 , (11.117) x 2 f x dx M 2 X x 2 e x dx 1 2 1 1 2 2 2 . (11.118) 2 0 0 Среднее квадратическое отклонение, согласно (11.111), равно 1 (11.119) X . Таким образом, математическое ожидание и среднее квадратическое отклонение показательного распределения равны между собой и обратны величине параметра . Рассмотрим пример использования показательного распределения в теории надежности. Пусть элемент некоторого устройства начинает работать в момент времени t0 0 , а по истечении времени длительностью t происходит его отказ. Обозначим через T непрерывную случайную величину – длительность времени безотказной работы элемента. Тогда функция распределения (11.120) F t PT t определяет вероятность отказа за время длительностью t . Вероятность безотказной работы элемента за то же время t , как вероятность противоположного события T t , будет равна (11.121) R t P T t 1 P T t 1 F t . Часто длительность времени T безотказной работы элемента имеет показательный закон распределения с плотностью вероятности f t e t при t 0 , интегральная функция распределения которого F t 1 e- t . Тогда вероятность безотказной работы элемента есть функция распределения вида R t e- t , (11.122) где – среднее число отказов, приходящихся на единицу времени. Функцию R t называют показательным законом надежности. П р и м е р. Время безотказной работы элемента распределено по показательному закону f t 0,01 e 0,01 t при t 0 ( t – время в часах). Найти вероятность того, что элемент проработает безотказно 100 часов. Р е ш е н и е. По условию 0,01 . Следовательно, R 100 e 0,01100 e 1 0,368 . 267 11.19. Нормальный закон распределения Среди всех непрерывных распределений случайной величины X наиболее часто встречается на практике распределение с плотностью вероятности 1 f x e 2 xa 2 2 2 (11.123) . Такое распределение называется нормальным законом распреде- ления с параметрами a, 0 . Множитель 1 / 2 условия (11.100) нормировки плотности f x . выбран из Значение параметра a M X в формуле (11.123) равно математическому ожиданию рассматриваемой случайной величины. Точка x a для закона нормального распределения является центром распределения вероятностей. При x a функция f x имеет наибольшую ординату f a 1/ 2 (рис. 87). Кривая нормального распределения, называемая кривой Гаусса, симметрична относительно прямой x a и сдвигается вдоль оси Ox вправо при a 0 и влево при a 0 , не меняя своей формы. f x 1 2 0 a x Рис. 87 Параметр X D X , имеющий размерность случайной величины X , характеризует форму кривой нормального распределения. На рис. 88 показаны три нормальные кривые при a 0 для значений 1/ 2 , 1 , 2 . Рассматривая их, видим, что при уменьшении вероятность значений, близких к центру распределения x 0 , увеличивается, а при увеличении – уменьшается. При этом в последнем случае сама кривая становится более плоской, растягиваясь вдоль 268 оси абсцисс, так как площадь фигуры под кривой распределения всегда должна оставаться равной единице. Рис. 88 Заметим, что при a 0 и 1 кривую 2 1 x f x (11.124) e 2 2 называют нормированной. Она симметрична относительно оси ординат (в силу четности f x ), при x 0 имеет максимум, равный 1/ 2 0,40 , и имеет две точки перегиба при x 1 . При x кривая асимптотически приближается к оси Ox , причем весьма быстро, например, уже f 3 0,0044 . Интеграл от плотности (11.124) не выражается через элементарные функции. Для расчета вероятностей случайных величин с нормальным распределением составлены таблицы специальной функции x t2 2 (11.125) e 2 dt , 2 0 называемой интегралом вероятностей. Функция x нечетная, т. е. x x x . График x приведен на рис. 89. При изменении x от 0 до функция x возрастает от значения 0 0 до значения 1 , причем возрастает очень быстро: уже 3 0,9973 , 5 0,99999994 1 . 269 x 1 0,954 0,68 –2 –1 0 1 2 x –1 Рис. 89 С помощью интеграла вероятностей x можно вычислить вероятность попадания случайной величины X со стандартным нормальным распределением с параметрами a 0 , 1 в любой интервал x1 ; x2 : Ρ x1 X x2 x2 x1 f t dt 1 2 x2 0 t2 2 e 1 dt 2 x1 e t2 2 dt , 0 т. е. P x1 X x2 1 (11.126) x2 x1 . 2 В частности, для симметричного интервала x; x получаем P x X x 1 2 x x x . (11.127) Последнее соотношение позволяет толковать интеграл вероятностей x (11.125) при x 0 как вероятность попадания в симметрич- ный интервал x; x для случайной величины со стандартным нормальным законом распределения. Расчет вероятностей в общем нормальном распределении (11.123) производится с помощью интеграла вероятностей x по формулам (11.126) и (11.127) следующим образом. Вероятность попадания случайной величины X в интервал ; равна интегралу 270 x e dt 1 1 (11.128) x2 x1 , 2 a a где x1 , x2 . В частности, вероятность отклонения величины X от центра распределения вероятностей x a (т. е. от математического ожидания) меньше, чем на t , равна β 1 Ρ X e 2 α x a 2 2 2 1 dx 2 x2 t2 2 (11.129) P X a t Ρ a t X a t t . Например, (11.130) Ρ X a 3 3 0,9973 . Формулу (11.130) обычно трактуют следующим образом: для нормально распределенной случайной величины практически достоверно, что ее отклонения от центра не превосходят утроенного среднего квадратического отклонения (так называемое «правило трех сигм»). На практике правило трех сигм применяют так: если распределение изучаемой случайной величины неизвестно, но условие, указанное в приведенном правиле, выполняется, то есть основание предполагать, что изучаемая величина распределена нормально; в противном случае она не распределена нормально. З а м е ч а н и е. На практике вместо интеграла вероятностей x (11.125) часто пользуются функцией Лапласа: x 1 1 x x e 2 2 0 t2 2 dt , (11.131) значения которой табулированы в большинстве учебных пособий. При этом в формулах (11.126) – (11.130) нужно заменить x на 2 x . Нормальное распределение имеет в теории вероятностей очень большое значение. Нормальному закону подчиняется вероятность при стрельбе по цели, в измерениях геометрических и физических величин, при массовом производстве больших партий однотипных изделий и т. п. Можно сказать, что закон распределения суммы достаточно большого числа независимых (или слабо зависимых) случайных величин, подчиненных каким угодно законам распределения и ничтожно мало влияющих на всю сумму, близок к нормальному распределению. Этот факт, называемый центральной предельной теоремой, был доказан русским математиком А. М. Ляпуновым (1857 – 1918). 271