Задачи к экзамену.

advertisement

Computer science клуб, Санкт-Петербург. Апрель 2015.

Упражнения к курсу

Введение в теорию информации. А.Е. Ромащенко

Задачи к экзамену.

1. Для множества A ⊂ N4 будем обозначать πi,j,k (A) проекцию A на координатную плоскость,

задаваемую осями с номерами i, j, k (индексы i, j, k изменяются от 1 до 4). Докажите, что всякого

конечного A выполняется неравенство

3 log |A| ≤ log |π123 (A)| + log |π124 (A)| + log |π134 (A)| + log |π234 (A)|.

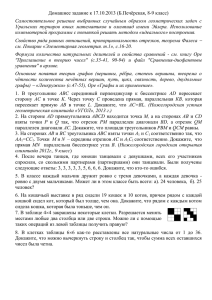

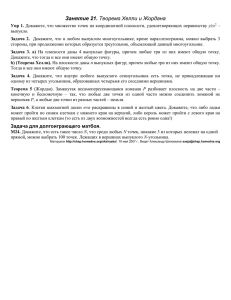

2. Обозначим Ln число путей длины n в ориентированном графе, изображенном на рис. 1

n)

Найдите lim χ(L

(где χ(Ln ) обозначает информацию Хартли в множестве

n

n→∞

Ln ).

0

1

3. В задаче «угадай число» первый игрок задумывает целое число, а второй

игрок должен отгадать это число, последовательно задавая вопросы: допускающие ответы да или нет. При этом второй игрок должен оплачивать получаемые

ответы: получив ответ «да» он платит рубль, а получив ответ «нет» платит два

рубля. Сколько денег нужно иметь, чтобы гарантированно отгадать целое число Рис. 1: Сильно связный ориентированиз интервала от 1 до 100?

4. Для относительной взаимной информации (взаимной информации меж- ный граф.

ду случайными величинами a и b относительно случайной величины c) имеется

три варианта определения.

P

Первое определение: I(a : b | c) :=

I(a : b | c = C) · Prob[c = C] (здесь I(a : b | c = C)

C

обозначает взаимную информацию между a и b в условном распределении информации на парах (a, b)

при зафиксированном значения c = C; суммирование по всем значениям C случайной величины c).

Второе определение: I(a : b | c) := H(b | c) − H(b | a, c).

Третье определение: I(a : b | c) := H(a | c) + H(b | c) − H(a, b | c).

Докажите, что эти три определения относительной взаимной информации эквивалентны.

5. Докажите, что для любых совместно распределённых случайных величин выполнены неравенства

a) 2H(a, b, c) ≤ H(a, b) + H(a, c) + H(b, c | a),

b) H(a, b, c) + H(a) ≤ H(a, b) + H(a, c),

c) H(c | d) ≤ H(c | a) + H(c | b) + I(a : b | d).

6. Докажите, что неравенство

2H(a, b, c) ≤ H(a, b) + H(a, c | b) + H(b, c | a)

выполнено не для всех троек случайных величин.

7. Докажите, что неравенство

I(a : b) ≤ I(a : b | x) + I(a : b | y) + I(x : y)

выполнено не для всех четвёрок случайных величин.

8. (a) Существует ли такое распределение вероятностей для тройки случайных величин (a, b, c), что

I(a : b) = 0 и I(a : b | c) > 0?

(b) Существует ли такое распределение вероятностей для тройки случайных величин (a, b, c), что

I(a : b) > 0 и I(a : b | c) = 0?

9. (a) Пусть последовательность случайных величин a − b − c образует цепь Маркова. Докажите,

что I(a : c) ≤ I(a : b) и I(a : c) ≤ I(b : c).

(b) Пусть последовательность случайных величин a − b − c − d образует цепь Маркова. Докажите,

что I(a : d) ≤ I(b : c).

10. Пусть энтропия случайной величины a равна h, а взаимная информация пар a и b, а также a и

c больше 3h/4. Докажите, что взаимная информация b и c больше h/2.

11. Совместно распределённые случайные величины a и b распределены на n-элементном множестве. Обозначим ε = Prob[a 6= b]. Докажите, что H(a | b) ≤ 1 + ε log(n − 1).

12. Приведите пример распределения вероятностей, для которого код Шеннона–Фано не является

оптимальным. Указание: Сравните код Шеннона–Фано и код Хаффмана.

13. Существует ли распределение вероятностей на 4-элементном множестве, для которого код

Шеннона–Фано не является оптимальным?

14. Известно, что для некоторого совместного распределения (a, b, c)

H(a | b, c) = H(b | a, c) = H(c | a, b) = 0,

I(a : b | c) = I(a : c | b) = I(b : c | a) = k,

I(a : b : c) = −k.

Докажите, что в таком случае k = log N для некоторого целого N .

15. Обозначим α0 α1 α2 . . . αn траекторию случайного блуждания по графу, изображенному на рис. 2,

начинающуюся в вершине 0 (αi обозначает номер вершины на i-ом шаге блуждания, начальная вершина α0 = 0; находясь в вершине 1, мы на очередном

1-p

шаге обязательно переходим в вершину 0; находясь же в вершине 0, мы с ве- p

0

1

роятностью p остаёмся на месте, а с вероятностью 1 − p переходим в вершину

1).

Обозначим h(p) = lim H(α0 αn1 ...αn ) . Найдите max h(p).

1

n→∞

p∈(0,1)

16. Пусть для некоторого распределения (a, b, c)

I(a : b | c) = I(a : c | b) = I(b : c | a) = 0.

Рис. 2: Марковское

блуждание на графе.

Докажите, что найдётся такая случайная величина d, что H(d) = I(a : b : c), и a, b, c независимы

относительно d (т.е., у тройки a, b, c можно «материализовать» взаимную информацию).

17. Имеется некоторое совместное распределение случайных величин (a, b, c, x, y). Известно, что

I(a : b | c) = I(a : c | b) = I(b : c | a) = 0.

Докажите, что в таком случае выполнено неравенство I(a : b) ≤ I(a : b | x) + I(a : b | y) + I(x : y).

18. Каждому распределению вероятностей (a, b, c, d) можно сопоставить набор из 15 энтропий (энтропии каждой из четырёх случайных величин, энтропии каждой пары, каждой тройки, и всей четвёрки). Зафиксируем порядок на этих 15 величинах и будем называть все такие векторы в R15 энтропийными. Докажите, что замыкание множества всех энтропийных векторов образует выпуклый конус

в R15 .

2

19. Рассмотрим задачу разделение секрета для следующей структуры доступа с 4 участниками:

минимальными группами участников, знающих секрет, являются четыре пары

{1, 2}, {1, 3}, {2, 3}, {3, 4}.

Докажите, что для данной структуры доступа невозможно идеальное разделение секрета.

20. Докажите, что для любой структуры доступа с 3 участниками существует идеальная схема

разделения секрета.

21. Известно, что в некоторой структуре доступа Γ ⊂ P({1, . . . , n}) нет ни одно участника, который

в одиночку может узнать секрет (в каждой авторизованной группе не меньше 2 участников). Пусть

распределение вероятностей (S0 , S1 , . . . , Sn ) является совершенной схемой разделения секрета для Γ,

причём значение секрета S0 принимает с ненулевыми вероятностями k разных значений. Докажите,

что существует такая схема разделения секрета (S00 , S10 , . . . , Sn0 ), в которой S00 равномерно распределено

на k-элементном множестве, а для всех i = 1, . . . , n выполнено H(Si0 ) = H(Si ) (т.е., распределение на

множестве секретов можно сделать равномерным, не изменяя энтропию долей участников схемы).

22. (a) Существует ли такой оптимальный алгоритмический способ описания F , что величина колмогоровской сложности KF (x) для любого слова x чётна? (b) Такой, что колмогоровская сложность

любого слова x является степенью двойки?

23. Пусть вычислимая функция F является оптимальным способом описания для колмогоровской

сложности. Докажите, что отображение G, определяемое для всякого слова p как G(p) = F (F (p)),

тоже является оптимальным способом описания.

24. Докажите, что K(x, K(x)) = K(x) + O(1).

25. Докажите, что для всех достаточно больших чисел n верно следующее свойство: если слово x

длины 2n состоит из ровно n единиц и ровно n нулей, то K(x) < 2n (слово сжимаемо).

26. Докажите, что существует такое число C, что для всех слов x, y

K(x, y) ≤ K(x) + K(y) + log(|x| + |y|) + C.

27. Докажите следующие неравенства для колмогоровской сложности:

(a) 2K(x, y, z) ≤ K(x, y) + K(x, z) + K(y, z|x) + O(log(|x| + |y| + |z|));

(b) K(x, y, z) + K(z) ≤ K(x, z) + K(y, z) + O(log(|x| + |y| + |z|));

(c) K(z) ≤ K(z | x) + K(z | x) + I(x : y) + O(log(|x| + |y| + |z|)).

28. Докажите, что для любых чисел C и D найдутся такие слова x, y, z, что

2K(x, y, z) 6≤ K(x, y) + K(x, z|y) + K(y, z|x) + C log(K(x, y, z)) + D.

P

29. Докажите, что ряд

2−K(x) расходится.

x∈{0,1}∗

30. Докажите, что для любого m, для всех достаточно больших n найдется не менее m слов x

длины n таких, что K(x) ≥ n.

31. Докажите, что для префиксной колмогоровской сложности выполняется неравенство

KP(x, y) ≤ KP(x) + KP(y) + O(1).

32. Докажите, что для любой константы C, для бесконечно многих x

KP(x) > K(x) + C

(для слова x префиксная сложность больше простой колмогоровской сложности).

33. Докажите, что если последовательность битов x1 x2 x3 . . . xn . . . случайна по Мартин-Лёфу, то

её подпоследовательность x1 x3 x5 . . . x2n+1 . . . тоже случайна по Мартин-Лёфу.

34. Докажите, что в любой случайной по Мартин-Лёфу последовательности битов x1 x2 x3 . . . встречаются сколь угодно длинные отрезки, состоящие из идущих подряд нулей.

35. В последовательности битов x1 x2 x3 . . . xn . . . в каждом префиксе длине n не встречается больше

log n

нулей подряд. Докажите, что такая последовательность не может быть случайной по Мартин2

Лёфу.

3

Дополнительные упражнения.

1. Докажите, что log(n!) = n log(n/e) + O(log n) (упрощенный вариант формулы Стирлинга).

2. Докажите, что для любого распределения вероятностей код Хаффмана имеет минимальную

среднюю длину среди всех однозначно декодируемых кодов.

3. Сколько нужно взвешиваний на чашечных весах без гирь, чтобы найти среди 40 монет одну

фальшивую, отличающуюся от настоящих по весу (узнавать относительный вес фальшивой монеты не

требуется).

4. Имеется набор из n камней. С помощью чашечных весов без гирь можно сравнить по весу любые

два камня. Сколько необходимо взвешиваний, чтобы найти самый тяжелый и второй по весу камень?

5. Имеется набор из n камней. С помощью чашечных весов без гирь можно сравнить по весу любые

два камня. Сколько необходимо взвешиваний, чтобы найти одновременно самый тяжелый и самый

легкий камень?

6. Сколько нужно задать вопросов, чтобы отгадать целое число из интервала 1..100, если отвечающему разрешается солгать в ответ на один из вопросов?

7. Требуется отгадать целое число из интервала 1..n, задавая вопросы вида «Верно ли, что задуманное число меньше t? » (для произвольной границы t).

(a) Докажите, что если отвечающему

разрешается солгать в одном из ответов, то задуманное число

p

можно определить за ≤ log2 n + O( log2 n) вопросов.

(b) Докажите, что если отвечающему разрешается солгать в одном из ответов, то задуманное число

можно определить за ≤ log2 n + O(log2 log2 n) вопросов.

(c) Докажите, что если отвечающему разрешается солгать в ≤ k ответах, то задуманное число

можно определить за ≤ log2 n + k log2 log2 n + Ck вопросов (константа Ck не зависит от n).

8. В прямоугольнике (одна пара сторон которого вертикальна, а другая горизонтальна) размещено

несколько квадратов, стороны которых параллельны сторонам прямоугольника. Квадраты не имеют

общих внутренних точек. Известно, что каждая горизонтальная прямая, пересекающая прямогольник,

пересекает не меньше m из этих квадратов, а каждая вертикальная — не меньше n. Докажите, что

число квадратов не меньше mn.

9∗ . Докажите, что если I(x : y) = I(x : y | a) = 0, то I(a : b) ≤ I(a : b | x) + I(a : b | y).

10∗ . Докажите, что существует такое число C, что для всех слов x, y, z

KP(x, y, z) + KP(z) ≤ KP(x, z) + KP(y, z) + C.

4

Теоретические вопросы.

1. Теорема Вульфа и Слепяна. Доказажите теорему Вульфа и Слепяна (Slepian and Wolf) о

раздельном кодировании коррелированных источников информации. Литература для подготовки:

[1] D.S. Slepian and J.K. Wolf. Noiseless coding of correlated information sources. IEEE Transactions on

Information Theory (IEEE), 1973, 19 (4), 471-480.

[2] T. Cover and J. Thomas, Elements of Information Theory.

[3] И. Чисар и Я. Кёрнер. Теория информации. Теоремы кодирования для дискретных систем без

памяти.

2. Закон повторного логарифма. Докажите, для почти всех двоичных последовательностей

ω0 ω1 ω2 . . ., для всех ε > 0 и всех достаточно больших n

r

[доля единиц среди первых n битов последовательности] − 1 ≤ (1 + ε) 2 ln ln n .

2

n

Литература для подготовки:

[4] Н. К. Верещагин, В. А. Успенский, А. Шень. Колмогоровская сложность и алгоритмическая

случайность. М.: МЦНМО, 2013

3. Реалистичная оценка сложности сортировки quicksort. Будем порождать бесконечные

последовательности букв α = a1 a2 . . . ak . . . как последовательность значений независимых одинаково

распределенных случайных величин (со значениями в некотором алфавите Σ), каждая из которых имеет энтропию h. Независимо повторим этот опыт n раз и получим n бесконечных последовательностей

букв α(1), . . . , α(n) (если распределение не сосредоточено на единственной букве алфавите, то почти

наверное мы получим n попарно различных последовательностей). Затем отсортируем полученные

α(1), . . . , α(n) в алфавитном порядке, используя алгоритм quicksort. При этом при сравнении каждой

пары последовательностей α(i) и α(j) будем читать их слева направо, пока не найдем первую букву, в которой эти последовательности различаются. Сложностью сортировки будем называть число

сравнений пар букв, которые нам необходимо провести, чтобы отсортировать заданный набор последовательностей.

2

n

Докажите, что средняя сложность описанной сортировки не превосходит O( n log

).

h

n log n

Замечание: Сложность оказывается больше классической оценки O( h ), поскольку мы подсчитываем не число сравнений слов, а число сравнений отдельных букв.

Литература для подготовки:

[5] Brigitte Vallée, Julien Clément, Jim Fill, and Philippe Flajolet. The Number of Symbol Comparisons

in QuickSort and QuickSelect. In Proceedings of ICALP 2009.

[6] Julien Clément, Thu Hien Nguyen Thi, Brigitte Vallée. A general framework for the realistic analysis

of sorting and searching algorithms. Application to some popular algorithms. In Proceedings of STACS

2013.

5