0 ( ) 1 Р А ≤ ≤ А В А В + - Назарбаев Интеллектуальные школы

advertisement

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

Филиал АО «Назарбаев Интеллектуальные школы»

физико-математического направления, г.Кокшетау

Автор: Аубакиров Тойбек Уатаевич - учитель математики,

кандидат физико-математических наук

Методические рекомендации по преподаванию

предмета «Статистика»

В работе приводится краткое содержание раздела «Элементы теории вероятностей и

математической статистики» курса «Статистика» для 11-го класса.

1. Случайные события. Операции над случайными событиями. Поле событий. Определения

вероятности (классическое, геометрическое и статистическое). Аксиоматическое

построение теории вероятностей. Свойства вероятности.

2. Теоремы сложения и умножения. Формула полной вероятности. Формула Байеса.

3. Формула Бернулли. Полиномиальная схема. Наивероятнейшее число появления

события. Локальная и интегральная предельные теоремы Лапласа. Теорема Пуассона.

4. Случайная величина. Дискретная случайная величина. Непрерывная случайная

величина. Математическое ожидание, дисперсия, среднеквадратическое отклонение.

5. Задачи математической статистики. Выборочный метод. Эмпирическая функция

распределения. Полигон и гистограмма.

6. Выборочная средняя, выборочная дисперсия, исправленная выборочная дисперсия,

выборочное

среднеквадратическое

отклонение,

исправленное

выборочное

среднеквадратическое отклонение. Доверительный интервал. Доверительный интервал

для параметров нормального распределения.

7. Корреляционная зависимость. Коэффициент корреляции. Уравнение линейной

регрессии.

8. Проверка статистических гипотез.

Статистическая гипотеза (основная и

альтернативная). Статистический критерий. Значимость критерия. Ошибки первого и

второго рода

Тема 1. Случайные события. Определение вероятности.

Случайным событием называется событие, которое при выполнении некоторого комплекса

условий может произойти или не произойти. Будем рассматривать случайные события, которые

обладают так называемой статистической устойчивостью или, иначе, устойчивостью частот.

Определение 1. Событие называется достоверным в данном испытании, если оно неизбежно

происходит при этом испытании.

Определение 2. Событие называется невозможным в данном испытании, если оно заведомо

не происходит в этом испытании.

Примем как аксиому, что для каждого события А можно определить, по крайней мере

теоретически, вероятность этого события – число Р(А), представляющее, в некотором смысле

«меру достоверности» данного события и подчиненное естественным требованиям.

Предполагается, что вероятность любого события удовлетворяет неравенству

0 Р( А) 1

причем вероятность невозможного события равна нулю, а вероятность достоверного события

равна единице.

Определение 3. Под суммой двух событий А и В понимается событие

А В А В

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

которое имеет место тогда и только тогда, когда произошло хотя бы одно из событий А и

В.

Определение 4. Произведением двух событий А и В называется событие

АВ А В

состоящее в одновременном появлении как события А, так и события В.

Определение 5. Под вероятностью Р(А) события А понимается отношение числа

равновозможных элементарных исходов, благоприятствующих событию А, к общему числу

всех равновозможных и единственно возможных элементарных исходов данного испытания.

Таким образом, если m - число элементарных исходов, благоприятных событию А и n –

общее число всех элементарных исходов при данном испытании, и все эти исходы

равновозможны, то на основании определения имеем формулу

m

.

n

Так как, очевидно, 0 m n , то 0 Р( А) 1, т.е. вероятность любого события есть

Р( А)

неотрицательное число, не превышающее единицы.

Из определения вероятности вытекают следующие основные ее свойства.

1. Вероятность невозможного события равна нулю.

Действительно, если событие А невозможно, то число благоприятных ему элементарных

исходов m = 0, и мы имеем

Р( А)

0

0.

n

2. Вероятность достоверного события равна единице.

В самом деле, если событие А достоверно то, очевидно m = n и, следовательно,

Р( А)

n

1.

n

Определение 6. Два события А и В называются равными, если каждое из них происходит

всякий раз, когда происходит другое. Обозначается A=В.

Теорема 1. Равные события имеют равные вероятности, т.е. если А=В, то

Р(А)=Р(В).

Определение. Говорят, что из события А следует событие В ( A B) , если событие В

появляется всякий раз, как только произошло событие А.

Теорема 2. Если A B , то P( A) P( B) .

Определение 7. Событие A , происходящее тогда и только тогда, когда не происходит

событие А, называется противоположным последнему.

Например, если при бросании монеты событие А есть выпадение герба, то событие A

представляет собой не выпадение герба, т.е. выпадение решетки.

Из определения 7 следует, что 1) А+ A достоверно; 2) А A невозможно.

Теорема 3. Вероятность противоположного события A равна дополнению вероятности

данного события А до 1, т.е.

P( A) 1 P( A) .

Тема 2. Теоремы сложения и умножения вероятностей. Формула полной вероятности.

Формула Байеса.

Важную роль в теории вероятностей играют следующие две теоремы.

Теорема 1. Вероятность суммы двух событий равна суме вероятностей этих событий без

вероятности их совместного появления, т.е.

Р(А+В)=Р(А)+Р(В)-P(AB).

В случае если события А и В несовместны, то данная формула принимает следующий вид

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

Р(А+В)=Р(А)+Р(В).

Определение 1. Вероятность события А при условии, что произошло событие В, называется

условной вероятностью события А и обозначается так:

Р(А/В)=Рв(А).

Определение 2. Два события А и В называются независимыми, если вероятность каждого из

них не зависит от появления или не появления другого, т.е.

P( A) PB ( A) PB ( A) и P( A) PA ( B) PA ( B) .

В противном случае события называются зависимыми.

Теорема 2. Вероятность произведения (совмещения) двух событий А и В равна произведению

вероятности одного из них на условную вероятность другого, в предположении, что первое

имеет место, т.е.

Р(АВ)=Р(А)РА(В).

В случае если события А и В независимы, то данная формула записывается в следующем виде

Р(АВ)=Р(А) Р(В).

Предположим, что событие B может осуществиться с одним и только одним из n

несовместимых событий A1, A2, …, An. Иными словами, положим, что

n

B BAi ,

(1)

i 1

где события BAi и BA j с разными индексами i и

вероятностей имеем

j несовместимы. По теореме сложения

n

P( B) P( BAi ).

i 1

Использовав теорему умножения, находим, что

n

P( B) P( Ai ) P( B | Ai ).

i 1

Это равенство носит название формулы полной вероятности и играет основную роль во всей

дальнейшей теории.

Выведем теперь важные формулы Байеса или, как иногда говорят, вероятности гипотез. Пусть по

прежнему имеет место равенство (1). Требуется найти вероятность события Ai, если известно,

что событие B произошло. Согласно теореме умножения имеем

P( Ai B) P( B) P( Ai | B) P( Ai ) P( B | Ai ).

Отсюда

P( Ai | B)

P( Ai ) P( B | Ai )

,

P( B)

используя формулу полной вероятности, находим, что

P( Ai | B)

P( Ai ) P( B | Ai )

n

P( Ai ) P( B | Ai )

.

i 1

Тема 3. Схема испытаний Бернулли. Формула Бернулли. Предельные теоремы.

Если производятся испытания, при которых вероятность появления события А в каждом

испытании не зависит от исходов других испытаний, то такие испытания называют

независимыми относительно события А. Здесь нами рассматриваются независимые испытания,

в каждом из которых вероятность появления события одинакова.

Формула Бернулли. Вероятность того, что в п независимых испытаниях, в каждом из

которых вероятность появления события равна р (0<p<1), событие наступит ровно k раз

(безразлично, в какой последовательности), равна

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

Pn k

n!

p k g nk ,

k ! n k !

или

Pn k Cnk p k g n k ,

где q 1 p.

Вероятность того, что событие наступит: а) менее k раз; б) более k раз; в) не менее k раз; г)

не более k раз – находят соответственно по формулам:

а) Pn (0) Pn (1) ... Pn (k 1);

б) Pn (k 1) Pn (k 2) ... Pn (n);

в) Pn (k ) Pn (k 1) ... Pn (n);

г) Pn (0) Pn (1) ... Pn (k ).

Для достаточно больших значений n вычисления по выше указанным формулам

практически невозможны. В этом случае можно воспользоваться так называемыми

предельными теоремами.

Локальная теорема Лапласа. Вероятность того, что в n независимых испытаниях, в

каждом из которых вероятность появления события равна p (0<p<1), событие наступит

ровно k раз, приближенно равна

Pn k

1

( x),

npq

где

( x)

1 x2 2

k np

e

,x

.

2

npq

Интегральная теорема Лапласа. Вероятность того, что в n независимых испытаниях, в

каждом из которых вероятность появления события равна p (0<p<1), событие наступит не

менее k1 раз и не более k2 , приближенно равна

Pn k1; k2 ( x '') ( x '),

где

x

( x)

2

1

e x 2 dx

2 0

- функция Лапласа.

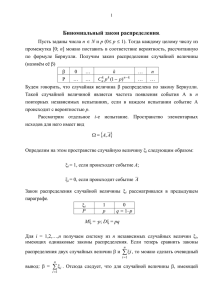

Тема 4. Дискретная случайная величина и ее закон распределения и числовые

характеристики.

Если в соответствие случайным событиям полной группы случайных событий поставлены

в соответствие некоторые числа, то говорят, что задана случайная величина. Случайные

величины в зависимости от того, какой вид имеют множества принимаемых значений делятся

на дискретные и непрерывные.

Дискретная случайная величина и ее закон распределения.

Величина называется случайной, если она принимает свои значения в зависимости от

исходов некоторого испытания, причем для каждого элементарного исхода оно имеет

единственное значение. Случайная величина называется дискретной, если множество всех

возможных значении ее конечно или счетно.

Пусть Х - дискретная случайная величина, возможными и единственно возможными

значениями которой являются числа х1,х2,...,хn.. Обозначим через рi=P(X=xi)

(i=1,2,...,n)

вероятности этих значений. События X = xi (i=1,2,...,n), очевидно, образуют полную группу

событий, поэтому

р1+р2+...+рn=1.

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

Определение. Соответствие между всеми возможными значениями дискретной случайной

величины и их вероятностями называется законом распределения данной случайной величины.

В простейших случаях закон распределения дискретной случайной величины Х удобно

задавать таблицей:

Х

х1

х2

...

хn

Р

p1

p2

...

pn

Пример 1. В денежной лотерее разыгрывается 1 выигрыш в 100000 тг., 10 выигрышей по 10000

тг. и 100 выигрышей по 1000 тг., при общем числе билетов 10000. Найти закон распределения

случайного выигрыша Х для владельца одного лотерейного билета.

Здесь возможные значения для Х есть х1=100000, х2=10000, х3=1000, х4=0.

Вероятности их соответственно будут

р1=0,0001, р2=0,001, р3=0,01, р4=1-( р1+ р2+ р3)=0,9889.

Закон распределения для выигрыша Х может быть задан таблицей:

Х

100000

10000

1000

0

Р

0,0001

0,001

0,01

0,9889

Математическое ожидание.

Определение. Математическим ожиданием дискретной случайной величины называется

сумма парных произведений всех возможных ее значений на их вероятности.

Если х1,х2,...,хn есть (полный) набор всех значений дискретной случайной величины Х и

р1,р2,...,рn - соответствующие им вероятности, то, обозначая буквой М математическое

ожидание, будем иметь

n

M ( X ) xi pi

(1)

i 1

где

n

p

i 1

i

1

(2)

Пример. Найти математическое ожидание выигрыша Х в примере 1.

Решение. Пользуясь помещенной там таблицей, имеем

М(Х)= 1000000,0001+100000,001+10000,01+00,9889 = 30 (тенге).

Основные свойства математического ожидания.

Теорема 1. Математическое ожидание постоянной величины равно этой постоянной, т.е.

если С - постоянна величина, то

М(С)=С.

Теорема 2. Математическое ожидание суммы двух (или нескольких) случайных величин равно

сумме математических ожиданий этих величин, т.е. если Х и У - случайные величины, то

М(Х+У) = М(Х)+М(У).

Следствие 1. Если С - постоянная величина, то

М(Х+С)=М(Х)+С

Теорема 3. Математическое ожидание произведения двух независимых случайных величин

равно произведению их математических ожиданий, т.е.

М(ХУ)=М(Х)М(У),

где Х и У - независимые случайные величины.

Следствие 2. Постоянный множитель можно выносить за знак математического ожидания.

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

Если С - постоянная величина и Х - любая случайная величина, то, учитывая, что С и Х

независимы, на основании теоремы 1 получим

М(СХ)=М(С)М(Х)=СМ(Х)

Следствие 3. Математическое ожидание разности любых двух случайных величин Х и У равно

разности математических ожиданий этих величин, т.е.

М(Х-У)=М(Х)-М(У).

Дисперсия.

Пусть Х - случайная величина, М(Х) - ее математическое ожидание. Случайную величину Х

- М(Х) называют отклонением.

Теорема 4. Для любой случайной величины Х математическое ожидание ее отклонения от

математического ожидания равно нулю, т.е.

М[Х-М(Х)]=0.

Определение. Дисперсией случайной величины называют математическое ожидание

квадрата отклонения этой величины от ее математического ожидания.

Отсюда, обозначая дисперсию буквой D, для случайной величины Х будем иметь

D(Х)=М{[Х-М(Х)]2}

(3)

Корень квадратный из дисперсии D(Х) называется средним квадратичным отклонением

этой величины:

( X ) D( X )

(4)

Пример. Пусть закон распределения случайной величины задан таблицей:

Х

4

10

20

Р

¼

1/2

1/4

Определить математическое ожидание М(Х), дисперсию D(Х) и среднее квадратичное

отклонение ( X ) .

Имеем

M (X ) 4

отсюда

D( X ) (4 11)2

и

1

1

1

10 20 11

4

2

4

1

1

1

(10 11) 2 (20 11) 2 33

4

2

4

( X ) D( X ) 33 5,75

Теорема 5. Дисперсия случайной величины равна разности между математическим

ожиданием квадрата этой величины и квадратом ее математического ожидания, т.е.

D(Х)=М(Х2)-[М(Х)]2 .

Теорема 6. Дисперсия постоянной величины равна нулю.

Теорема 7. Дисперсия суммы двух независимых случайных величин Х и У равна сумме дисперсий

этих величин, т.е.

D(Х+У)=D(Х)+D(У).

Теорема 8. Постоянный множитель можно выносить за знак дисперсии, возводя его в

квадрат, т.е.

D(CX)=C2D(X).

Следствие. Дисперсия разности двух независимых случайных величин равна сумме дисперсий

этих величин, т.е. если случайные величины Х и Y независимы, то

D(X-Y)=D(X)+D(Y)

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

Тема 5. Непрерывные случайные величины. Функция распределения и числовые

характеристики.

Случайную величину Х будем называть непрерывной, если все ее возможные значения

целиком заполняют некоторый конечный или бесконечный промежуток (а, b) числовой оси.

Для характеристики непрерывной случайной величины Х вводят функция распределения

Ф( X ) P( X x) .

Теорема. Вероятность (до опыта) того, что непрерывная случайная величина Х примет

заранее указанное строго определенное значение а, равна нулю.

Предположим, что для непрерывной случайной величины Х ее функция распределения

Ф(х) имеет непрерывную производную

Ф( x) ( x) .

Функцию ( x) называют плотностью вероятности или дифференциальным законом

распределения случайной величины Х.

Функция распределения

x

Ф( x) P( X x)

(t )dt .

Числовые характеристики непрерывной случайной величины.

Определение. Под математическим ожиданием непрерывной случайной величины Х

понимается число

M (X )

x ( x)dx .

Аналогично,

b

D( X ) [ x M ( X )] ( x)dx , причем

2

a

b

( x)dx 1

a

Равномерное распределение.

Непрерывная случайная величина Х все возможные значения которой заполняют конечный

промежуток (a, b) называется равномерно распределенной, если ее плотность вероятности

( x) постоянна на этом промежутке.

Под вероятностью А понимается отношение меры l множества элементарных исходов,

благоприятствующих событию А, к мере L множества всех возможных элементарных исходов в

предположении, что они равновозможны:

P( A)

l

1

L

Нормальное распределение.

Распределение вероятностей случайной величины Х называется нормальным, если плотность

вероятности подчиняется закону Гаусса

( x) aeb ( x x ) .

2

0

Стандартный вид нормального

дифференциальной форме:

закона

распределения

1

( x)

e

2

случайной

величины

Х

в

( x x0 )2

2 2

,

где x0 M ( X ) и D( X )

Таким образом, нормальный закон распределения зависит только от двух параметров:

математического ожидания и среднего квадратичного отклонения.

Нормальный закон распределения случайной величины в интегральной форме имеет вид:

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

1

Ф( x )

2

x

e

( z z0 ) 2

2 2

dz

.

Формулы упрощаются, если ввести нормированное отклонение

t

Тогда

x x0

.

t2

1

1

( x)

e 2 0 (t )

2

Тема 6. Задачи математической статистики. Выборочный метод. Эмпирическая функция

распределения. Полигон и гистограмма.

Установление закономерностей, которым подчинены массовые случайные явления,

основано на изучении методами теории вероятностей статистических данных — результатов

наблюдений.

Первая задача математической статистики - указать способы сбора и группировки

статистических сведений, полученных в результате наблюдений или в результате специально

поставленных экспериментов.

Вторая задача математической статистики - разработать методы анализа статистических

данных в зависимости от целей исследования. Сюда относятся:

а)

оценка неизвестной вероятности события; оценка неизвестной функции распределения;

оценка параметров распределения, вид которого известен; оценка зависимости случайной

величины от одной или нескольких случайных величин и др.;

б)

проверка статистических гипотез о виде неизвестного распределения или о величине

параметров распределения, вид которого неизвестен.

Современная математическая статистика разрабатывает способы определения числа

необходимых испытаний до начала исследования (планирование эксперимента), в ходе

исследования (последовательный анализ) и решает многие другие задачи. Современную

математическую статистику определяют как науку о принятии решений в условиях

неопределенности.

Итак, задача математической статистики состоит в создании методов сбора и обработки

статистических данных для получения научных и практических выводов.

Статистическим

распределением

выборки

называют

перечень

вариант

и

соответствующих им частот или относительных частот. Статистическое распределение можно

задать также в виде последовательности интервалов и соответствующих им частот (в качестве

частоты, соответствующей интервалу, принимают сумму частот, попавших в этот интервал).

Заметим, что в теории вероятностей под распределением понимают соответствие между

возможными значениями случайной величины и их вероятностями, а в математической

статистике - соответствие между наблюдаемыми вариантами и их частотами, или

относительными частотами.

Пусть известно статистическое распределение частот количественного признака X. Введем

обозначения: nх—число наблюдений, при которых наблюдалось значение признака, меньшее х;

n - общее число наблюдений (объем выборки). Ясно, что относительная частота события X < х

равна nх/n. Если х изменяется, то, вообще говоря, изменяется и относительная частота, т, е.

относительная частота nх/n есть функция от х. Так как эта функция находится эмпирическим

(опытным) путем, то ее называют эмпирической.

Эмпирической функцией распределения (функцией распределения выборки) называют

функцию F*(x), определяющую для каждого значения х относительную частоту события X < х.

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

Итак, по определению,

F*(x) = nх/n,

где nх - число вариант, меньших х; n - объем выборки.

В отличие от эмпирической функции распределения выборки функцию распределения

F(х)

генеральной совокупности называют теоретической функцией распределения. Различие между

эмпирической и теоретической функциями состоит в том, что теоретическая функция F(х)

определяет вероятность события X < х, а эмпирическая функция F*(х) определяет

относительную частоту этого же события. Из теоремы Бернулли следует, что относительная

частота события X < х, т. е. F*(х) стремится по вероятности к вероятности F{x) этого события.

Из определения функции F* (х) вытекают следующие ее свойства:

1) значения эмпирической функции распределения принадлежат отрезку [0, 1];

2) F* (х) — неубывающая функция;

3) если x1 — наименьшая варианта, то F*(x) = 0 при х х1, если х2-— наибольшая варианта,

то F*(x)= 1 при x > x2.

Эмпирическая функция распределения выборки служит для оценки теоретической

функции распределения генеральной совокупности.

Для наглядности строят различные графики статистического распределения и, в частности,

полигон и гистограмму.

Полигоном частот называют ломаную, отрезки которой соединяют точки (х1; n1), (x2; n2),

..., (xk; nk). Для построения полигона частот на оси абсцисс откладывают варианты xi, a на оси

ординат—соответствующие им частоты ni. Точки (xi ; ni) соединяют отрезками прямых и

получают полигон частот.

Полигоном относительных частот называют ломаную, отрезки которой соединяют точки

(х1; W1), (х2;W2), ......, (xk; Wk). Для построения полигона относительных частот на оси абсцисс

откладывают варианты xi, а на оси ординат—соответствующие им относительные частоты Wi.

Точки (хi; Wi) соединяют отрезками прямых и получают полигон относительных частот.

Гистограммой частот называют ступенчатую фигуру, состоящую из прямоугольников,

основаниями которых служат частичные интервалы длиною h, a высоты равны отношению ni/h

(плотность частоты).

Тема 7. Параметры распределения. Точечные и интервальные оценки.

Пусть для изучения генеральной совокупности относительно количественного признака X

извлечена выборка объема n.

Выборочной средней хв называют среднее арифметическое значение признака выборочной

совокупности.

Если все значения x1, x2, . . ., хn признака выборки объема n различны, то

хв = (х1 + х2 + ….+ хn)/n.

Если же значения признака х1, х2 ..... xk имеют соответственно частоты n1, n2 ..... nk, причем

n1 + …. + nk = n, то хв = (n1 * х1 + …. + nk* хk)/n,

т. е. выборочная средняя есть средняя

взвешенная значений признака с весами, равными соответствующим частотам.

Выборочная средняя, найденная по данным одной выборки, есть, очевидно, определенное

число. Если же извлекать другие выборки того же объема из той же генеральной совокупности,

то выборочная средняя будет изменяться от выборки к выборке. Таким образом, выборочную

среднюю можно рассматривать как случайную величину, а следовательно, можно говорить о

распределениях (теоретическом и эмпирическом) выборочной средней и о числовых

характеристиках этого распределения (его называют выборочным), в частности о

математическом ожидании и дисперсии выборочного распределения.

Для того чтобы охарактеризовать рассеяние наблюдаемых значений количественного

признака выборки вокруг своего среднего значения хв, вводят сводную характеристику—

выборочную дисперсию.

Выборочной дисперсией Dв называют среднее арифметическое квадратов отклонения

наблюдаемых значений признака от их среднего значения хв.

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

Если все значения х1, х2,..., хn признака выборки объема n различны, то

Dв ( xi xв ) 2 / n

i 1

n

Если же значения признака х1, х2,..., хn имеют соответственно частоты n1, n2,…,nk, причем

n1+ n2+…+nk= n, то

n

Dв ni ( xi xв ) 2 / n

i 1

т. е. выборочная дисперсия есть средняя взвешенная квадратов отклонений с весами, равными

соответствующим частотам.

Кроме дисперсии для характеристики рассеяния значений признака выборочной

совокупности вокруг своего среднего значения пользуются сводной характеристикой—

средним квадратическим отклонением.

Выборочным средним квадратическим отклонением (стандартом) называют квадратный

корень из выборочной дисперсии:

в Dв

Вычисление дисперсии, безразлично—выборочной или генеральной, можно упростить,

используя следующую теорему.

Теорема. Дисперсия равна среднему квадратов значений признака минус квадрат общей

средней:

2

D x xв .

2

Точечной называют оценку, которая определяется одним числом. Все оценки,

рассмотренные выше, — точечные. При выборке малого объема точечная оценка может

значительно отличаться от оцениваемого параметра, т. е. приводить к грубым ошибкам. По этой

причине при небольшом объеме выборки следует пользоваться интервальными оценками.

Интервальной называют оценку, которая определяется двумя числами — концами

интервала. Интервальные оценки позволяют установить, точность и надежность оценок .

*

*

Доверительным называют интервал , , который покрывает неизвестный

параметр с заданной надежностью .

Интервал

*

, * имеет случайные концы (их называют доверительными границами).

Действительно, в разных выборках получаются различные значения . Следовательно, от

выборки к выборке будут изменяться и концы доверительного интервала, т. е. доверительные

границы сами являются случайными величинами — функциями от х1, х2, ..., хn.

Так как случайной величиной является не оцениваемый параметр в, а доверительный интервал,

то более правильно говорить не о вероятности попадания в доверительный интервал, а о

вероятности того, что доверительный интервал покроет .

Метод доверительных интервалов разработал американский статистик Ю. Нейман, исходя из

идей английского статистика Р. Фишера.

*

Оценку x a t / n называют классической. Из формулы

t / n , определяющей

точность классической оценки, можно сделать следующие выводы:

1) при возрастании объема выборки n число убывает и, следовательно, точность оценки

увеличивается;

2) увеличение надежности оценки приводит к увеличению t (Ф (t) — возрастающая

функция), следовательно, и к возрастанию ; другими словами, увеличение надежности

классической оценки влечет за собой уменьшение ее точности.

Тема 8. Элементы теории корреляции.

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

Во многих задачах требуется установить и оценить зависимость изучаемой случайной

величины Y от одной или нескольких других величин. Рассмотрим зависимость Y от одной

случайной (или неслучайной) величины X.

Две случайные величины могут быть связаны либо функциональной зависимостью, либо

зависимостью другого рода, называемой статистической, либо быть независимыми.

Строгая функциональная зависимость реализуется редко, так как обе величины или одна из них

подвержены еще действию случайных факторов, причем среди них могут быть и общие для

обеих величин (под «общими» здесь подразумеваются такие факторы, которые воздействуют и

на Y и на X). В этом случае возникает статистическая зависимость.

Статистической называют зависимость, при которой изменение одной из величин влечет

изменение распределения другой. В частности, статистическая зависимость проявляется в том,

что при изменении одной из величин изменяется среднее значение другой; в этом случае

статистическую зависимость называют корреляционной.

Приведем пример случайной величины Y, которая не связана с величиной X

функционально, а связана корреляционно. Пусть Y — урожай зерна, X—количество удобрений.

С одинаковых по площади участков земли при равных количествах внесенных удобрений

снимают различный урожай, т. е. Y не является функцией от X. Это объясняется влиянием

случайных факторов (осадки, температура воздуха и др.). Вместе с тем, как показывает опыт,

средний урожай является функцией от количества удобрений, т.е. Y связан с X корреляционной

зависимостью.

Пусть изучается система количественных признаков (X, Y). В результате п независимых

опытов получены n пар чисел (x1; y1), (х2; у2), . .., (хn; уn).

Найдем по данным наблюдений выборочное уравнение прямой линии среднеквадратичной

регрессии . Для определенности будем искать уравнение

Yx = kx + b регрессии Y на X.

Поскольку различные значения х признака X и соответствующие им значения у -признака Y

наблюдались по одному разу, то группировать данные нет необходимости. Также нет

надобности использовать понятие условной средней, поэтому искомое уравнение можно

записать так:

y = kx+b.

Угловой коэффициент прямой линии регрессии Y на X называют выборочным коэффициентом

регрессии Y на X и обозначают через рyx; он является оценкой коэффициента регрессии .

Итак, будем искать выборочное уравнение прямой линии регрессии Y на X вида

y = рyx x+b.

Выборочный коэффициент корреляции определяется равенством

rв

nxy xy n x y

n x y

,

где х, у — варианты (наблюдавшиеся значения) признаков X и Y; nxy - частота пары вариант (х,

у); n— объем выборки (сумма всех частот); x , y - выборочные средние квадратические

отклонения; x, y - выборочные средние.

Если величины У и X независимы, то коэффициент корреляции г = 0 ; если г = ±1, то У и X

связаны линейной функциональной зависимостью. Отсюда следует, что коэффициент

корреляции г измеряет силу (тесноту) линейной связи между Y и X.

Выборочный коэффициент корреляции является оценкой коэффициента корреляции r

генеральной совокупности и поэтому также служит для измерения линейной связи между

величинами - количественными признаками Y и X. Допустим, что выборочный коэффициент

корреляции, найденный по выборке, оказался отличным от нуля. Так как выборка отобрана

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

случайно, то отсюда еще нельзя заключить, что коэффициент корреляции генеральной

совокупности также отличен от нуля.

Для оценки тесноты линейной корреляционной связи между признаками в выборке служит

выборочный коэффициент корреляции. Для оценки тесноты нелинейной корреляционной связи

вводят новые сводные характеристики:

yx - выборочное корреляционное отношение Y к X;

xy - выборочное корреляционное отношение X к Y.

Выборочным корреляционным отношением Y к X называют: отношение межгруппового

среднего квадратического отклонения к общему среднему квадратическому отклонению

признака Y:

yx межгр / общ.

Тема 9. Статистическая проверка статистических гипотез.

Часто необходимо знать закон распределения генеральной совокупности. Если закон

распределения неизвестен, но имеются основания предположить, что он имеет определенный

вид (назовем его А), выдвигают гипотезу: генеральная совокупность распределена по закону А.

Таким образом, в этой гипотезе речь идет о виде предполагаемого распределения.

Возможен случай, когда закон распределения известен, а его параметры неизвестны. Если есть

основания предположить, что неизвестный параметр равен определенному значению 0 ,

выдвигают гипотезу: = 0 . Таким образом, в этой гипотезе речь идет о предполагаемой

величине параметра одного известного распределения.

Возможны и другие гипотезы: о равенстве параметров двух или нескольких распределений, о

независимости выборок и многие другие.

Статистической называют гипотезу о виде неизвестного распределения, или о параметрах

известных распределений.

Например, статистическими являются гипотезы:

1) генеральная совокупность распределена по закону Пуассона;

2) дисперсии двух нормальных совокупностей равны между собой.

В первой гипотезе сделано предположение о виде неизвестного распределения, во второй — о

параметрах двух известных распределений.

Гипотеза «на Марсе есть жизнь» не является статистической, поскольку в ней не идет речь ни о

виде, ни о параметрах распределения.

Наряду с выдвинутой гипотезой рассматривают и противоречащую ей гипотезу. Если

выдвинутая гипотеза будет отвергнута, то имеет место противоречащая гипотеза. По этой

причине эти гипотезы целесообразно различать.

Нулевой (основной) называют выдвинутую гипотезу H0.

Конкурирующей (альтернативной) называют гипотезу Н1, которая противоречит нулевой.

Например, если нулевая гипотеза состоит в предположении, что математическое ожидание а

нормального распределения равно 10, то конкурирующая гипотеза, в частности, может состоять

в предположении, что а 10. Коротко это записывают так: H0: а=10; Н1: а=10. Различают

гипотезы, которые содержат только одно и более одного предположений. Простой называют

гипотезу, содержащую только одно предположение. Например, если параметр

показательного распределения, то гипотеза H0: =5 -простая. Гипотеза : математическое

ожидание нормального распределения равно 3 ( известно) — простая. Сложной называют

гипотезу, которая состоит из конечного или бесконечного числа простых гипотез. Например,

сложная гипотеза Н : > 5 состоит из бесчисленного множества простых вида Hi: = bi, где bi

- любое число, большее 5. Гипотеза : математическое ожидание нормального распределения

равно 3 ( неизвестно) — сложная.

Выдвинутая гипотеза может быть правильной или неправильной, поэтому возникает

необходимость ее проверки. Поскольку проверку производят статистическими методами, ее

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

называют статистической. В итоге статистической проверки гипотезы в двух случаях может

быть принято неправильное решение, т. е. могут быть допущены ошибки двух родов. Ошибка

первого рода состоит в том, что будет отвергнута правильная гипотеза.

Ошибка второго рода состоит в том, что будет принята неправильная гипотеза.

Подчеркнем, что последствия этих ошибок могут оказаться весьма различными.

Например, если отвергнуто правильное решение «продолжать строительство жилого дома», то

эта ошибка первого рода повлечет материальный ущерб; если же принято неправильное

решение «продолжать строительство», несмотря на опасность обвала стройки, то эта ошибка

второго рода может повлечь гибель людей. Можно привести примеры, когда ошибка первого

рода влечет более тяжелые последствия, чем ошибка второго рода.

Замечание 1. Правильное решение может быть принято также в двух случаях:

1) гипотеза

принимается, причем и в действительности она правильная; 2) гипотеза

отвергается, причем и в действительности она неверна.

Замечание 2. Вероятность совершить ошибку первого рода принято обозначать через ; ее

называют уровнем значимости. Наиболее часто уровень значимости принимают равным 0,05

или 0,01. Если, например, принят уровень значимости, равный 0,05, то это означает, что в пяти

случаях из ста имеется риск допустить ошибку первого рода (отвергнуть правильную гипотезу).

Для проверки нулевой гипотезы используют специально подобранную случайную величину,

точное или приближенное распределение которой известно. Эту величину обозначают через U

или Z, если она распределена нормально, F или v2 - по закону Фишера - Снедекора, Т — по

закону Стьюдента, - по закону «хи квадрат» и т. д. Поскольку вид распределения во

внимание приниматься не будет, обозначим эту величину в целях общности через K.

Статистическим критерием (или просто критерием) называют случайную величину K,

которая служит для проверки нулевой гипотезы.

Например, если проверяют гипотезу о равенстве дисперсий двух нормальных генеральных

совокупностей, то в качестве критерия К принимают отношение исправленных выборочных

дисперсий:

F s12 / s22 .

Эта величина случайная, потому что в различных опытах дисперсии принимают различные,

наперед неизвестные значения, и распределена по закону Фишера - Снедекора.

Для проверки гипотезы по данным выборок вычисляют частные значения входящих в критерий

величин и таким образом получают частное (наблюдаемое) значение критерия.

Наблюдаемым значением Кнабл называют значение критерия, вычисленное по выборкам.

2

2

Например, если по двум выборкам найдены исправленные выборочные дисперсии s 1 = 20 и s 2

= 5, то наблюдаемое значение критерия F

Fнабл s12 / s22 4.

После выбора определенного критерия множество всех его возможных значений разбивают на

два непересекающихся подмножества: одно из них содержит значения критерия, при которых

нулевая гипотеза отвергается, а другая — при которых она принимается.

Критической областью называют совокупность значений

критерия,

при которых

нулевую гипотезу отвергают.

Областью принятия гипотезы (областью допустимых значений) называют

совокупность значений критерия, при которых гипотезу принимают.

Основной принцип проверки статистических гипотез

можно сформулировать так: если наблюдаемое значение критерия принадлежит критической

области -гипотезу отвергают, если наблюдаемое значение критерия принадлежит области

принятия гипотезы - гипотезу принимают.

Поскольку критерий К- одномерная случайная величина, все ее возможные значения

принадлежат некоторому интервалу. Поэтому критическая область и область принятия

гипотезы также являются интервалами и, следовательно, существуют точки, которые их

разделяют.

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

Критическими точками (границами) kкр называют точки, отделяющие критическую

область от области принятия гипотезы.

Различают одностороннюю (правостороннюю или левостороннюю) и двустороннюю

критические области.

Тестовые задания для самоконтроля

Вариант 1.

1. Событие, которое неизбежно происходит в данном испытании, называется:

A) элементарным B) противоположным C) случайным

D) невозможным E) достоверным

2. Вероятность случайного события принимает значение:

A) 0 p 1 B) 0 p 1 C) p 1 D) p 0 E) p 1

3. Число сочетаний из n элементов по m:

A) Cnm n!(n m) B) C m n!

C) C m!(n m)! D) Cnm n! E) C m n!

m

n

m!(n m)!

n

n

m!

n!

(n m)!

4. Формула сложения вероятностей несовместных событий:

A) P( A B) P( A) P(B) P( A B) B) P( A B) P( A) P( B) P( A B)

C)

n

P( A) P( Bi ) PBi ( A)

D)

P( A B) P( A) P( B)

E)

P( A B) P( A) P( B)

i 1

5. В урне 3 белых, 4 черных и 5 красных шаров. Какова вероятность того, что наудачу вынутый

из урны шар будет черным?

A) 1 B)1/4 C)5/12 D) 0 E) 1/3

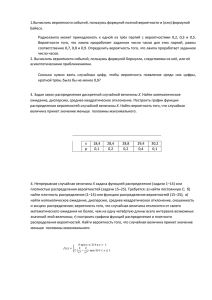

6. Случайная величина характеризуется таблицей распределения:

Определить математическое ожидание: A) 1 B) 1,5 C) 0 D)2 E) 0,5

7. Событие, которое заведомо не происходит в данном испытании, называется:

A) случайным

B) противоположным C) невозможным

D) достоверным E) элементарным

8. Число размещений из n элементов по m:

A) Anm n!(n m) B)

Anm

n!

(n m)!

C)

Anm

m!(n m)!

n!

D) Anm n! E)

m!

Anm

n!

m! (n m)!

9. Формула сложения вероятностей событий:

A) P( A B) P( A) P(B) P( A B)

B) P( A B) P( A) P( B)

n

C) P( A) P( Bi ) P ( A)

B

i 1

i

D) P( A B) P( A) P( B) P( A B)

E) P( A B) P( A) P( B)

10. В группе деталей имеется деталей I сорта – 100 шт., II сорта – 50 шт., III сорта – 50 шт. Из

этой группы извлечена одна деталь. Найти вероятность того, что извлеченная деталь окажется

I-го сорта.

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

A)

3

1

B)

4

1

C)

4

D)

5

2

E)

5

2

Случайная

11.

1

величина

характеризуется

таблицей

распределения:

Определить дисперсию. A) 0,6 B) 0,5 C) 0,7 D) 0,8 E) 1

12. Событие называется достоверным в данном испытании, если:

A) оно зависит от другого события

B) оно заведомо не происходит

C) его нельзя заранее прогнозировать

D) оно не зависит от другого события

E) оно неизбежно происходит

13. Вероятность невозможного события:

A) p 0 B) 0 p 1 C) p 1 D) p 0 E) p 1

14. Стрелок стреляет по мишени, разделенной на 3 области. Вероятность попадания в первую

область равна 0,45, во вторую – 0,35. Найти вероятность того, что стрелок при одном выстреле

попадет либо в первую, либо во вторую область.

A) 0,45 B) 0,9 C) 0,35 D) 0,8 E) 0,2

15. Событие называется невозможным в данном испытании, если:

A) оно неизбежно происходит

B) оно заведомо не происходит

C) его нельзя заранее прогнозировать

D) оно не зависит от другого события

E) оно зависит от другого события

16. Вероятность противоположного события:

A) pA p(A) B) pA 1 p A C) pA p A 1 D) pA 1 E) pA 1 p A

p A

17. Формула умножения вероятностей событий:

A) P( A B) P( A) PA ( B)

B) P( A B) P( A) P(B) P( A B)

C) P( A) P( B ) P ( A) D ) P( A B) P( A) P( B) E) P( A B) P( A) P(B) PA (B)

n

i

i 1

Bi

18. В денежно-вещевой лотерее на каждые 1000 билетов разыгрывается 120 денежных и 80

вещевых выигрышей. Чему равна вероятность выигрыша, безразлично денежного или

вещевого, для владельца одного лотерейного билета.

1

A)

B)

1000

1

C)

5

1

120

Найти

19.

1

D)

E)

4

1

3

дисперсию

случайной

величины

Х,

зная

закон

ее

распределения.

A) 5,75 B) 2,01 C) 10,85 D) 0,95 E) 15,5

20. В семье 5 детей. Найти вероятность того, что среди этих детей ровно два мальчика.

Вероятность рождения мальчика принять равной 0,5:

A)

3

5

B)

1

16

C)

2

5

D)

5

16

E)

1

3

Вариант 2.

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

1. Вероятность случайного события принимает значение:

A) 0 p 1 B) 0 p 1 C) p 1 D) p 0 E) p 1

2. Событие, которое неизбежно происходит в данном испытании, называется:

A) элементарным B) противоположным

C) случайным D) невозможным E) достоверным

3. Число сочетаний из n элементов по m:

A) Cnm n!(n m) B) C m n!

C) C m!(n m)! D) Cnm n! E) C m n!

m

n

m!(n m)!

n

n

m!

n!

(n m)!

4. Формула сложения вероятностей несовместных событий:

A) P( A B) P( A) P(B) P( A B) B) P( A B) P( A) P( B) P( A B)

C)

n

P( A) P( Bi ) PBi ( A)

D)

E)

P( A B) P( A) P( B)

P( A B) P( A) P( B)

i 1

5. В урне 3 белых, 4 черных и 5 красных шаров. Какова вероятность того, что наудачу вынутый

из урны шар будет черным?

A) 1 B)1/4 C)5/12 D) 0 E) 1/3

6. Случайная величина характеризуется таблицей распределения:

Определить математическое ожидание: A) 1 B) 1,5 C) 0 D)2 E) 0,5

7. Событие, которое заведомо не происходит в данном испытании, называется:

A) случайным

B) противоположным

C) невозможным D) достоверным E) элементарным

8. Число размещений из n элементов по m:

A) Anm n!(n m) B)

Anm

n!

(n m)!

C)

Anm

m!(n m)!

n!

D) Anm n!

m!

E)

Anm

n!

m! (n m)!

9. Формула сложения вероятностей событий:

A) P( A B) P( A) P(B) P( A B)

B) P( A B) P( A) P( B)

n

C) P( A) P( Bi ) P ( A)

B

i

i 1

D) P( A B) P( A) P( B) P( A B)

E) P( A B) P( A) P( B)

10. В группе деталей имеется деталей I сорта – 100 шт., II сорта – 50 шт., III сорта – 50 шт. Из

этой группы извлечена одна деталь. Найти вероятность того, что извлеченная деталь окажется

I-го сорта.

A)

3

4

11.

B)

1

4

C)

1

D)

5

Случайная

2

5

E)

1

2

величина

характеризуется

Определить дисперсию.

A) 0,6 B) 0,5 C) 0,7 D) 0,8 E) 1

12. Событие называется достоверным в данном испытании, если:

A) оно зависит от другого события

B) оно заведомо не происходит

таблицей

распределения:

Данный документ является интеллектуальной собственностью

Акционерного общества «Назарбаев Интеллектуальные школы» и не подлежит к использованию в других источниках

C) его нельзя заранее прогнозировать

D) оно не зависит от другого события

E) оно неизбежно происходит

13. Вероятность невозможного события:

A) p 0 B) 0 p 1 C) p 1 D) p 0 E) p 1

14. Стрелок стреляет по мишени, разделенной на 3 области. Вероятность попадания в первую

область равна 0,45, во вторую – 0,35. Найти вероятность того, что стрелок при одном выстреле

попадет либо в первую, либо во вторую область.

A) 0,45 B) 0,9 C) 0,35 D) 0,8 E) 0,2

15. Событие называется невозможным в данном испытании, если:

A) оно неизбежно происходит

B) оно заведомо не происходит

C) его нельзя заранее прогнозировать

D) оно не зависит от другого события

E) оно зависит от другого события

16. Вероятность противоположного события:

A) pA p(A) B) pA 1 p A C) pA p A 1 D) pA 1 E) pA 1 p A

p A

17. Формула умножения вероятностей событий:

A) P( A B) P( A) PA ( B)

B) P( A B) P( A) P(B) P( A B)

C) P( A) P( B ) P ( A) D ) P( A B) P( A) P( B)

n

i

i 1

Bi

E) P( A B) P( A) P(B) PA (B)

18. В денежно-вещевой лотерее на каждые 1000 билетов разыгрывается 120 денежных и 80

вещевых выигрышей. Чему равна вероятность выигрыша, безразлично денежного или

вещевого, для владельца одного лотерейного билета.

1

A)

B)

1000

1

C)

5

1

120

Найти

19.

1

D)

E)

4

1

3

дисперсию

случайной

величины

Х,

зная

закон

ее

распределения.

A) 5,75 B) 2,01 C) 10,85 D) 0,95 E) 15,5

20. В семье 5 детей. Найти вероятность того, что среди этих детей ровно два мальчика.

Вероятность рождения мальчика принять равной 0,5:

A)

3

5

B)

1

16

C)

2

5

D)

5

16

E)

1

3

Литература

1. В.Е. Гмурман Теория вероятностей и математическая статистика. М.: Высшая школа, 2007.

2. В.Е. Гмурман Руководство к решению задач по теории вероятностей и математической

статистике. М.: Высшая школа, 2005.