Алгоритм зеркального спуска (ЗС) представляет

advertisement

c 2014 г.

⃝

А.В. НАЗИН, д-р физ.-мат. наук; nazine@ipu.ru,

С.В. АНУЛОВА, канд. физ.-мат. наук; anulovas@ipu.ru,

А.А. ТРЕМБА, канд. физ.-мат. наук; atremba@ipu.ru

(Институт проблем управления им. В.А. Трапезникова РАН, Москва)

АЛГОРИТМ ЗЕРКАЛЬНОГО СПУСКА

ДЛЯ МИНИМИЗАЦИИ СРЕДНИХ ПОТЕРЬ,

ПОСТУПАЮЩИХ ПУАССОНОВСКИМ ПОТОКОМ

1

Для стохастической системы, функционирующей в непрерывном времени, рассматривается задача минимизации ожидания интегральных потерь на заданном горизонте.

Потери происходят в моменты скачков пуассоновского процесса и являются непрерывной выпуклой функцией управляющего параметра, значения которого образуют

выпуклый компакт в конечномерном пространстве. В моменты скачков оракул выдает

стохастически зашумленные субградиенты функции потерь, ограниченные в среднеквадратическом; шум аддитивный, несмещенный. Предлагается стратегия управления,

порожденная алгоритмом зеркального спуска. Для нее доказана явная верхняя граница

превышения ожидания интегральных потерь над минимумом. Рассмотрен пример, в

котором эта стратегия применена к модели массового обслуживания.

1. Введение

Алгоритм зеркального спуска (ЗС) представляет собой нетривиальное

обобщение стандартного метода градиента для задач выпуклой оптимизации в условиях априорной неопределенности [1]. В ряде случаев

он имеет преимущество перед другими алгоритмами поиска экстремума

при высокой размерности: его гарантируемая скорость сходимости значительно выше. Это ярко выражается и в прикладных задачах, таких,

например, как томография [2], классификация [3] и ранжирование [4].

Первоначальная идея метода ЗС описана в [1] в непрерывном времени,

но сами алгоритмы как в [1], так и в последующих работах по ЗС пред1

Работа выполнена при финансовой поддержке Российского фонда фундаментальных исследований

(проект № 12-08-01245). Первый автор также частично поддержан лабораторией ПреМоЛаб при МФТИ

(ГУ), грант Правительства РФ № 11.G34.31.0073.

1

ставлены в дискретном времени. Мотивация данной статьи — расширить

область применения алгоритмов зеркального спуска к стохастическим

системам со случайным дискретным временем, связанным с наблюдаемым пуссоновским потоком интенсивности λ. Основным результатом

является явная неасимптотическая верхняя оценка для превышения

минимизируемой функции в текущей оценке над минимумом; при этом

оказывается, что заданный горизонт времени T умножается на интенсивность λ. В частности, в задаче выпуклой минимизации на стандартном

симплексе в RN при априорном условии, что ∞-норма стохастического

градиента ограничена параметром L, верхняя оценка полиномиально

зависит от ln N , а не от степени N (что обычно возникает в стандартном

методе градиента).

2. Постановка задачи

Пусть некоторая управляемая система (например, маршрутизатор)

обрабатывает сообщения, поступающие в случайные моменты 0 < τ1 <

τ2 < τ3 . . . В каждый момент τi система несет потери, и задача

оптимального управления содержательно состоит в минимизации математического ожидания суммарных потерь на заданном временно́м интервале [0, T ]. Потери зависят от управляемого параметра, эта зависимость

описывается выпуклой функцией Q, заданной на выпуклом компакте

в конечномерном евклидовом пространстве. Сам процесс потерь не

наблюдается, но имеется текущая информация, которая соответствует

«градиентному» оракулу: в каждый момент времени τi выходом оракула

является стохастически зашумленный субградиент функции Q — стохастический субградиент.

2

2.1. Базовые определения

Перейдем к точным формулировкам. Обозначим через IA индикатор

множества A, т.е. функцию, равную единице на A и нулю вне A.

Евклидово пространство RN будет рассматриваться с некоторой нормой

√

∥·∥ (не обязательно ∥x∥ = x21 + · · · + x2N ), а двойственное пространство

RN — с нормой ∥ · ∥∗ = sup∥x∥61 ⟨·, x⟩, где ⟨·, ·⟩ обозначает скалярное

произведение.

Пусть дано вероятностное пространство (Ω, G, P), на котором определены два независимых объекта: пуассоновский процесс Xt , t ∈ [0, ∞), и

последовательность независимых одинаково распределенных центрированных квадратично интегрируемых случайных величин ξ(1), ξ(2), . . .

с значениями в RN . Обозначим через τ1 , τ2 , τ3 . . . последовательные

моменты скачков процесса X и добавим τ0 = 0. Определим процесс

∑

ξt = ∞

i=1 ξ(i)I[τi ,τi+1 ) (t), t ∈ [0, ∞).

2.2. Функция потерь

Пусть дан выпуклый компакт Θ ⊂ RN — множество параметров

управления. На Θ заданы непрерывная выпуклая функция потерь Q :

Θ → R+ и ее субградиент — ограниченная борелевская вектор-функция

∂Q : Θ → RN , удовлетворяющая условию

(∂Q(θ), θ′ − θ) 6 Q(θ′ ) − Q(θ)

∀ θ, θ′ ∈ Θ .

Из непрерывности Q следует, что она ограничена снизу и существуют

(1)

Q∗ = min Q и θ∗ = argmin Q.

θ∈Θ

θ∈Θ

3

2.3. Задача управления

Множество стратегий управления U состоит из всевозможных

кусочно-постоянных случайных процессов ut с значениями в Θ вида

∑

ut = ∞

i=0 θ(i)I[τi ,τi+1 ) (t), определяемых следующим образом. Неслучайное θ(0) ∈ Θ может быть выбрано произвольно; положим

g(i) = ∂Q(θ(i − 1)) + ξ(i) ,

(2)

где θ(i) — произвольная измеримая функция от случайных величин

g(1), . . . , g(i) с значениями в Θ, i = 1, 2, . . . Соответствующий процесс в

непрерывном времени записывается следующим образом2 :

(3)

gt = ∂Q(ut− ) + ξt ,

t ∈ [0, T ].

Далее задается горизонт времени T > 0 и определяется функционал

(критерий управления)

∫

(4) RT ({ut }) , E

T

Q(ut− )dXt = E

0

i=X

∑T

Q(uτi − ) = E

i=1

i=X

∑T

Q(θ(i − 1)) .

i=1

Идеальная задача управления — минимизировать этот функционал по

множеству стратегий U.

Очевидно, для любой u ∈ U выполнено:

RT (u) > Q∗ EXT .

С другой стороны, для стационарной стратегии управления u = {ut =

θ, t ∈ [0, ∞)} с фиксированным θ ∈ Θ выполнено RT (u) = Q(θ)EXT , а

значит, inf RT (u) по стационарным стратегиям u равен Q∗ EXT . Следовательно, inf RT (u) = Q∗ EXT . Поскольку для пуассоновского процесса

u∈U

2

Под ut− имеется в виду левосторонний предел.

4

EXT = λT, то имеем

inf RT (u) = Q∗ λT = Q(θ∗ )λT.

u∈U

2.4. Дополнительные предположения

Полагаем, что априори известны интенсивность пуассоновского потока λ > 0 и константа L ∈ (0, ∞), ограничивающая стохастические

градиенты в среднеквадратическом:

E∥g(i)∥2∗ 6 L2 ∀ i = 1, 2, . . .

(5)

3. Алгоритм зеркального спуска (ЗС)

Напомним, что алгоритм зеркального спуска представляет собой

прямо-двойственный метод [1–6]. Исходным пространством является

E = RN с нормой ∥ · ∥, а двойственным — E ∗ = RN с соответствующей

нормой ∥ · ∥∗ . Алгоритм ЗС содержит функциональный параметр Wβ :

E ∗ → R — выпуклую непрерывно дифференцируемую функцию со

скалярным параметром β > 0 и удовлетворяющую следующему условию

Липшица:

(6)

∥∇Wβ (z) − ∇Wβ ( z̃ )∥ 6

1

∥z − z̃∥∗

αβ

∀ z, z̃ ∈ E ∗ , β > 0 ,

причем α > 0 — не зависящая от β постоянная. Отметим, что в алгоритме

используется потенциальное поле ∇Wβ : E ∗ → Θ, отображающее E ∗ в

множество Θ (см. далее предложение 1, п. 2, (ii)).

Для рассматриваемой здесь задачи алгоритм ЗС запишем в следующем виде с учетом непрерывности времени и специфики пуассоновского

процесса.

5

1. Фиксируем начальные значения пары сопряженных переменных:

.

.

ζ0 = ζ(0) = 0 ∈ E ∗ и θ0 = θ(0) = −∇Wβ (ζ(0)).

2. Для каждого момента времени t ∈ [0, T ] получаем выход оракула

∑∞

gt =

(2) и формируем траекторию

i=1 g(i)I[τi ,τi+1 ) (t) с учетом

стохастического дифференциального уравнения в E ∗ в паре с алгебраическим уравнением:

(7)

(8)

dζt = dgt ,

ut = −∇Wβ (ζt ) .

3. В момент времени T получаем реализованную траекторию {ut } и

если функция потерь Q задана, то соответствующие интегральные

потери

b T ({ut }) =

R

∑

Q(θ(i − 1)) ,

i>1,τi 6T

где τi — моменты скачков процесса Xt .

З а м е ч а н и е 1. Очевидно, что определяемая таким образом стратегия u принадлежит U. Фактически, уравнения (7)–(8) означают, что в

моменты времени τi , i = 1, 2, . . . , происходит пересчет величин

ζ(i) = ζ(i − 1) + g(i) ,

θ(i) = −∇Wβ (ζ(i)) .

Для полноты приведем ряд определений и предложений из [3], разъясняющих и дополняющих суть построений алгоритма ЗС (подробнее

см. [3, § 3] и приведенную библиографию).

О п р е д е л е н и е 1. Пусть α > 0. Выпуклая функция V : Θ → R

называется α-сильно выпуклой относительно исходной нормы ∥ · ∥ ,

6

если

(9)

V (sx + (1 − s)y) 6 sV (x) + (1 − s)V (y) −

α

s(1 − s)∥x − y∥2

2

при любых x, y ∈ Θ и s ∈ [0, 1].

П р е д л о ж е н и е 1. Пусть функция V : Θ → R выпукла, а параметр

β > 0. Тогда β-сопряженная к V функция

{

}

Wβ (z) = sup −z ⊤ θ − βV (θ)

(10)

∀ z ∈ E∗

θ∈Θ

обладает следующими свойствами:

1. Функция Wβ : E ∗ → R выпукла и имеет сопряженную βV , т.e.

{

}

∀ θ ∈ Θ βV (θ) = sup −z ⊤ θ − Wβ (z) ;

(11)

z∈E ∗

2. Если функция V является α-сильно выпуклой относительно

исходной нормы ∥ · ∥, то:

(i) выполнено условие (6),

{

}

(ii) argmax −z ⊤ θ − βV (θ) = −∇Wβ (z) ∈ Θ .

θ∈Θ

З а м е ч а н и е 2. В соответствии с предложением 1, п. 2, (ii) уравнение

(8) можно записать в виде

{

}

ut = argmin ζt⊤ θ + βV (θ) .

θ∈Θ

О п р е д е л е н и е 2. Назовем функцию V : Θ → R+ прокси-функцией,

если она выпукла и

(i) существует такая точка θ∗ ∈ Θ, что min V (θ) = V (θ∗ ),

θ∈Θ

(ii) для β-сопряженной к V функции Wβ выполнено условие (6).

В [5, с. 1586] даны примеры прокси-функций в случае минимизации

на симплексе: квадратичная и энтропийная.

7

4. Основной результат

Т е о р е м а 1. Пусть алгоритм ЗС с прокси-функцией V : Θ → R+

реализует стратегию ut на горизонте T > 0 при описанных выше

условиях. Тогда справедливо неравенство

√

b T ({ut }) − inf RT (u) 6

ER

(12)

u∈U

2T λ V

L.

α

Параметр алгоритма α описан в (9), a β и V задаются

√

Tλ

(13)

β=

L , V > max V (θ) .

θ∈Θ

2αV

Д о к а з а т е л ь с т в о т е о р е м ы 1. Имеем

[

= E I{XT >1}

=E

n=∞

∑

n=1

XT

∑

i=1

I{XT =n}

{[∑n

i=1

b T ({ut }) − inf RT (u) =

ER

u∈U

]

Q(θ(i − 1)) − XT Q(θ∗ ) =

]}

Q(θ(i − 1)) − nQ(θ ) 6

∗

(

)

n 2

6E

I{XT =n} βV +

L 6

2αβ

)

( n=1

XT 2

λT 2

L = βV +

L.

6 E βV +

2αβ

2αβ

n=∞

∑

Поясним неравенство в этой цепочке. При условии события

{XT = n} случайные величины ξτ1 , ξτ2 , . . . , ξτn распределены так же, как

ξ(1), ξ(2), . . . , ξ(n), и алгоритм работает так же, как в модели [3] с дискретным временем и n шагами. Это позволяет применить предложения 2

и 3 из [3, § 4], c γi ≡ 1 и получить рассматриваемое неравенство —

явную верхнюю оценку превышения средних интегральных потерь над

минимумом. В правой части остается провести минимизацию по β > 0.

Приходим к (13) и желаемому неравенству (12). Теорема доказана.

8

5. Пример

Пусть горизонт времени T зафиксирован и сервер получает запросы в

моменты времени, сформированные пуассоновским процессом. Каждый

запрос содержит N типов задач, и каждый j-й тип задачи требует

ηj затрат (некоторого ресурса, например времени). Эти неотрицательные величины — случайные, таким образом, полученную в момент i

заявку можно характеризовать вектором случайных величин3 η(i) =

(η1 (i), . . . , ηN (i)). Для фиксированного j-го типа задачи случайные величины ηj (i) с течением времени (i = 1, 2, . . .) образуют последовательность одинаково распределенных случайных величин, независимых

между собой и между затратами других типов задач.

В момент получения каждой заявки сервер может выбрать одну из

задач и перенаправить её на другой сервер, тем самым не производя

затрат на ее обработку. Реализации количества затрат в полученном запросе становятся известными после решения о перенаправлении задачи и

только для принятых задач. Цель состоит в том, чтобы минимизировать

суммарные затраты (с начального момента времени до T ) при ограничении, что в каждом запросе в среднем может быть перенаправлена только

малая доля4 задач δ.

Будем использовать следующий сценарий работы сервера. Введем вектор управляющих переменных θ = (θ1 , . . . , θN )⊤ , где θj ∈

∑N

∈ [0, 1],

j=1 θj = 1. В момент прихода i-го запроса случайно выбирается тип задачи — кандидата на перенаправление согласно дискретному

распределению между N типами с вероятностями θ1 (i − 1), . . . , θN (i − 1).

3

4

Так же будет обозначаться реализация этих случайных величин, отличие ясно из контекста.

Таким образом, в каждом запросе в среднем отбрасывается δN < 1 задач.

9

После этого данная задача перенаправляется с вероятностью δN .

Очевидно, что оптимальным решением будет определение типа задачи

— кандидата на перенаправление с максимальным математическим

ожиданием.

Формально требуется минимизировать функцию

N

∑ ∑

RT = E

(14)

η j (i),

i:τi 6T j=1

где

η j (i) =

ηj (i),

если задача j-го типа в i-м запросе

обслуживалась на сервере,

0,

если задача была перенаправлена,

на симплексе

Θ = {θ :

N

∑

θj 6 1, 0 6 θj 6 1, j = 1, . . . , N }.

j=1

Функция (14) обладает той же структурой, что (4), c

N

∑

Q(θ) =

(1 − δN θj )Eηj .

j=1

Градиент этой функции равен (−δN Eη1 , . . . , −δN EηN )⊤ , но он наблюдается на сервере только через величины η j (i), таким образом, g(i) =

(

)⊤

η 1 (i−1)

η N (i−1)

− 1−δN θ1 (i−1) , . . . , − 1−δN θN (i−1) .

В качестве прокси-функции используется энтропийная функция

∑

V (θ) = ln N + N

j=1 θj ln θj с параметром сильной выпуклости α = 1 (по

отношению к норме ∥ · ∥1 см., например, [3]) и максимальным значением

на симплексе V = ln N . Неравенство (12) принимает вид

b T ({ut }) − inf RT (u) 6

ER

u∈U

10

√

2T λ ln N L .

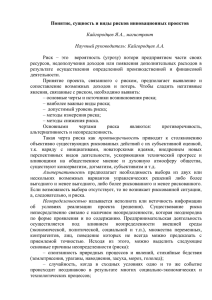

5.1. Численное моделирование

Данные формировались следующим образом. Для каждого типа задач

потери обладали равномерным распределением на интервале (непрерывном или дискретном), причем тип распределения и границы интервала

были однократно случайно выбраны (для каждого типа — свои). Взято

T = 2000, λ = 2, N = 100, δ = 0,006. Было проведено 500 симуляций для

данного набора параметров, и в конце временно́го интервала получены

bT .

реализации интегральных потерь в конечный момент времени R

.

Гистограмма разности этих величин и оптимального значения R∗T =

inf u∈U RT (u) вместе с границей (12) (кружок справа) и эмпирическим

средним данных разностей (вертикальная штриховая линия) изображены на рисунке. Видно, что эмпирическое среднее действительно лежит

в указанных границах.

6. Заключение

В статье представлен алгоритм зеркального спуска, направленный на

минимизацию средних потерь стохастической системы, функционирующей в непрерывном времени, c потерями, возникающими в случайные

моменты скачков пуассоновского процесса с известной интенсивностью.

С возникновением потерь становятся известными стохастически зашумленные градиенты функции потерь; шум аддитивный, несмещенный,

ограниченный в L2 с известной границей. Цель состоит в минимизации среднего значения интегральных потерь на заданном выпуклом

компакте в RN и ограниченном временно́м интервале с горизонтом T .

Для алгоритма доказана явная верхняя граница превышения средних

√

интегральных потерь над минимумом. Граница имеет вид C T с кон11

кретной константой C, см. (12). Теоретический результат подтвержден

содержательным примером.

СПИСОК ЛИТЕРАТУРЫ

1. Немировский А.С., Юдин Д.Б. Сложность задач и эффективность

методов оптимизации. М.: Наука, 1979.

2. Ben-Tal A., Margalit T., Nemirovski A. The Ordered Subsets Mirror

Descent Optimization Method with Applications to Tomography //

SIAM J. Optim. 2001. V. 12. No. 1. P. 79–108.

3. Юдицкий А.Б., Назин А.В., Цыбаков А.Б. и др. Рекуррентное

агрегирование оценок методом зеркального спуска с усреднением //

Проблемы передачи информации. 2005. Т. 41. № 4. С. 78–96.

4. Назин А.В., Поляк Б.Т. Рандомизированный алгоритм нахождения

собственного вектора стохастической матрицы с применением к

задаче PageRank // АиТ. 2011. № 2. С. 131–141.

Nazin A.V., Polyak B.T. Randomized algorithm to determine the

eigenvector of a stochastic matrix with application to the PageRank

problem // Autom. Remote Control. 2011. V. 72. No. 2. P. 342–352.

5. Nemirovski A., Juditsky A., Lan G., et al. Robust Stochastic

Approximation Approach to Stochastic Programming // SIAM J. Optim.

2009. V. 19. P. 1574–1609.

6. Nesterov Yu. Primal-dual subgradient methods for convex problems.

Core discussion paper 2005/67. Louvain-la-Neuve, Belgium: Center for

Operation Research and Econometrics, 2005.

12

60

50

40

30

20

10

0

−1000

0

1000

2000

bT −

R

13

R∗T

3000

4000

5000

Подрисуночная подпись:

bT ) и

Гистограмма реализаций разности между полученной с помощью алгоритма ЗС (R

оптимальной (R∗T ) интегральными потерями.

Подпись на оси ординат:

Число попаданий в соответствующий интервал

14