Математический подход к установлению авторства и времени

advertisement

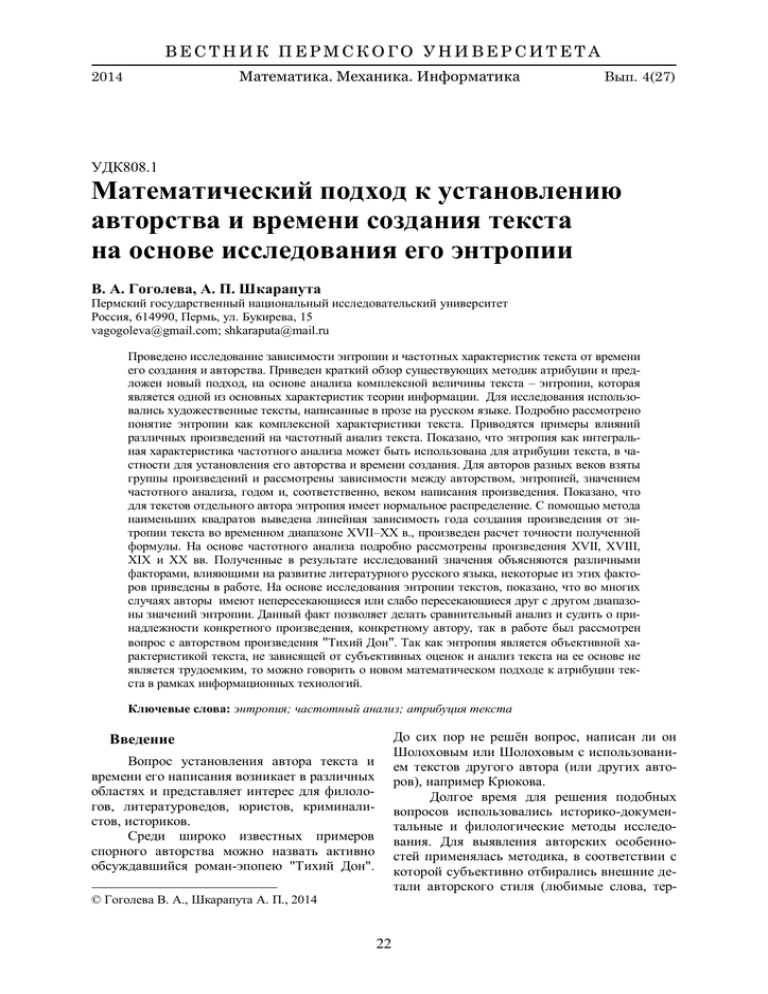

ВЕСТНИК ПЕРМСКОГО УНИВЕРСИТЕТА Математика. Механика. Информатика 2014 Вып. 4(27) УДК808.1 Математический подход к установлению авторства и времени создания текста на основе исследования его энтропии В. А. Гоголева, А. П. Шкарапута Пермский государственный национальный исследовательский университет Россия, 614990, Пермь, ул. Букирева, 15 vagogoleva@gmail.com; shkaraputa@mail.ru Проведено исследование зависимости энтропии и частотных характеристик текста от времени его создания и авторства. Приведен краткий обзор существующих методик атрибуции и предложен новый подход, на основе анализа комплексной величины текста – энтропии, которая является одной из основных характеристик теории информации. Для исследования использовались художественные тексты, написанные в прозе на русском языке. Подробно рассмотрено понятие энтропии как комплексной характеристики текста. Приводятся примеры влияний различных произведений на частотный анализ текста. Показано, что энтропия как интегральная характеристика частотного анализа может быть использована для атрибуции текста, в частности для установления его авторства и времени создания. Для авторов разных веков взяты группы произведений и рассмотрены зависимости между авторством, энтропией, значением частотного анализа, годом и, соответственно, веком написания произведения. Показано, что для текстов отдельного автора энтропия имеет нормальное распределение. С помощью метода наименьших квадратов выведена линейная зависимость года создания произведения от энтропии текста во временном диапазоне XVII–XX в., произведен расчет точности полученной формулы. На основе частотного анализа подробно рассмотрены произведения XVII, XVIII, XIX и XX вв. Полученные в результате исследований значения объясняются различными факторами, влияющими на развитие литературного русского языка, некоторые из этих факторов приведены в работе. На основе исследования энтропии текстов, показано, что во многих случаях авторы имеют непересекающиеся или слабо пересекающиеся друг с другом диапазоны значений энтропии. Данный факт позволяет делать сравнительный анализ и судить о принадлежности конкретного произведения, конкретному автору, так в работе был рассмотрен вопрос с авторством произведения "Тихий Дон". Так как энтропия является объективной характеристикой текста, не зависящей от субъективных оценок и анализ текста на ее основе не является трудоемким, то можно говорить о новом математическом подходе к атрибуции текста в рамках информационных технологий. Ключевые слова: энтропия; частотный анализ; атрибуция текста Введение До сих пор не решён вопрос, написан ли он Шолоховым или Шолоховым с использованием текстов другого автора (или других авторов), например Крюкова. Долгое время для решения подобных вопросов использовались историко-документальные и филологические методы исследования. Для выявления авторских особенностей применялась методика, в соответствии с которой субъективно отбирались внешние детали авторского стиля (любимые слова, тер- Вопрос установления автора текста и времени его написания возникает в различных областях и представляет интерес для филологов, литературоведов, юристов, криминалистов, историков. Среди широко известных примеров спорного авторства можно назвать активно обсуждавшийся роман-эпопею "Тихий Дон". © Гоголева В. А., Шкарапута А. П., 2014 22 Исследование авторства текста и времени его создания… мины, выражения). Отметим, что такие исследования трудоемки, поэтому встает вопрос о создании формальных методов решения данной задачи. В настоящее время для установления авторства и датирования текстов применяется множество подходов из теории распознавания образов, математической статистики и теории вероятностей. Уже в 60–70-е гг. XX в. основное место среди методик атрибуции текстов заняли методы статистики: работы А.Л. Гришунина, П. Вашака, В.И. Батова и других.1 Существуют программные продукты, позволяющие учитывать различные лингвостатистические параметры, разносторонне характеризующие текст. Но большинство из них достаточно ресурсозатратны. Особенно показательна тут работа М.А. Марусенко об определении авторства ряда псевдонимных произведений, приписываемых раннему В.В. Маяковскому. В этой работе использовано 56 основных параметров текста и сверх того столько же производных (агрегированных) показателей.2 В данной статье приводятся исследования энтропии и частотных характеристик текста, на основе которых построен новый подход к проблеме атрибуции текста. В частности, данный подход применим для решения идентификационных (подтвердить или исключить авторство определенного лица или век написания) и диагностических задач (решаются из предположения, что автор и дата написания текста неизвестны). тотных характеристик текста, т.е. эти изменения влияют на частоту встречаемости символов, с помощью которых написан текст. Исследование частот символов по отдельности позволяет решать множество задач, связанных с атрибуцией текста, но возникает вопрос в некой одной – интегральной характеристике текста, которая могла бы учитывать вклад каждого символа, на основе частоты его встречаемости. Такая характеристика имеется в теории информации и носит название – энтропия текста. 1.1. Энтропия Энтропия пришла в информатику из термодинамики, и она описывает упорядоченность или сложность материи. Применительно к абстрактным системам, энтропия – это тоже мера порядка или мера сложности системы. Текст также представляет собой систему, и его энтропия достигает максимума, когда все его символы встречаются с равными частотами, т.е. когда текст наиболее упорядочен. Согласно алфавитному подходу, всякое сообщение можно закодировать с помощью конечной последовательности символов некоторого алфавита. И существующий подход А.Н. Колмогорова говорит о том, что информативность последовательности символов не зависит от содержания сообщения, а определяется минимально необходимым количеством символов для ее кодирования.3 То есть, энтропию символьного текста можно рассматривать как "количество информации", которую несут символы, без учета содержания текста. К. Шеннон предложил признать формулу, по которой прирост информации равен устраненной неопределенности, на основании которой неопределенность и информация должны измеряться одной и той же мерой. В теоретической физике энтропию также часто рассматривают как количественную меру неопределенности случайного эксперимента. Применительно к независимым испытаниям случайной величины с распределением вероятностей 1. Энтропия и частотный анализ За любым текстом стоит автор (даже если этот автор – компьютер), и у каждого автора есть свои особенности и предпочтения. Такие особенности, в свою очередь, обусловлены средой, в которой формировался создатель текста. Параметров, по которым можно отследить индивидуальность автора, может быть огромное количество: предпочтительные слова, местные речевые особенности, длина предложений, использование оборотов речи, круг знаний и словарный запас… Однако, изменение данных параметров приводит к изменению час- a ... a n , 1 p1 ... p n 1 Родионова Е.С. Методы атрибуции художественных текстов // Структурная и прикладная лингвистика: Изд-во СПбГУ, 2008. Вып. 7. 127 с. 2 Хмелёв Д. Краткая история разработки методик определения авторского стиля. URL: http://rusf.ru/books/analysis/history.htm/(дата обращения: 16.07.2014). где a1..an – возможные состояния, p1..pn – их вероятности энтропия определяется формулой 3 Колмогоров А.Н. Математика – наука и профессия. М.: Наука, 1988. 288 с. 23 В. А. Гоголева, А. П. Шкарапута В данной работе рассматривались частоты следующих символов: 32 "телеграфные" буквы русского алфавита, знаки препинания (точка, запятая, тире, двоеточие, точка с запятой, знак вопроса, кавычки, восклицательный знак) и пробел. Для старых текстов, использовались адаптированные варианты (без твердых знаков на конце и без буквы "ять"). n H pi log 2 pi . (1.1.1) i 1 Таким образом, энтропия события является суммой с противоположным знаком всех относительных частот появления события ai, умноженных на их же двоичные логарифмы. Единицу измерения энтропии вероятностной схемы предлагает так называемая теорема кодирования, утверждающая, что любой исход можно закодировать символами 0 и 1. На основании этого единицей количества информации естественно считать 1 бит. Шеннон пишет: "Величина H играет центральную роль в теории информации в качестве меры количества информации, возможности выбора и неопределенности. Количество информации, передаваемое в сообщении, тесно связано с мерой неопределенности, или непредсказуемости передаваемых символов"4. 2. Исследование Для того чтобы находить закономерности, была написана программа, которая подсчитывает значение энтропии по формуле (1.1.1) для введенного текста, а также выдает значения частот для символов текста. 2.1. Вид распределения Перед тем, как искать зависимость между значением энтропии и автором текста, необходимо выяснить вид закона распределения энтропии для одного автора. Для этого было взято по 25 произведений М. Горького и И. Бунина, и для каждого подсчитана энтропия. Затем были построены гистограммы распределений, где по оси абсцисс отложены диапазоны значений энтропии в битах. 1.2. Частотный анализ Так как русский "телеграфный" алфавит содержит 32 буквы, то энтропия опыта, содержащегося в приеме одной буквы русского текста, составляет 5 бит. Это при условии, что все буквы считаются равновероятными. Для более точного вычисления информации, содержащейся в одной букве русского текста, надо знать вероятности появления различных букв. Эти вероятности можно приближённо определить, взяв достаточно большой отрывок, написанный по-русски, и рассчитав для него относительные частоты отдельных букв. Строго говоря, эти частоты могут несколько зависеть от характера текста. Например, в учебнике по высшей математике частота обычно очень редкой буквы "ф" будет заметно выше средней из-за частого повторения слов "функция", "дифференциал", "коэффициент" и некоторых других. Ещё больше отклонения от нормы в частоте употребления отдельных букв можно наблюдать в некоторых художественных произведениях, особенно в стихах. Поэтому для надёжного определения средней частоты появления буквы желательно иметь набор различных текстов, заимствованных из различных источников5. Рис. 1. Гистограмма распределения энтропии для произведений М. Горького 4 Шеннон К. Работы по теории информации и кибернетике. М.: Изд-во иностр. лит. 2002. 5 Яглом А.М., Яглом И.М. Вероятность и информация. М.: Наука, 1973. Рис. 2. Гистограмма распределения энтропии для произведений И. Бунина 24 Исследование авторства текста и времени его создания… Видно, что энтропия для отдельного автора имеет нормальное распределение. Также было выяснено, что для рассмотрения следует брать тексты не менее чем с 20000 символов. К примеру, если взять тексты Горького, объемом 5000 и 10000, то их энтропии равны 4,7 и 4,65 соответственно. Так, беря фрагменты текстов и считая их энтропии, можно, увеличивая объем, прийти к тому, что начиная с 20000 символов, распределение энтропий подчиняется нормальному закону. При этом разброс энтропии для каждого из авторов в среднем составляет 3 %. А для каждой группы авторов одного столетия разброс в среднем составляет 11 %. Оценим точность выполненных вычислений с помощью показателя средней абсолютной ошибки модели (Mean Absolute Percent Error – MAPE). Он показывает, на сколько процентов в среднем прогноз отклоняется от факта. Вычисляем показатель по формуле ei MAPE y i N 100% 4 %. (2.2.2) Тогда мы можем вычислить стандартную ошибку прогноза по формуле SE f 2.2. Энтропия и время создания текста Для нахождения зависимости между временем создания произведения и значениями энтропии, с помощью программы была посчитана энтропия у произведений XVII, XVIII, XIX и XX вв. В каждом веке были выбраны авторы и у каждого взято в среднем по 5 произведений. Рассматривались произведения, написанные в прозе и на русском языке. Для каждого года было посчитано среднее значение энтропии. ( x f x) 2 1 (1 2 . (2.2.3) N 2 N x ( N 1) 2 i e И на 95 %-ном уровне значимости доверительный интервал можно рассчитать по формулам: (2.2.4) н.гр. y f t табл SE f , в.гр. y f t табл SE f , (2.2.5) где tтабл – табличное значение коэффициента Стьюдента на уровне значимости α=0,05 и числа степеней свободы N-2. Рассмотрим, как работают формулы, на примере произведения "Челкаш" М. Горького: x f 4,9; y f 1890,98; SE f 92,1; н.гр. 1709,5; в.гр . 2072 ,46 . То есть, для данного произведения значение года создания с вероятностью 0,95 % попадет в интервал от 1709 до 2072-го гг. Затем минимальное, среднее и максимальное значения энтропии были посчитаны для каждого века. Рис. 3. График зависимости энтропии текста от года создания произведения и график линейной зависимости, полученный с помощью МНК Чтобы найти коэффициенты зависимости между годом написания текста и его энтропией, воспользуемся методом наименьших квадратов. Получаем коэффициенты линейной зависимости года написания от энтропии: a=349,15 b=179,42. Следовательно, мы можем узнать год написания текста по формуле: Y= а*H+b (2.2.1) где Y-год, H-энтропия. Таблица 1. Значения энтропий для произведений XVII, XVIII, XIX и XX вв. Век Среднее Минимальное Максимальное 17 4,950 4,910 5,168 18 4,910 4,808 5,117 19 4,891 4,777 5,072 20 4,826 4,692 4,888 Как видно из таблицы, с XVII по XX вв. и среднее, и минимальное, и максимальное значения уменьшились. На рис. 3 представлен график линейной зависимости энтропии текста от года написания. 25 В. А. Гоголева, А. П. Шкарапута ровать, индивид, индифферентный, коммунизм, конкретный, пресса, рутина, социализм, эксплуатация, эмансипация и прочие. В 1860-70-е гг. появляются слова аборт, агитация, алкоголизм, бактерия, гипноз, индустрия, интеллигент, интернационал, каверна, клерикализм, клика, крах, манифестация, милитаризм, миллионер, монархизм, неврастения, регресс, реклама, санкция, социал-демократ, субсидировать, финансист, чек, шовинизм и многие другие. Общее число заимствованных лексических гнезд за 1830–1870-е гг. составляет примерно 2000. Французское влияние на русский язык ослабляется к концу XIX в., когда дворянство отказывается от общения на французском языке в пользу русского. После победы в Великой Отечественной войне резко изменилось отношение к немецкому языку, его стали меньше изучать в школах, соответственно расширилось изучение английского языка. Иностранные словазаимствования с этого времени имели преимущественно английское происхождение. В литературном языке исчезают длинные предложения с многочисленными обособленными оборотами, часто встречавшиеся у писателей XIX в. Распространяются номинативные конструкции. Появление большого числа заимствованных несклоняемых слов на -о привело, по-видимому, к случаям потери склоняемости русских названий на -о (Самолет приземлился в Домодедово вместо в Домодедове). 2.3. Частотный анализ и время создания текста Чтобы понять, чем обусловлены именно такие значения энтропии, был выполнен частотный анализ для каждого века. Рис. 4. Зависимость частот встречаемости букв от века создания произведения Такие показатели можно объяснить, рассмотрев историю литературного русского языка. В конце XVIII и начале XIX столетия усилиями русских ученых, прежде всего Карамзина, происходит отказ от системы "трёх штилей". Карамзин создает свою стилистическую систему, известную как "новый слог". Ее главным принципом было писать так, как говорят и говорить так, как пишут. Из "нового слога" решительно изгоняются явно старославянские слова, архаизмы и канцелярские обороты. Карамзину приписывается создание многих новых слов, таких как добросовестность, неловкость, ковкость, несоразмерность. В 1830–1840-х гг. из-за влияния немецкой философии русский литературный язык получает такие слова-кальки, как призвание, образование, мировоззрение, исключительный, целостность, целесообразный, саморазвитие, самоопределение и тому подобные. Разумеется, попадают в русский язык и иностранные слова, характеризующие явления общественной жизни: абсолютный, абстракция, активный, доктрина, гуманизм, идеализи- 2.4. Авторство текста Для каждого автора были посчитаны среднее, минимальное и максимальное значения энтропий. Ниже приведен график для авторов с наиболее отличающимися значениями. Рис. 5. Зависимость энтропии от авторства текста 26 Исследование авторства текста и времени его создания… Чтобы понять, чем обусловлены именно такие значения энтропии, ниже приводятся частоты встречаемости символов в произведениях разных авторов. Рис. 6. Зависимость частот встречаемости букв от авторства текста Кроме того, отдельно было рассмотрено произведение "Тихий Дон" Шолохова, так как это самый известный пример спорного авторства. В данных расчетах, энтропии всех частей произведения попадают в рассчитанный диапазон для данного автора. Минимальное и максимальное значения энтропий среди произведений Шолохова – 4,82 и 4,91 бит соответственно, а все четыре части "Тихого Дона" имеют энтропии, попадающие в данный диапазон (4,9; 4,87; 4,86; 4,89 бит). Таким образом, можно сделать вывод, что Шолохов является автором всех частей "Тихого Дона". Как можно видеть, из вышеприведенных графиков на основе предложенной в работе методики возможно: 1. Принимать или отвергать гипотезу о том, что произведение принадлежит определенному автору с определённой погрешностью. 2. Среди нескольких авторов с не накладывающимися значениями энтропий выбирать наиболее вероятного для произведения неизвестного автора. 3. Принимать или отвергать гипотезу о том, что произведение написано в определённом году (или веке) с определённой погрешностью. 4. Для группы произведений одного автора определять наиболее вероятный год (и, соответственно, век) написания. Заключение Можно сделать вывод, что в ряде случаев энтропия может быть авторским инвариантом, так как она удовлетворяет следующим требованиям: 1. Она должна быть достаточно "массовой", интегральной, чтобы слабо контролироваться автором на сознательном уровне. 2. Искомый параметр должен сохранять "постоянное значение" для произведений данного автора. 3. Наконец, параметр должен уверенно различать между собой разные группы писателей. Другими словами, должно существовать достаточное число авторских групп, заметно отличающихся друг от друга значениями инварианта. Таким образом, предложенный подход, на основе вычисления энтропии текста, которая, в свою очередь, является интегральной частотной характеристикой, можно с большой степенью точности использовать определения авторства текста. А вместе с другими характеристиками текста, такой анализ может быть достаточно надежным для важных исследований. Список литературы 1. Хмелёв Д. Краткая история разработки методик определения авторского стиля. URL: http://rusf.ru/books/analysis/history.htm/(дата обращения: 16.07.2014). 27 В. А. Гоголева, А. П. Шкарапута 2. Милов Л.В., Бородкин Л.И., Иванова Т.В. От Нестора до Фонвизина: Новые методы определения авторства. М.: Изд. группа "Прогресс", 1994. 443 с. 3. Родионова Е.С. Методы атрибуции художественных текстов // Структурная и прикладная лингвистика: Изд-во СПбГУ, 2008. Вып. 7. 127 с. 4. Алферов А.П., Зубов А.Ю., Кузьмин А.С. и др. Основы криптографии. М.: Гелиос АРВ, 2002. 480 с. 5. Морозов Н.А. Лингвистические спектры: средство для отличения плагиатов от истинных произведений того или другого известного автора // URL: http://www.textology.ru/ 6. 7. 8. 9. library/book.aspx?bookId=1&textId=3 (дата обращения: 16.07.2014). Яглом А.М., Яглом И.М. Вероятность и информация. 3-е изд. М.: Наука, 1973. 511 с. Шеннон К. Работы по теории информации и кибернетике. М.: Изд-во иностранной литературы, 1963. 830 с. Марков А.А. Об одном применении статистического метода // URL: http://www.textology.ru/ library/ book.aspx?BookId=8&textId=2 (дата обращения: 16.07.2014). Статистические методы анализа литературного текста // URL: http://wiki.syktsu.ru /index.php/Статистические_методы_анализ а_литературного_текста (дата обращения: 16.07.2014). Mathematical approach to the establishment of authorship and time of creation of text based on a study of entropy V. A. Gogoleva, A. P. Shkaraputa Perm State University, Russia, 614990, Perm, Bukirev st., 15 vagogoleva@gmail.com; shkaraputa@mail.ru Research of dependence of the entropy and the frequency characteristics of the text from the time of its creation and authorship. A brief review of existing methods of attribution and proposed a new approach, based on an analysis of the complex value of the text – the entropy, which is one of the main characteristics of information theory.. To study used literary texts, written in prose in Russian. Discussed in detail the concept of entropy as complex text characteristics. Are examples of the effects of various works on the frequency analysis. It is shown that not only the frequency analysis, but its integral characteristic – entropy, can be used for the attribution of the text that can serve as the creation of a new approach to the problem of authorship and time of creation of the text. For authors from different centuries to take a group of works and examined the relationship between authorship, entropy value of the frequency analysis, a year and a century of writing works. It is shown that for one author, entropy has a normal distribution. Using the method of least squares derived linear relationship, the creation of the work of the entropy of the text, calculated the accuracy of the derived formula. On the basis of frequency analysis discussed in detail texts from XVII, XVIII, XIX and XX centuries. Resulting from research on the value attributed to various factors influencing the development of the Russian literary language, some of these factors are given in this work. Calculated error resulting century works. Based on the study of the entropy of texts, it is shown that in many cases, the authors have non-overlapping or slightly overlapping each other ranges of values of entropy. This fact allows us to do a comparative analysis and judge accessories particular work, a particular author, so the work was considered a work of authorship "And Quiet Flows the Don". Because the entropy is an objective characteristic of the text, which does not depend on subjective assessments and analysis of the text based on it is not time consuming, it is possible to speak about a new mathematical approach to the attribution of the text in the framework of information technology. Key words: entropy; frequency analysis; text attribution. 28